Przechowywanie kluczy, tokenów, haseł, certyfikatów czy innych sekretów dla dostępu do wielu różnych zasobów utrzymywanych przez firmy i organizacje to w praktyce problem, jeśli sekrety zostały udostępnione „byle komu i na zawsze”. Co gorsze, w wielu firmach sekrety mogą być przechowywane w postaci zwykłego tekstu, rozsiane po plikach konfiguracyjnych i narzędziach do zarządzania konfiguracją lub serwerach automatyzujących.

Temat ten spędza sen z powiek wielu inżynierom i bezpieczeniakom. Konieczna jest scentralizowana forma przechowywania i zarządzania sekretami, aby zapobiec ich wyciekom oraz naruszeniom bezpieczeństwa organizacji.

Problem statycznych poświadczeń tzw. „Secrets Sprawl”

Można wymienić wiele antywzorców w kulturze DevOps albo wskazać niedostatecznie zabezpieczone jej elementy, niezgodne z branżowymi czy technicznymi standardami. Wśród najczęstszych są statyczne poświadczenia (Secret Sprawl) w kodzie lub plikach konfiguracyjnych.

Dane w plikach .env, pom.xml czy config.json często zawierają hasła lub klucze API zapisane jawnym tekstem. Z kolei w playbookach Ansible wrażliwe dane mogą zostać ujawnione w logach. Występować może także problem duplikacji sekretów, gdy programiści umieszczają te same hasła, klucze API lub tokeny w wielu playbookach.

Inny antywzór to złe przechowywanie sekretów w obrazach kontenerowych. Wystarczy, że inżynier użyje instrukcji COPY . . w pliku konfiguracyjnym Dockerfile, a to spowoduje skopiowanie całej zawartości folderu. Jeżeli w tym folderze znajdował się plik .env z sekretami, to zostanie on skopiowany do obrazu Dockera i stanie się dostępny dla każdego, kto pobierze ten obraz.

Bezpieczeństwo należy zachować również podczas tworzenia infrastruktury jako kodu, czyli Infrastructure as Code (IaC), który bez kontroli sekretów jest narażony na wycieki danych. Często zdarza się umieszczanie danych uwierzytelniających w szablonach Terraforma (pliki terraform.tfvars).

Grzechem jest także złe zarządzanie procesami CI/CD i ich logami. Hasła wpisane bezpośrednio w konfiguracji Jenkinsa czy GitLab CI, błędy w pipelineach (np. „connection refused” z pełnym stringiem połączeniowym) lub logi zawierające sekrety (np. przez polecenie printf “%s” “$aws_secret_key” | od -An -tx1) to częste przyczyny incydentów.

Wygasające certyfikaty

Kolejnym problemem manualnego zarządzania sekretami są wygasające certyfikaty TLS/SSL. Administrator musi pilnować terminu ważności certyfikatu oraz unikać jego przekroczenia. W przeciwnym razie grozi to poważnymi konsekwencjami w postaci Certificate Outages. Jest to klasyk dla administratorów: dopuszczono do wygaśnięcia certyfikatu, ponieważ ktoś, kto nim zarządzał, jest aktualnie na urlopie.

Zazwyczaj certyfikaty generowane są na lokalnej maszynie administratora. Następnie są one przenoszone do dysku zbiorczego projektu, na Slacka lub mail zespołu albo, co gorsza, do repozytorium Git jako tymczasowe rozwiązanie, które de facto zostaje na stałe. To generuje wiele rozproszonych kopii certyfikatu i utratę kontroli nad nimi. Wystarczy jeden wyciek z laptopa pracownika, aby nastąpiły niepożądane konsekwencje. Brak centralnego narzędzia do zarządzania certyfikatami generuje koszty biznesowe, a infrastruktura jest tak silna jak jej najsłabsze ogniwo.

Ostatnią kwestią opisywanego problemu Secret Sprawl jest trudność z audytowaniem, zwłaszcza rozproszonej infrastruktury, czyli wyszukania, kto i kiedy używał hasła, na przykład dostępu do bazy danych. W środowisku deweloperskim na pewno usłyszy się odpowiedź: „to nie ja” albo „nie wiem”. W modelu architektury rozproszonej brak centralnego punktu logowania generuje przechowywanie kluczy w wielu wspomnianych wyżej miejscach.

Ryzyka audytowalności takiego modelu mogą generować tak zwane martwe punkty (Visibility Gaps), w których narzędzia lub usługi nie posiadają dostatecznych możliwości monitorowania oraz szczegółowych logów audytowych. Ten brak widoczności utrudnia wykrycie wycieków i uniemożliwia błyskawiczną reakcję na incydenty. Uniemożliwiają one organizacjom wyśledzenie, jacy użytkownicy i w jakim czasie uzyskali dostęp do konkretnych zasobów.

Brak spójnego zarządzania sekretami stanowi zagrożenie dla integralności architektury. Rozproszone po architekturze statyczne poświadczenia tworzą tzw. powierzchnię ataku (Attack Surface) – im więcej miejsc, takich jak serwery, bazy danych czy aplikacje, gdzie sekrety są przechowywane, tym większe ryzyko wycieku danych.

Fragmentacja danych uwierzytelniających w różnych miejscach utrudnia też audyt i spełnianie wymogów regulacyjnych oraz standardów. W środowiskach chmurowych opartych na mikrousługach, gdzie zasoby są dynamicznie tworzone i usuwane, model Static Secrets staje się szczególnie nieefektywny oraz niebezpieczny. Odpowiednie skonfigurowanie środowiska stanowi podstawę operacyjną kontrolowania architektury.

Dynamic Secrets jako rozwiązanie problemu

Statyczne poświadczenia to przestarzały model, który nie sprawdza się w dynamicznych środowiskach DevOps. Przejście na dynamiczne poświadczenia (Dynamic Secrets) znacząco podnosi bezpieczeństwo infrastruktury rozproszonej. Idealnym narzędziem jest HashiCorp Vault, dzięki któremu organizacje zyskują kontrolę, automatyzację i zgodność z najlepszymi praktykami bezpieczeństwa oraz standardami.

Model Dynamic Secrets polega na generowaniu unikalnych, krótkotrwałych sekretów na żądanie i centralnym zarządzaniu nimi.

Vault spełnia te standardy, a jego kluczowymi zaletami są:

- Krótki czas ważności (Time-To-Live), w którym sekrety wygasają po kilku minutach lub godzinach. To minimalizuje ryzyko w przypadku wycieku sekretów. Nawet jeśli atakujący zdobędzie hasło, będzie ono bezużyteczne po określonym czasie.

- Unikalność. Każdy sekret jest przypisany do konkretnego zasobu, co zapobiega efektowi domina. Jeśli jeden element zostanie skompromitowany, reszta elementów pozostaje nienaruszona.

- Automatyzacja i rotacja. Vault automatycznie generuje, odnawia i unieważnia sekrety, eliminując potrzebę ręcznej interwencji i zmniejszając ryzyko błędów.

- Compliance. Centralne zarządzanie sekretami umożliwia ich śledzenie oraz sprawdzenie, kto i kiedy uzyskał dostęp do sekretu. To kluczowe dla spełnienia wymogów audytowych i szybkiego reagowania na incydenty.

Dynamiczne zarządzanie sekretami przynosi także korzyści dla zarządzania certyfikatami. Automatyzacja oraz częsta zmiana drastycznie ograniczają zakres szkód (Blast Radius). Zamiast certyfikatów na rok, administrator wystawia certyfikat na krótki i bezpieczny okres. To sprawia, że skomplikowane mechanizmy sprawdzania czy certyfikat został odnowiony stają się zbędne.

Tymczasowe poświadczenia dostępowe, generowane tylko na konkretne żądanie i w sposób zautomatyzowany, znacząco ponoszą bezpieczeństwo architektury. Dynamiczne sekrety minimalizują skutki wycieku danych, ograniczając „okno ataku” dla potencjalnych hakerów. Nawet jeśli cyberprzestępca zdoła przechwycić klucz, będzie mógł on go wykorzystać tylko przez krótką chwilę, zgodnie z ustawionym Time-To-Live (TTL). Vault został właśnie zaprojektowany do sprostowania tym wymaganiom.

Vault jako Single Source of Truth w architekturze Zero-Trust

Single Source of Truth to koncept centralnego miejsca przechowywania aktualnych informacji, eliminujący rozproszenie danych w różnych miejscach. Jest to jedna z głównych funkcjonalności platformy Vault zakładająca, że dane są przechowywane, zarządzane i aktualizowane wyłącznie w jednym i centralnym miejscu. Z kolei architektura Zero-Trust zakłada weryfikację każdego żądania dostępu wyłącznie na podstawie tożsamości, kontekstu i polityk. Vault jako Single Source of Truth w modelu Zero-Trust rozwiązuje problem rozproszonych sekretów i stanowi centralny punkt decyzyjny przydzielający dostęp określonym usługom.

W przestarzałym podejściu, o którym była mowa wyżej, klucze API, hasła i certyfikaty są przechowywane w różnych miejscach, co prowadzi do chaosu. Vault eliminuje ten problem, przechowując dostępy bezpośrednio w swoich silnikach sekretów takich jak Key-Value (KV), Public Key Infrastructure (PKI) czy bazy danych. Aplikacje konsumują te sekrety przez API, CLI lub agenta Vault zainstalowanego w środowisku aplikacji.

Mechanizm działania Vaulta w modelu Zero-Trust jest oparty na bezpieczeństwie. Vault działa jako pojedyncze źródło prawdy. Nie jest on jakąś bazą danych na hasła, a silnikiem tożsamości. Vault bazuje punkt zaufania na tożsamości kryptograficznej, a nie, jak w dawniej stosowanym modelu, na zaufaniu do adresów IP lub fizycznej lokalizacji serwera.

Pierwszym etapem architektury Zero-Trust jest weryfikacja dostępu klienta, który kieruje żądanie do serwera Vaulta. Vault oferuje mechanizmy dostosowane do specyfiki innych środowisk, takich jak zewnętrzni dostawcy tożsamości – OIDC, LDAP, chmury publiczne czy środowisko Kubernetesa. Klient musi najpierw przedstawić dowód tożsamości, który Vault weryfikuje, zanim wyda krótkotrwały token lub dynamiczne dane dostępu.

Ostatnim elementem architektury Zero-Trust jest kontrola dostępu. Samo posiadanie tokenu nie gwarantuje dostępu do danych. Vault stosuje polityki HCL, które definiują określone uprawnienia podmiotu proszącego o dostęp. Uprawnienia te mogą dotyczyć tego, czy dana aplikacja lub użytkownik ma prawo odczytać, zapisać lub usunąć określony sekret w silniku Vaulta. Kiedy aplikacja wysyła żądanie dostępu do poświadczenia dla innej aplikacji, Vault dynamicznie ewaluuje polityki przypisane do jej tokenu i na tej podstawie udziela dostępu lub go odrzuca.

Vault umożliwia egzekwowanie bezpieczeństwa poprzez mechanizmy kontroli dostępu i kompleksowy audyt. Jest to zgodne z główną maksymą Zero Trust: „Nigdy nie ufaj, zawsze weryfikuj”. Polityka Vaulta wymusza weryfikację tożsamości użytkowników i usług, określając dostęp do zasobu oraz możliwość wykonania określonych akcji. Rozwiązanie to działa spójnie w nowoczesnych środowiskach, takich jak klastry Kubernetesa czy pipeline’y CI/CD. Ponadto Vault wymusza, aby każdy dostęp był uwierzytelniony, autoryzowany i szyfrowany, eliminując domniemane zaufanie wewnątrz sieci.

Rotacja sekretów w Vault jako jeden z głównych cykli życia

Vault to platforma, która zawiera wiele wtyczek. Jednym z kluczowych komponentów jest silnik sekretów (Secrets Engine). Silnik ten oferuje zaawansowane możliwości zarządzania sekretami, w tym rotację sekretów „na żądanie”. Pozostałe funkcje to ich:

- generowanie,

- szyfrowanie,

- używanie i dystrybucja ,

- wycofywanie.

Dzięki prawidłowo zaimplementowanej polityce oraz silnikowi rotacji sekretów Vault zapewnia bezpieczny i kontrolowany dostęp do danych i sekretów.

Rodzaje Secrets Engine w Vault

Wyróżnia się następujące rodzaje Secrets Engine w Vault z wbudowanym mechanizmem rotacji sekretów:

- Key/value (KV) to podstawowy silnik służący do przechowywania dowolnych statycznych sekretów w formie par klucz-wartość (key/value) we wskazanej lokalizacji fizycznej. Jednak w wersji drugiej (v2) tej wtyczki obługiwane jest wersjonowanie, co pozwala na zapisywanie nowych wersji wartości klucza dla tej samej nazwy sekretu. W tym przypadku rotacja polega na wygenerowaniu i zapisaniu nowej wersji sekretu dokładnie pod tą samą ścieżką.

- Wtyczki chmurowe (np. AWS, Azure, GCP) generują na żądanie krótkoterminowe, dynamiczne klucze dostępu oraz role niezbędne do operowania w środowiskach chmurowych.

- Wtyczki bazodanowe wydają tymczasowe i automatycznie wygasające poświadczenia dostępu do systemów baz danych.

Rotacja sekretów „na żądanie” to proces, w którym Vault tworzy tymczasowe dane uwierzytelniające dokładnie w momencie, gdy aplikacja lub użytkownik o nie poprosi. Jest to tak zwany dostęp Just-in-Time. Dodatkowo zwiększa ona bezpieczeństwo, wygaszając stare sekrety w tym samym momencie. Wtyczka AWS jest przykładem funkcjonalności generowania tymczasowych poświadczeń z serwisem Identity & Access Manager (IAM).

Konfigurowanie rotacji kluczy w chmurze AWS

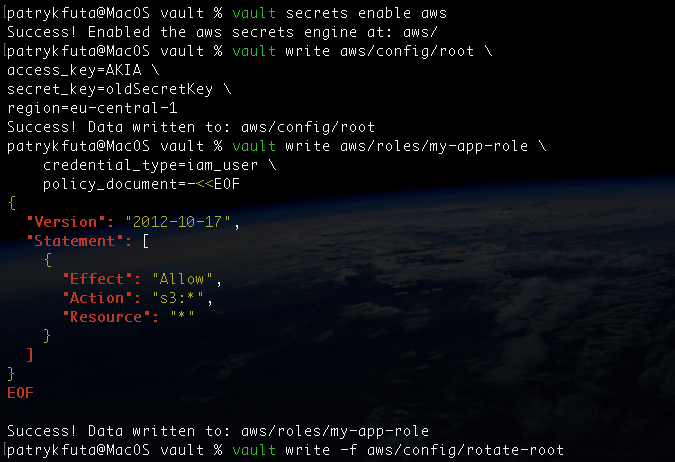

Poniżej przedstawiony został standardowy sposób skonfigurowania rotacji kluczy w chmurze AWS, w którym należy:

- Aktywować silnik AWS za pomocą polecenia vault secrets enable aws.

- Skonfigurować uprawnienia dla Vaulta, dostarczając mu poświadczeń użytkownika z AWS IAM. Poniższe polecenie vault write aws/config/root tworzy nowe klucze dostępu poprzez przekazanie access_key i secret_key.

- Stworzyć role w Vaulcie poleceniem vault write aws/roles/my-app-role, która umożliwi tworzenie tymczasowego użytkownika w AWS IAM z określeniem uprawnień, do jakich dany użytkownik będzie miał dostęp, np. do usługi S3 Bucket.

- Skonfigurować automatyczną rotację klucza, którego Vault używać będzie do pracy z AWS poleceniem vault write -f aws/config/rotate-root. Po wykonaniu tego polecenia stary klucz administracyjny w chmurze nie jest automatycznie usuwany. Należy go usunąć ręcznie w panelu AWS. Jednak od tego momentu system Vault będzie używał wyłącznie nowo wygenerowanego klucza.

Automatyzacja zarządzania certyfikatami TLS w Kubernetesie

Zarządzanie certyfikatami TLS w środowisku Kubernetesa opiera się na procesach manualnych. Administratorzy muszą samodzielnie generować klucze i certyfikaty, a następnie dystrybuować je po odpowiednich systemach i aplikacjach. Kubernetes nie ma wbudowanych mechanizmów automatycznej rotacji certyfikatów. To generuje poważne ryzyko awarii, braku dostępu do aplikacji, a nawet luki w jej bezpieczeństwie oraz stabilności. Dodatkowo taka praktyka wymusza na administratorze prowadzenie własnego rejestru w oparciu o arkusz i kalendarz w celu monitorowania dat wygaśnięcia każdego certyfikatu.

Idealnym rozwiązaniem jest zastosowanie platformy Vault. Automatyzuje ona zarządzanie certyfikatami. Stanowi fundament nowoczesnego bezpieczeństwa opartego na tożsamości maszyn.

Silnik Public Key Infrastructure (PKI)

Vault oferuje silnik Public Key Infrastructure (PKI), który zapewnia integrację z infrastrukturą klucza publicznego. Mechanizm PKI umożliwia dynamiczne generowanie i rotację certyfikatów X.509. Silnik sekretów PKI działa jako wewnętrzny urząd certyfikacji (CA). Wydaje i zarządza certyfikatami, umożliwiając aplikacjom i systemom bezpieczne uwierzytelnianie się oraz nawiązywanie szyfrowanej komunikacji. Dzięki temu Vault dynamicznie generuje i wydaje certyfikaty TLS dla poszczególnych usług, a aplikacje i mikroserwisy zyskują możliwość natychmiastowego, bezpiecznego uwierzytelniania się i nawiązywania wzajemnej komunikacji.

Mechanizm PKI w połączeniu z cert-managerem tworzy kompleksowe rozwiązanie do automatyzacji cyklu życia certyfikatów, eliminując przestoje i ludzkie błędy. Cert-manager to natywny kontroler dla Kubernetesa służący do automatyzacji zarządzania certyfikatami X.509. Vault, przy współpracy z cert-managerem, sprawia, że rotacja certyfikatów dzieje się w tle. Unika się potencjalnych awarii spowodowanych przegapieniem daty ważności SSL. Zapewnia to ciągłą i automatyczną rotację certyfikatów bez ingerencji administratora. Dodatkowo model ten gwarantuje niezwykle wysoki poziom bezpieczeństwa, ponieważ żadne certyfikaty nigdy nie są zapisywane na stałe na dyskach czy w kontenerach z aplikacjami.

Przykładem w tej części pracy będzie konfiguracja wewnętrznego urzędu certyfikacji i zintegrowanie go z Kubernetesem przy użyciu dwóch silników Vaulta – PKI oraz Kubernetes Auth. Z kolei cert-manager odpowiadać będzie za generowanie klucza prywatnego w Kubernetesie, tworzenie żądania podpisania certyfikatu (CSR, Certificate Signing Request) i wysyłanie żądania do Vaulta.

Konfigurację tę podzieliłem na trzy fazy i przedstawiam ją w następujących krokach.

Faza I: Konfiguracja Vaulta

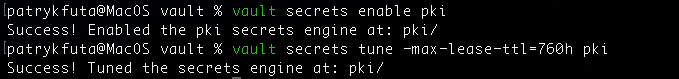

- Włączenie i konfiguracja sinika PKI w Vault. Aktywuje ona obsługę certyfikatów oraz ustawia maksymalny czas życia certyfikatów na około miesiąc.

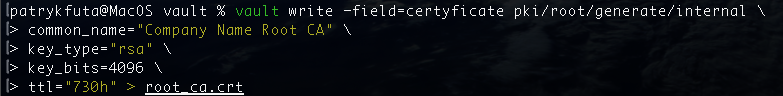

- Wygenerowanie głównego certyfikatu (Root CA). Vault musi posiadać swój główny certyfikat do podpisywania innych certyfikatów.

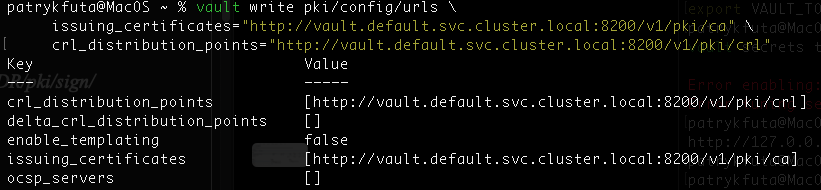

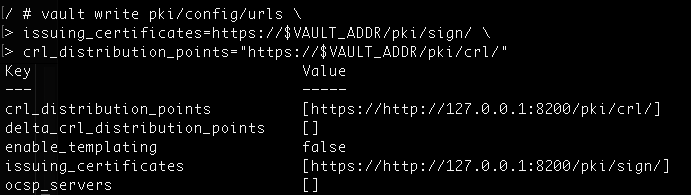

- Konfiguracja adresów URL, pod którymi inne usługi będą sprawdzać wystawcę i listę odwołanych certyfikatów (Certificate Revocation List).

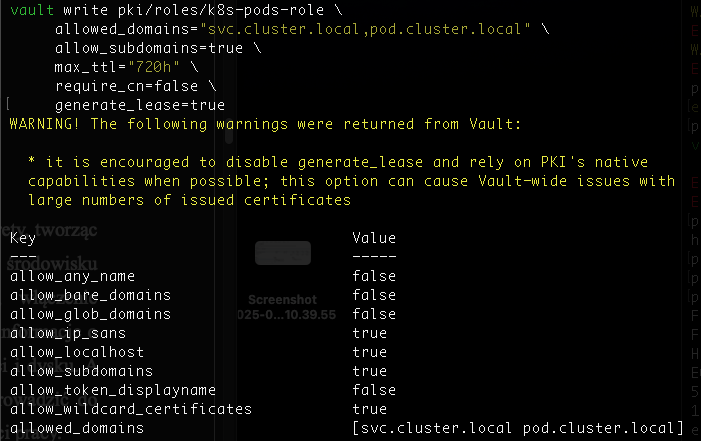

- Zdefiniowanie roli dla wystawiania certyfikatów. To pozwala Vaultowi na wygenerowanie certyfikatów na podstawie ról. Poniższa rola pozwala na wystawienie certyfikatów dla określonych domen (allowed_domains), które są wewnątrz Kubernetesa.

Powyższe ostrzeżenie (warning) można zignorować.

Co do zasady Vault śledzi wszystkie sekrety, tworząc dla nich tzw. dzierżawy w swojej wewnętrznej bazie danych. Jednak w środowisku Kubernetesa, gdzie Pody często wymieniają się wieloma certyfikatami, włączenie generate_lease=true sprawia, że Vault zapisuje w swojej głównej bazie danych informacje o każdym wydanym certyfikacie. To może powodować zbędne zużycie pamięci i dysku. A ogromna liczba wydawanych i unieważnianych certyfikatów może doprowadzić do zaprzestania działania Vaulta. Cert-manager rozwiązuje ten problem o czym w dalszej części pracy.

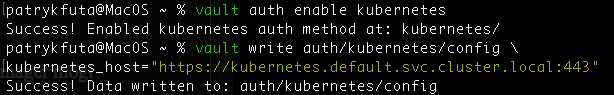

- Ustawienie logowania z metodą Kubernetes Auth. Skonfigurowany zostaje adres API Kubernetesa dla Vaulta w celu weryfikacji tokenów logowania.

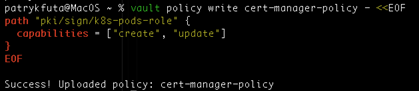

- Utworzenie zestawu uprawnień w Vault w celu podpisywania nowych certyfikatów przy użyciu wcześniej utworzonej roli „k8s-pods-role”. W tym momencie cert-manager będzie wysyłać do Vaulta żądania podpisania certyfikatu (CSR).

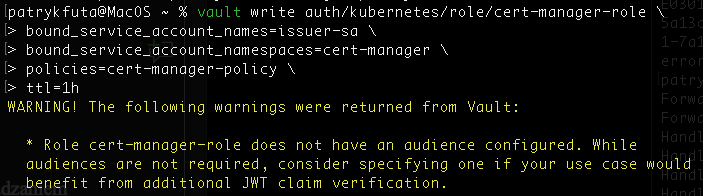

- Utworzenie roli w Vault, która autoryzować będzie logowanie się ServiceAccount o nazwie „issuer-sa”.

Faza II: Instalacja cert-manager w Kubernetesie

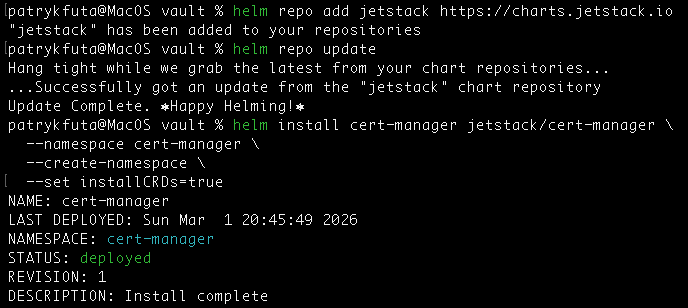

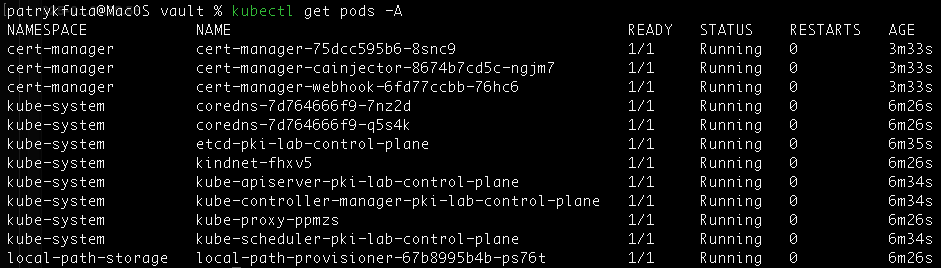

- Dodanie repozytorium Helma do cert-managera i zainstalowanie go w namespace „cert-manager”. Narzędzie to zajmie się zarządzaniem cyklem życia certyfikatów w klastrze Kubernetesa. Flaga –set installCRDs=true jest krytyczna; instaluje ona własne typy zasobów jak Issuer i Certificate.

Faza III: Konfiguracja Kubernetesa

- Utworzenie konta ServiceAccount, które umożliwi Vaultowi dostęp do Kubernetesa. W tym celu należy wykonać polecenie kubectl create serviceaccount issuer-sa -n cert-manager.

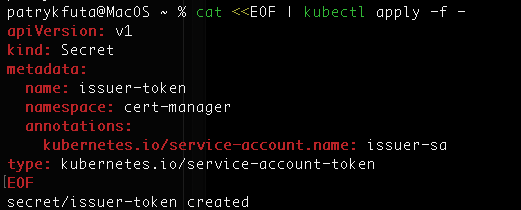

- Utworzenie tokenu z nieskończonym czasem życia dla konta usługi „issuer-sa”. Cert-manager będzie używać go jako hasła do logowania się do Vaulta.

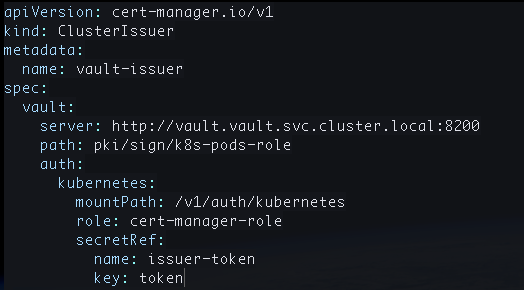

- Skonfigurowanie ClusterIssuer w celu ustanowienia dostawcy certyfikatów dla cert-managera. Należy wykonać polecenie kubectl apply -f cluster-issuer.yaml z zawartymi poniżej danymi:

W celu zweryfikowania poprawności konfiguracji certyfikatów należy wykonać polecenie kubectl get clusterissuer vault-issuer. Status powinien pokazywać READY = True. Jeśli tak jest, integracja zakończyła się sukcesem.

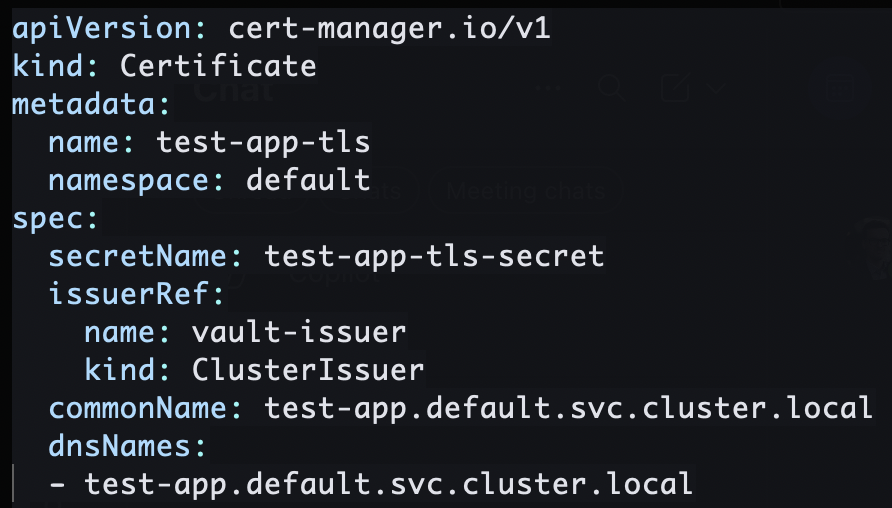

Dodatkowo można wykonać kolejny test polegający na wykonaniu zamówienia na nowy certyfikat, które cert-manager zrealizuje w Vaulcie. W tym celu należy utworzyć plik yaml z poniższą treścią oraz go wykonać.

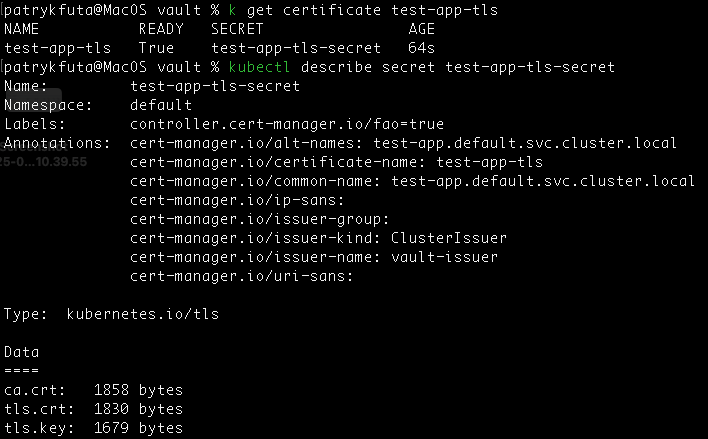

Po wykonaniu pliku, cert-manager natychmiast generuje klucz prywatny, wysyła CSR do Vaulta, odbiera podpisany certyfikat i zapisuje go w Kubernetesie. W celu jego weryfikacji należy wykonać polecenie kubectl get certificate test-app-tls.

Powinien wyświetlić trzy wartości:

- tls.key (klucz prywatny aplikacji),

- tls.crt (podpisany certyfikat publiczny przez Vaulta),

- ca.crt (certyfikat Root CA z Vaulta, użyteczny do weryfikacji).

Natywne uwierzytelnianie

Integracja narzędzi cert-manager i HashiCorp Vault w Kubernetesie opiera się na natywnym uwierzytelnianiu maszyn, wykorzystującym dedykowaną metodę uwierzytelniania Kubernetes (Kubernetes Auth). To eliminuje zapisywanie haseł statycznie. Natywne uwierzytelnianie sprawia, że aplikacja lub kontener udowodnia kim jest, nie korzystając przy tym z zaszytych w kodzie haseł.

Pody działające na Kubernetesie nie korzystają z żadnych wpisanych na stałe statycznych sekretów, aby poprosić o nowy certyfikat. Zamiast tego uwierzytelniają się one za pomocą swoich natywnych tokenów przy użyciu kont usług (ServiceAccount). Platforma Vault współpracuje z serwerem API Kubernetesa w celu weryfikacji takiego tokena i upewnieniu się, że dany Pod faktycznie jest tym, za kogo się podaje.

Mechanizm weryfikacji Vaulta z Kubernetesem charakteryzuje się ścisłą integracją pomiędzy systemem zarządzania sekretami a głównym centrum dowodzenia klastra (Control plane). Proces weryfikacji zaczyna się od żądania dostępu od Poda i zawartej w niej aplikacji, która potrzebuje wygenerować certyfikat TLS. Wysyła ona żądanie do platformy Vault, legitymując się wyłącznie swoim tokenem konta usługi. Następnie dokonuje się proces weryfikacji. Vault nie ufa temu żądaniu w ciemno. Zamiast tego nawiązuje bezpośrednie połączenie z Kubernetesem w celu zweryfikowania ważności przedstawionego tokena oraz potwierdzenia tożsamości Poda, który go wysłał. Na końcu nadaje się dostęp do Vaulta.

Po pomyślnym zweryfikowaniu tożsamości przez serwer API, Vault upewnia się, że dany Pod jest autoryzowany do dostępu do żądanych zasobów. Wtedy wydaje on odpowiedni, krótko żyjący token z przypisanymi politykami bezpieczeństwa, eliminując ryzyko nieuprawnionego dostępu.

Integracja Vault z Terraform

Budowanie infrastruktury jako kodu (IaC) jest standardem w kulturze DevOps. Terraform to powszechne stosowane narzędzie służące do wdrażania i zarządzania infrastrukturą IT. Integracja z zewnętrznymi usługami wymusza posiadanie sekretów i prawidłowego zarządzania poświadczeniami.

Statyczne umieszczanie sekretów w plikach konfiguracyjnych lub zmiennej lokalnej do zarządzania infrastrukturą w chmurze publicznej jest przestarzałym i niewłaściwym modelem stosowanym w środowiskach produkcyjnych. Vault eliminuje ryzyko wycieku sekretów i utraty kontroli nad nimi poprzez rozbudowane mechanizmy zarządzające sekretami.

Zgodnie z koncepcją Single Source of Truth, Terraform pobiera poświadczenia z Vaulta w czasie rzeczywistym, czyli dopiero podczas wykonywania takich poleceń jak terraform plan czy terraform apply. W tym momencie Vault generuje tymczasowe poświadczenia i przekazuje je do Terraforma. Używając oficjalnego dostawcy Vaulta, żadne dane wrażliwe nie trafiają do kodu infrastruktury, plików stanu (.terraform.tfstate) ani do katalogów konfiguracyjnych (.terraform/providers/). W efekcie kod jest czysty, a źródłem prawdy o dostępie i tożsamości pozostaje tylko Vault.

Ponadto można używać Terraforma do samego zarządzania konfiguracją Vaulta. Podejście Infrastructure as Code jest zalecane i stanowi jeden z fundamentów nowoczesnego bezpieczeństwa. Dzięki temu można w sposób deklaratywny definiować i wdrażać zmiany w Vaulcie, takie jak metody uwierzytelniania czy polityki dostępu. Wszystkie zmiany w politykach Vaulta są wersjonowane w repozytorium. Jest to zgodne z regułą Policy-as-Code i ułatwia audytowanie, kto, kiedy i jakie modyfikacje wprowadził. Ponadto IaC stanowi wsparcie dla Zero-Trust poprzez konfigurowanie systemu w zautomatyzowany i powtarzalny proces.

Zarządzanie Vaultem przy użyciu Terraforma ma także swoje ograniczenia. Terraforma nie używa się do codziennej operacyjnej pracy na sekretach, a nawet do tworzenia infrastruktury Vaulta. Powodem takiego podejścia jest to, że każdy sekret byłby zapisany w konfiguracji Terraforma i umieszczony w plikach .tfstate. Każda osoba mająca dostęp mogłaby z łatwością je odczytać. Administratorzy Vaulta powinni wypełniać sekretami Vaulta nie z poziomu implementacji kodu źródłowego, a przy użyciu CLI lub API.

Vault jako narzędzie do zapewniania spójności ze regulacjami i standardami bezpieczeństwa

Wymogi wielu standardów bezpieczeństwa i regulacji prawnych przekładają się na praktyczne zastosowanie i konkretne funkcje, które udostępnia Vault, zwłaszcza w kontekście rotacji sekretów i ich ograniczonego czasu życia.

Organizacje z branży finansowej, które przetwarzają dane kart płatniczych, zobowiązane są do ich przestrzegania. Standard PCI-DSS (Payment Card Industry Data Security Standard) szczegółowo określa sposoby zarządzania sekretami i Vault spełnia compliance dla nich. Jednym z wymogów prawnych jest niestosowanie domyślnych haseł dostarczanych przez dostawców na rzecz stosowania wymuszonej rotacji kluczy i certyfikatów.

Jak opisałem wcześniej, zarządzanie certyfikatami w środowisku Kubernetesa i mechanizm wydawania krótkotrawałych certyfikatów sprawiają, że okno potencjalnego ataku z użyciem skompromitowanego klucza prywatnego spada niemal do zera. Spełnia to rygorystyczne wymogi ochrony danych „w locie”. Z kolei silnik AWS w systemie Vault odpowiada za dynamiczną rotację kluczy dostępu. Używane są one przez zespoły deweloperskie i mikrosewisy, co gwarantuje częstą i w pełni zaautomatyzowaną wymianę sekretów.

Vault spełnia wymogi weryfikowalności i rozliczalności operacji płatniczych, które także są wymagane przez standard PCI DSS. Każda firma zobowiązana jest do udowodnienia, kto, kiedy i do jakich wrażliwych danych miał dostęp, a także dysponowania szczegółowym dziennikiem zdarzeń. Vault realizuje ten wymóg dzięki urządzeniom audytowym Audit Devices. Rejestrują one każde zapytanie, operację kryptograficzną czy wydanie sekretu, tworząc scentralizowany ślad audytowy gotowy do integracji z systemami monitoringu (np. SIEM) lub dowolnego narzędzia agregującego logi w celu wysyłania alertów w czasie rzeczywistym i przeprowadzania audytów zgodności.

Ponadto wytyczne instytutu NIST (National Institute of Standards and Technology) w publikacji 800-57 określają rekomendacje dotyczące zarządzania kluczami kryptograficznymi, a także narzucają ramy zarządzania cyklem życia kluczy i definiują maksymalny czas ich używania. Każda firma, która chce współpracować z administracją Stanów Zjednoczonych, musi spełniać te kryteria. Vault realizuje te wymagania poprzez wykorzystanie dynamicznych sekretów oraz automatyzację, generując poświadczenia „w locie” i nadając im krótki TTL.

Podsumowanie

HashiCorp Vault eliminuje zjawisko niebezpiecznego rozproszenia Secrets Sprawl w infrastrukturze, pełniąc rolę scentralizowanego Single Source of Truth w architekturze Zero-Trust. Zamiast polegać na długoterminowych hasłach podatnych na wyciek, system ten opiera się na dynamicznych poświadczeniach dostarczanych innym usługom, takim jak chmury publiczne, systemy bazodanowe albo aplikacje na Kubernetesie. Co istotne, sekrety generowane są w momencie ich wnioskowania przez użytkownika lub aplikacje na z góry ustalony krótki czas życia. To automatyzuje rotację sekretów i minimalizuje ryzyko nadużyć lub niebezpieczeństw ze strony hakerów.

Szyfrowanie i rotacja to dwa filary bezpieczeństwa sekretów, ale rotacja jest kluczowa dla ochrony przed skutkami wycieku. W połączeniu z narzędziami takimi jak Vault i Terraform strategia „Rotation-First” zapewnia kompleksową ochronę, elastyczność i zgodność z najlepszymi praktykami. W nowoczesnych organizacjach rotacja powinna być priorytetem – nie tylko szyfrowanie.

Zintegrowanie Vaulta z Terraformem dostarcza dodatkowe korzyści zarządzania krytyczną infrastrukturą. Zapewnia ona audytowalność i kontrolę nad kodem. Vault izoluje całkowicie sekrety i certyfikaty od kodu źródłowego i plików konfiguracyjnych dla innych usług oraz aplikacji. Ponadto zapewnia ochronę przed długotrwałym użyciem skompromitowanych poświadczeń. Nawet jeśli klucz lub token zostanie przechwycony przez phishing lub niedopatrzenie DevOpsa, to szyfrowanie nie pomoże. Atakujący może używać sekretu w nieskończoność. Z tego względu rotacja natychmiast unieważnia skradzione dane, ograniczając okno podatności do minimum.

Vault gwarantuje zgodność ze standardami bezpieczeństwa, takimi jak PCI DSS czy NIST, dzięki scentralizowanemu zarządzaniu poświadczeniami oraz automatyzacji procesów kryptograficznych w oparciu o architekturę Zero-Trust. Platforma ta dynamicznie generuje i rotuje krótkotrwałe sekrety, co spełnia surowe wymogi standardu PCI DSS 4.0 i drastycznie minimalizuje ryzyko wycieku danych. Ponadto Vault precyzyjnie rejestruje każdą akcję w cyklu życia sekretu, dostarczając szczegółowe dzienniki audytowe niezbędne do udowodnienia bezwzględnej kontroli nad dostępem.

Zostaw komentarz