Istnieje wiele sposobów udostępniania stron internetowych – od ręcznego tworzenia stron HTML (lub, coraz częściej, generowania ich za pomocą sztucznej inteligencji), poprzez generatory stron statycznych i rozwiązania typu headless, aż po bardziej ustrukturyzowane i wyspecjalizowane portale oraz w pełni funkcjonalne systemy CMS (systemy zarządzania treścią).

Od wszystkich tych rozwiązań oczekuje się szybkiego, niezawodnego i bezpiecznego dostarczania treści.

Wydajność strony internetowej to nie tylko kwestia techniczna – ma ona bezpośredni wpływ na:

- wrażenia użytkowników,

- dostępność,

- pozycje w wyszukiwarkach,

- konwersje,

- wyniki biznesowe.

Badania nieustannie pokazują, że użytkownicy oczekują, iż strony załadują się w ciągu kilku sekund, a każda dodatkowa sekunda opóźnienia znacznie zwiększa współczynnik odrzuceń. Firma Google uwzględniła szybkość działania strony jako czynnik rankingowy, co oznacza, że szybsze strony internetowe zyskują na widoczności, podczas gdy wolniejsze znikają w wynikach wyszukiwania.

W niniejszym artykule omówiono praktyczne techniki pozwalające uzyskać niezwykle szybkie strony internetowe:

- od strategii buforowania obsługujących większość żądań,

- poprzez optymalizację zasobów zmniejszającą rozmiar plików,

- aż po usprawnienia sieciowe i optymalizację wskaźników Core Web Vitals.

W stosownych przypadkach wskazano funkcje platformy Adobe Experience Manager (AEM), które wspierają te optymalizacje.

W czasach, gdy sztuczna inteligencja generuje nadmiernie długie artykuły, które – jak na ironię – często trzeba najpierw streścić za pomocą tej samej sztucznej inteligencji, aby w ogóle dało się je przeczytać, postaram się zadbać o zwięzłość treści i unikać niepotrzebnej zawiłości oraz ozdobników.

Pamięć podręczna (Cache)

Zazwyczaj twórcy aplikacji backendowych skupiają się na wydajności kodu i czasie generowania stron, ale w rzeczywistości najważniejszym czynnikiem wpływającym na poprawę wydajności stron internetowych jest buforowanie.

Jeśli żądanie może zostać obsłużone z pamięci podręcznej, ścieżka kodu backendowego często nie ma żadnego znaczenia. Upewnij się, że wygenerowane odpowiedzi są prawidłowo buforowane i nie trzeba ich odtwarzać ani zawsze dostarczać bezpośrednio ze źródła. Przy prawidłowej konfiguracji powinno to obsłużyć od 80% do 95% całego ruchu publicznego, choć treści spersonalizowane i wymagające uwierzytelnienia w naturalny sposób ograniczają zakres treści, które można buforować.

Myśl warstwowo:

- pamięć podręczna przeglądarki,

- pamięć podręczna sieci CDN lub serwera proxy odwrotnego,

- warstwa pamięci podręcznej serwera WWW,

- pamięć podręczna wyników aplikacji (jeśli dotyczy).

W przypadku usługi AEM as a Cloud Service ruch zazwyczaj przechodzi przez sieć CDN i moduł Dispatcher, zanim dotrze do instancji publikujących.

Zapis pamięci podręcznej (Cache Store)

Treści statyczne można przechowywać w pamięci podręcznej. Większość serwerów WWW, takich jak Nginx czy Apache, serwerów reverse-proxy oraz urządzeń równoważących obciążenie, np. HAProxy, które zazwyczaj umieszcza się przed backendem, posiada własne mechanizmy lokalnego buforowania plików. Wymagają one jednak starannej konfiguracji, aby idealnie współpracowały z backendem.

AEM udostępnia własny moduł Apache do obsługi połączeń z instancjami AEM oraz zestaw reguł umożliwiających prawidłowe zarządzanie pamięcią podręczną treści statycznych (plików HTML, bibliotek ClientLib, zasobów DAM itp.). Inną potencjalną warstwą buforującą może być sieć dostarczania treści (CDN), która została opisana w sekcji „Sieć”.

Najważniejsze jest nie tylko posiadanie pamięci podręcznej, ale także dostosowanie jej działania do charakteru treści:

- intensywnie buforuj zasoby publiczne,

- buforuj publiczny kod HTML, gdy pozwalają na to reguły biznesowe,

- nigdy nie buforuj spersonalizowanych odpowiedzi w warstwach współdzielonych,

- unikaj niepotrzebnej fragmentacji pamięci podręcznej spowodowanej parametrami zapytania lub zbyt ogólnymi nagłówkami HTTP Vary.

Jeśli klucz pamięci podręcznej ulegnie zmianie z przyczyn, które nie wpływają na treść odpowiedzi, spadnie współczynnik trafień, a serwer źródłowy będzie wykonywał dodatkową pracę bez żadnych korzyści dla użytkownika.

Nagłówek Cache-Control

Jednym z najważniejszych sposobów opisania właściwości buforowania jest nagłówek Cache-Control w odpowiedziach HTTP dla konkretnego adresu URL. Istnieją ważne, ale często pomijane i niezrozumiałe opcje, które wskazują na charakter odpowiedzi i które warto wziąć pod uwagę w przypadku każdego typu odpowiedzi:

public– mogą być buforowane na każdym poziomie wspólnej pamięci podręcznej, np. publiczne statyczne pliki HTML i zasoby (obrazy, filmy, dokumenty),private– treści spersonalizowane dla użytkownika, które NIE MOGĄ być buforowane między backendem a przeglądarką użytkownika, ale MOGĄ być buforowane w przeglądarce,immutable– treść nie ulegnie zmianie – idealne dla plików lub dokumentów, których wersje są oznaczone w nazwie pliku, albo modułów JavaScript z skrótem treści w nazwie pliku,no-cachevsno-store– często mylące: „no-cache” oznacza, że odpowiedź MOŻE zostać zapisana w pamięci podręcznej przeglądarki, ale wymaga ponownej weryfikacji, podczas gdy „no-store” całkowicie zabrania buforowania, dlatego znacznie lepiej sprawdza się w przypadku wrażliwych treści (np. danych osobowych lub tokenów uwierzytelniających),max-age– czas ważności w przeglądarce,s-maxage– czas ważności w pamięci podręcznej współdzielonej; przydatne, gdy czasy TTL w sieci CDN i przeglądarce powinny się różnić,- s

tale-while-revalidate– pozwala pamięciom podręcznym na wysyłanie nieaktualnej odpowiedzi podczas jej odświeżania w tle, stale-if-error– pozwala na wykorzystanie nieaktualnej treści w przypadku awarii serwera źródłowego.

Typowe wzorce to:

public, max-age=31536000, immutabledla zasobów używających funkcji skrótów (hash) bazujących na zawartości w URL,public, max-age=300, stale-while-revalidate=3600dla często aktualizowanych stron HTML,private, no-cachedla stron personalizowanych,no-storedla odpowiedzi wrażliwych (np. danych osobowych, tokenów uwierzytelniających).

Dzięki odpowiedniej konfiguracji nagłówka Cache-Control można w pełni kontrolować, które elementy mogą być buforowane, a które nie, zapewniając nie tylko szybkie wyświetlanie plików strony internetowej, ale także zapobiegając przypadkowym wyciekom danych spowodowanym nieprawidłowo skonfigurowaną pamięcią podręczną.

W środowiskach AEM często warto zarządzać pamięcią podręczną przeglądarki i pamięcią podręczną brzegową/współdzieloną niezależnie. Jeśli Twoja sieć CDN obsługuje nagłówki pamięci podręcznej zastępczej, korzystaj z nich świadomie, zamiast narzucać wszędzie ten sam czas TTL.

Optymalizacja zasobów

Współczesne strony internetowe są pełne obrazów, zdjęć i filmów. Pliki te są duże – często mają po kilka lub nawet kilkadziesiąt megabajtów. Obecnie przeglądarki internetowe szybko się rozwijają, a dzięki automatycznym aktualizacjom większość użytkowników korzysta z ich najnowszych wersji. Dzięki nowym protokołom i formatom plików obsługiwanym przez nowoczesne przeglądarki możliwe jest szybsze dostarczanie mniejszych zasobów. Nie chodzi tu tylko o zmniejszenie rozmiarów plików, ale także o ograniczenie liczby bajtów na ścieżce krytycznej.

Obrazy i zdjęcia

Zamiast udostępniać pojedynczy plik źródłowy lub zdjęcie, przygotuj lub wygeneruj na żądanie plik lub zdjęcie w wielu rozdzielczościach, lepiej dostosowanych do różnych urządzeń i obszarów wyświetlania.

AEM Assets automatycznie zmienia rozmiar pliku źródłowego po dodaniu, aby przygotować wiele rozdzielczości (zwanych „renditions”). Atrybut srcset tagów <img> i <source> pozwala na określenie wielu wariantów rozdzielczości (wspomnianych „renditions”), natomiast atrybut sizes umożliwia zdefiniowanie stosunku widocznego obrazu na stronie do rozmiaru okna przeglądarki, a sama przeglądarka zoptymalizuje wybór odpowiedniej wersji.

Należy użyć tagu <picture> wraz z wieloma tagami <source>, aby zdefiniować różne obrazy dla różnych rozmiarów okna przeglądarki – jest to szczególnie przydatne w przypadku dostarczania różnych obrazów dla orientacji pionowej i poziomej lub różnych formatów.

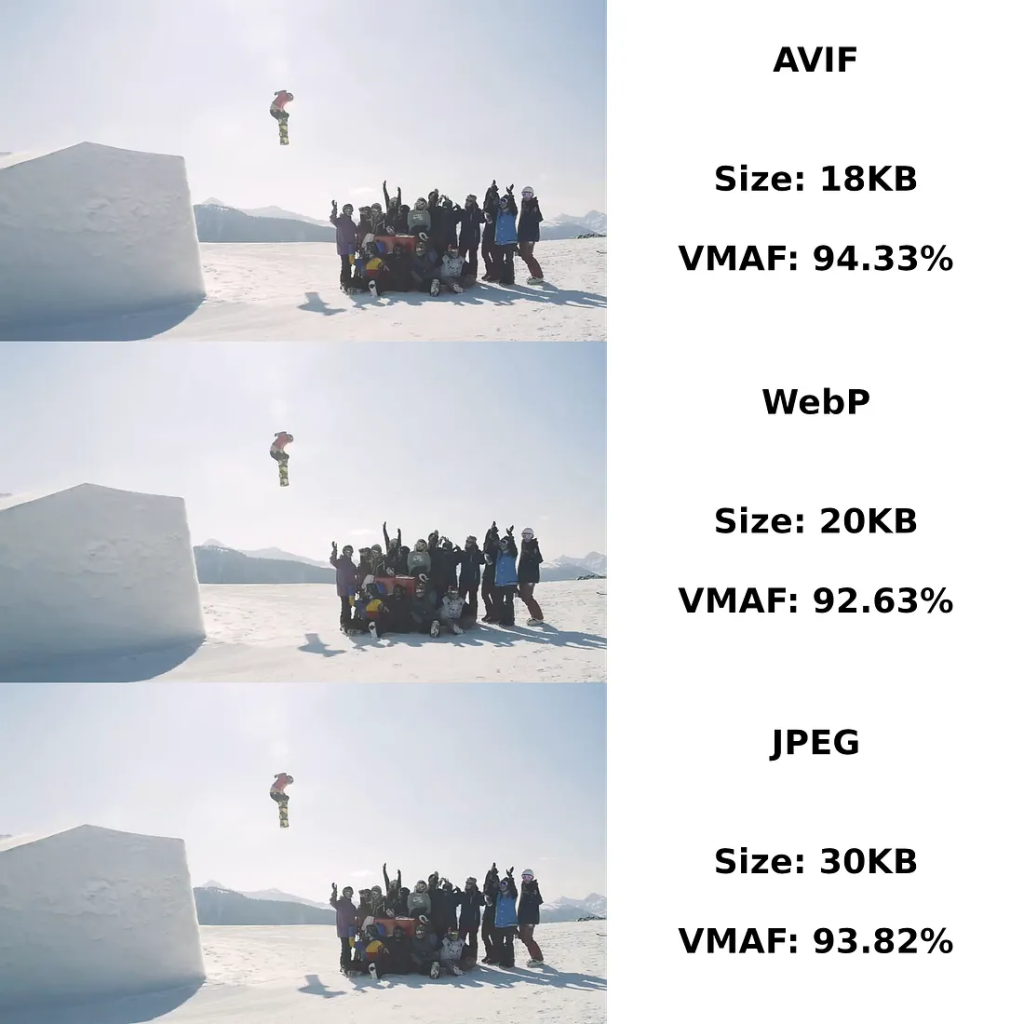

Nie musisz już ograniczać się do formatu JPEG przy wyświetlaniu obrazów. Do ikon, logotypów i diagramów używaj formatu SVG. W przypadku obrazów rastrowych format WebP jest zdecydowanym faworytem, a format AVIF zyskuje na popularności, podczas gdy JPEG i PNG nadal stanowią praktyczne rozwiązania awaryjne. Format WebP pozwala zmniejszyć rozmiar zdjęcia o około 30% w porównaniu z formatem JPEG, a przejście na format AVIF często zapewnia dodatkową redukcję rozmiaru.

AVIF jest obecnie obsługiwany przez około 95% przeglądarek na całym świecie, jednak użycie formatu awaryjnego nadal stanowi bezpieczniejsze rozwiązanie domyślne niż założenie, że jeden format będzie zawsze działał wszędzie. AEM as a Cloud Service obsługuje wersje plików WebP zoptymalizowane pod kątem sieci.

Zmiana formatu plików graficznych może nie być możliwa w przypadku istniejących aplikacji, ale powinno dać się zoptymalizować istniejące pliki PNG oraz ponownie zakodować istniejące pliki JPEG przy użyciu silniejszej kompresji, zachowując jednocześnie wysoką jakość obrazu.

Zastanów się, które obrazy są kluczowe. Zawsze podawaj dokładną szerokość i wysokość, aby przeglądarka mogła zarezerwować miejsce i ograniczyć przesunięcia w układzie strony. W przypadku obrazów, które nie są kluczowe, używaj atrybutu loading="lazy", ale nie stosuj opóźnionego ładowania obrazu, który prawdopodobnie będzie miał największy wpływ na LCP. W przypadku najważniejszego obrazu rozważ użycie atrybutu fetchpriority="high" i wczytaj go z wyprzedzeniem, jeśli w przeciwnym razie przeglądarka wykryłaby go zbyt późno.

AEM Image Core Component obsługuje różne wersje obrazów, ładowanie z opóźnieniem, teksty alternatywne (dla czytników ekranu), linkowanie oraz inne opcje. Należy sprawdzić, czy generuje on stałe wymiary i responsywny kod, a także czy szablony stron nie ładują obrazu głównego z opóźnieniem.

Wideo

Przez lata standardem w sieci do udostępniania filmów był format H.264 (zazwyczaj w plikach MP4). Kodek VP9 pozwala znacznie obniżyć przepływność w porównaniu z H.264. AV1 pozwala obniżyć ją jeszcze bardziej, a HEVC/H.265 może być przydatny zwłaszcza w środowiskach, w których dominują urządzenia Apple. Jednak obsługa przez przeglądarki, licencje, obsługa dekodowania sprzętowego i zużycie energii mają znaczenie, więc praktycznie rzadko wybiera się jeden „najlepszy” kodek do każdego przypadku.

Podobnie jak w przypadku obrazów, zmiana formatu plików wideo może okazać się niemożliwa w istniejących aplikacjach, a źródłowy projekt wideo może nie być dostępny.

Warto jednak spróbować ponownie zakodować pliki wideo, nawet przy użyciu tego samego kodeka, włączając przetwarzanie dwuetapowe oraz umieszczanie atomów fast-start/moov (jeśli jest to obsługiwane), stosując wolniejsze ustawienia przetwarzania, a także wybierając najnowszy koder programowy zamiast sprzętowego. Takie ponowne kodowanie może zająć sporo czasu i spowodować pewną utratę jakości, ale o ile różnica nie jest zauważalna gołym okiem, a plik wynikowy jest znacznie mniejszy i lepiej zoptymalizowany pod kątem internetu, warto rozważyć zastąpienie poprzedniego pliku.

W przypadku ważnych treści wideo lepszym rozwiązaniem niż pojedynczy plik do pobrania może być strumieniowanie adaptacyjne oraz wiele wariantów <source>. W przypadku mniej istotnych filmów należy użyć obrazu plakatu oraz ustawić atrybut preload="metadata" lub preload="none", a filmy odtwarzane w tle powinny być wyciszone, krótkie i opcjonalne.

Aby zachować najwyższą jakość, warto renderować projekt wideo bezpośrednio z pliku źródłowego do lepszego kodeka w programie do edycji wideo, zamiast ponownie kompresować gotowy film. Dlatego sensownie jest rozważyć renderowanie wszystkich nowych materiałów wideo bezpośrednio do kodeków VP9 lub AV1 przed przesłaniem ich do systemu DAM. W przypadku przepływów pracy w systemie AEM DAM należy zachować wysokiej jakości pliki źródłowe w kodekach edycyjnych, ale publikować wersje przeznaczone do wyświetlania w sieci, a nie surowe pliki źródłowe.

Zaawansowane techniki Frontend

Procesowanie w tle

Przenieś obciążające zadania JavaScript do modułów Web Workers w celu równoległego wykonywania, zapobiegając w ten sposób blokowaniu głównego wątku. Dostępna jest również ulepszona obsługa pamięci współdzielonej (za pośrednictwem SharedArrayBuffer), która umożliwia wydajną wymianę danych między modułami a głównym wątkiem, ale wyłącznie w bezpiecznym kontekście izolowanym międzydomenowo, co zazwyczaj wymaga nagłówków Cross-Origin-Opener-Policy i Cross-Origin-Embedder-Policy.

WebAssembly (WASM)

Skompiluj kod o kluczowym znaczeniu dla wydajności do formatu WASM lub skorzystaj z istniejących bibliotek dystrybucyjnych, aby uzyskać prędkość zbliżoną do natywnej w przeglądarce.

Rozwiązanie to idealnie nadaje się do zadań wymagających dużej mocy obliczeniowej, takich jak przetwarzanie obrazów czy gier, umożliwiając osiągnięcie znacznego przyspieszenia (często od 2- do 10-krotnego lub nawet większego) w przypadku operacji obciążających system. Jest to przydatne w przypadku obciążeń wymagających dużej mocy obliczeniowej, a nie jako domyślny sposób na poprawę wydajności, gdy prawdziwym wąskim gardłem są opóźnienia sieciowe, blokowanie renderowania lub nadmierna aktywność DOM.

Cache API

Interfejs API pamięci podręcznej przeglądarki internetowej umożliwia przechowywanie obiektów typu „żądanie–odpowiedź” wygenerowanych przez JavaScript bezpośrednio w pamięci podręcznej przeglądarki. Pozwala on na przechowywanie dowolnych plików, w tym danych JSON i obrazów. Nie wymaga to użycia modułu Service Worker.

Należy uważać, aby nie stworzyć drugiego systemu buforowania, który kolidowałby z pamięcią podręczną przeglądarki i pamięcią podręczną sieci CDN. Unieważnienie zawartości pamięci podręcznej nadal stanowi największe wyzwanie.

Widoczność treści i rozmiar wewnętrzny

Użyj właściwości CSS content-visibility: auto, aby przeglądarka pominęła operacje związane z układem i renderowaniem elementów znajdujących się poza ekranem. Połącz to z właściwością contain-intrinsic-size, aby uniknąć przesunięć w układzie strony (CLS).

Jest to szczególnie przydatne w przypadku długich stron zawierających powtarzające się, samodzielne sekcje, ale należy dokładnie przetestować to rozwiązanie, ponieważ poprawa wydajności ma sens tylko wtedy, gdy nie wpływa negatywnie na dostępność ani na pomiary.

Sieć

Content Delivery Network

Ogólna zasada brzmi: Staraj się być jak najbliżej użytkowników swojej witryny.

Wybór odpowiedniego dostawcy usług hostingowych lub chmurowych oraz rozbudowa serwerów mogą przynieść pewne korzyści, ale wiążą się z dużymi kosztami. Prawda jest jednak taka, że bez sieci CDN trudno zapewnić wysoką dostępność na całym świecie, gdy serwery znajdują się w jednym centrum danych. W takich przypadkach największe przyspieszenie umożliwi treść odpowiednio buforowana w sieci CDN rozproszonej po całym świecie.

Traktuj CDN i Dispatcher lub działanie odwrotnego serwera proxy (reverse-proxy) jako jeden system, a nie dwa niepowiązane ze sobą elementy. Usuń lub zignoruj parametry marketingowe, które nie zmieniają treści, świadomie stosuj nagłówek Vary oraz korzystaj z dyrektyw stale-while-revalidate i stale-if-error, jeśli Twoja platforma je obsługuje.

HTTP/2

Włącz protokół HTTP/2 (a jeśli to możliwe, również HTTP/3) przynajmniej na najwyższym poziomie stosu backendowego (najlepiej z włączoną pamięcią podręczną). Ponieważ większość stron internetowych udostępnia wiele plików, multipleksowanie znacznie przyspieszy transfer, jednak mniejsza liczba żądań nie oznacza już automatycznie lepszego rozwiązania.

Należy unikać zarówno zbędnych żądań, jak i jednego ogromnego pakietu synchronicznego – prawdziwym celem jest wczesne wykrywanie i właściwe ustalanie priorytetów kluczowych zasobów. Moduł AEM Dispatcher na serwerze Apache nie jest uzależniony od wersji protokołu HTTP, więc jeśli na serwerze Apache włączono protokół HTTP/2, będzie on działał poprawnie z modułem AEM Dispatcher. Sieć dostarczania treści AEM domyślnie obsługuje protokół HTTP/2.

Kompresja HTTP

Większość przeglądarek internetowych obsługuje kompresję danych, dlatego należy upewnić się, że jest ona włączona po stronie serwera. Należy kompresować zasoby tekstowe, takie jak HTML, CSS, JS, JSON i SVG. Przeglądarki internetowe obsługują wiele algorytmów kompresji: od „klasycznego” Gzip, przez obecnie zalecany i powszechnie obsługiwany Brotli, aż po coraz częściej stosowany Zstandard (Zstd).

Nie należy oczekiwać znaczącego zmniejszenia rozmiaru przy próbie ponownej kompresji już skompresowanych plików multimedialnych, takich jak JPEG, WebP, AVIF, MP4 czy większości podzbiorów czcionek. Niektóre serwery buforujące i sieci CDN umożliwiają wstępną kompresję i przechowywanie plików w oddzielnych plikach buforowanych, dzięki czemu są one gotowe do dostarczenia jako już skompresowane odpowiedzi.

Core Web Vitals

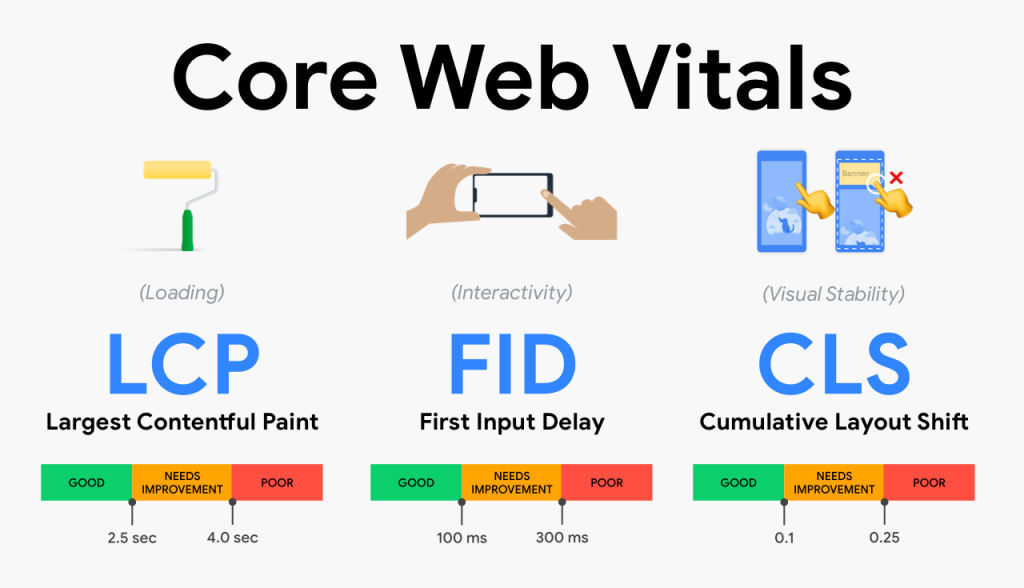

Firma Google określiła konkretne wskaźniki służące do pomiaru rzeczywistej wydajności strony pod kątem komfortu użytkowania i nazwała je Core Web Vitals (w luźnym tłumaczeniu: „Podstawowe Wskaźniki Internetowe”):

- Largest Contentful Paint (LCP): Wydajność ładowania (odczuwalna prędkość ładowania),

- Interaction To Next Paint (INP): Responsywność (opóźnienie interakcji),

- Cumulative Layout Shift (CLS): Stabilność wizualna (nieoczekiwane zmiany układu).

Należy dbać o to, by te wskaźniki były jak najniższe – wymaga to szybkiej aplikacji frontendowej oraz błyskawicznych odpowiedzi (lub pamięci podręcznej) ze strony serwerów. Obecne wartości docelowe to LCP <= 2.5 s, INP <= 200 ms oraz CLS <= 0.1 w 75. percentylu danych od rzeczywistych użytkowników. Narzędzie Lighthouse jest przydatne do debugowania, ale to CrUX i RUM pokazują, jak faktycznie wygląda doświadczenie użytkowników.

Rozważmy, jak w praktyce można poprawić każdą metrykę w istniejącej aplikacji internetowej.

Largest Contentful Paint

Aby poprawić wydajność ładowania, należy ładować wyłącznie style i skrypty, które są rzeczywiście przydatne dla danej strony. Każdy dodatkowy plik wpływa na liczbę żądań, czas transferu oraz czas przetwarzania (oceny) i może opóźnić wykrycie zasobu LCP. Należy szybko dostarczać kod HTML i sprawić, by obraz lub tekst główny był wykrywalny w początkowej części kodu HTML, a następnie wstępnie załadować zasób LCP. Jeśli jego wykrycie nastąpiłoby zbyt późno, oznaczyć obraz LCP atrybutem fetchpriority="high" oraz nie stosować do niego ładowania opóźnionego.

AEM udostępnia mechanizm o nazwie ClientLibs, który zarządza grupowaniem skryptów i arkuszy stylów, dbając o ich właściwą kolejność (zarówno w obrębie jednego pakietu, jak i pomiędzy kilkoma pakietami, które są od siebie zależne).

Dzięki odpowiedniemu podziałowi funkcji witryny i bibliotek zależności na pakiety ClientLibs można znacznie ograniczyć liczbę zbędnych żądań oraz skutecznie buforować pakiety zarówno po stronie serwera, jak i po stronie klienta.

Przeglądarki internetowe automatycznie buforują odpowiedzi, nawet jeśli nie zostały o to poproszone, więc bezpośrednie udostępnianie plików JavaScript lub CSS przy użyciu tych samych adresów URL może prowadzić do niespójności, ponieważ przeglądarka może przetworzyć wcześniej zapisaną w pamięci podręcznej wersję pliku.

Na szczęście mechanizm AEM ClientLibs automatycznie rozwiązuje ten problem (poprzez dodanie skrótu-hash zawartości do nazwy pliku pakietu). Biblioteki ClientLibs obsługują opcjonalną minifikację, co pozwala dodatkowo skrócić czas przesyłania i przetwarzania.

Jednak w przypadku protokołów HTTP/2 i HTTP/3 mniejsza liczba żądań nie zawsze oznacza automatycznie lepsze wyniki – należy dbać o to, by krytyczne pliki CSS były niewielkie, unikać stosowania jednego ogromnego pakietu JavaScript blokującego ładowanie całej witryny oraz, w miarę możliwości, dzielić funkcje według tras lub potrzeb. Warto pamiętać o opóźnionym ładowaniu elementów analitycznych i reklam po wstępnym wyrenderowaniu strony.

Powinniśmy również rozważyć optymalizację zasobów, wykorzystanie sieci, zaawansowane techniki frontendu oraz prawidłową konfigurację buforowania, zgodnie z opisem w poprzednich sekcjach.

Interaction To Next Paint

Poprawa płynności działania może być trudniejsza i może wymagać włączenia trybu debugowania w przeglądarce internetowej.

Sprawdź, która interakcja faktycznie przebiega najwolniej – wskaźnik INP mierzy płynność działania w trakcie całej wizyty, a nie tylko przy pierwszym kliknięciu. Upewnij się, że żadne zadania JavaScript nie blokują głównego wątku – w razie potrzeby skorzystaj z Web Workers i podziel długotrwałe zadania na mniejsze części, aby przeglądarka mogła szybciej wyświetlać zawartość.

Duży model DOM (Document Object Model) zawierający zbyt wiele elementów, nadmiernie skomplikowane definicje układu oraz złożone aktualizacje interfejsu powodują spowolnienie działania strony. Obciążające skrypty stron trzecich mogą nie być zoptymalizowane – sprawdź dostępność aktualizacji lub alternatywnych rozwiązań. Zapewnij wizualną informację zwrotną na wczesnym etapie, nawet jeśli cała operacja zostanie zakończona później.

Cumulative Layout Shift

Jeśli układ strony miga podczas ładowania lub elementy szybko przemieszczają się w inne miejsca, oznacza to niestabilność wizualną. Należy rozważyć wstępne obliczenie układu, uwzględniając różne rozmiary i orientacje okna przeglądarki. Zamiast stosować układ i stylizację za pomocą skryptów, lepiej jest wykonać to wyłącznie w CSS, a nawet oznaczyć elementy do wstępnego ładowania.

W miejscach na stronie, które wymagają dynamicznego ładowania zasobów i informacji, należy stosować symbole zastępcze lub szkielety. Zawsze powinniśmy określać szerokość i wysokość obrazów, stosować symbole zastępcze oparte na proporcjach (aspect-ratio) lub o stałych wymiarach w przypadku plików multimedialnych, elementów osadzonych i reklam, rezerwować stałe miejsca na treści dynamiczne oraz stosować animacje z wykorzystaniem transformacji (transform) i krycia (opacity) zamiast właściwości wpływających na układ strony.

Infrastruktura

Aby przyspieszyć działanie backendu, można dodać więcej serwerów lub zastosować szybsze oprogramowanie – Kapitan Oczywistość, do usług!

Właśnie dlatego pozostawiłem temat infrastruktury jako ostatnią sekcję przed podsumowaniem, ale ponieważ nie możemy po prostu pominąć tej kwestii, przyjrzyjmy się jej pokrótce. Infrastruktura często nie jest właściwym punktem wyjścia, ponieważ większa moc obliczeniowa procesora nie rozwiąże problemów związanych z opóźnionym wykrywaniem zasobów, nieodpowiednią polityką buforowania czy zbyt dużymi plikami multimedialnymi.

Serwery

W przypadku serwerów (zarówno wirtualnych, jak i fizycznych) można skalować je pionowo (w górę) poprzez dodawanie kolejnych zasobów (procesorów, pamięci RAM, miejsca na dysku). Podczas pracy w środowisku wirtualnym (np. na serwerach VPS – Virtual Private Servers) zasoby są współdzielone z innymi serwerami wirtualnymi i nawet jeśli zostały przydzielone, nie zawsze są w pełni dostępne (zazwyczaj nie ma na to gwarancji).

Jeśli Twoja aplikacja obsługuje skalowanie horyzontalne, możesz również dodać kolejne serwery. W przypadku korzystania z usług dostawców chmury obliczeniowej proces ten można zautomatyzować w zależności od zapotrzebowania.

Ważne jest również umiejscowienie serwera. Jeśli kluczowe zasoby znajdują się w innym źródle, przeglądarka może wymagać dodatkowej konfiguracji DNS, TCP, TLS i protokołów, zanim będzie mogła je pobrać, dlatego dostarczanie kluczowych zasobów z tego samego źródła jest często prostsze i szybsze.

Oprogramowanie

Zaktualizuj lub wymień oprogramowanie. Sprawdź i przeanalizuj każdą aplikację w swoim środowisku. Przestarzałe aplikacje lub ich zależności mogą działać wolniej (a także, co oczywiste, stwarzać zagrożenie dla bezpieczeństwa). Nowsze wersje są zazwyczaj zoptymalizowane i bezpieczniejsze, dlatego tak ważne jest, aby je aktualizować. Jeśli oprogramowanie nie jest już aktualizowane lub dostępne są szybsze (a najlepiej także bezpieczniejsze) alternatywy, warto rozważyć jego wymianę.

Korzystając z kompleksowych rozwiązań, takich jak Adobe Experience Cloud – czyli platformy do tworzenia stron internetowych klasy korporacyjnej, obejmującej zarządzanie treścią, zasobami cyfrowymi (obrazami, filmami, dokumentami) oraz obsługę formularzy – wszystkie aplikacje są utrzymywane przez dostawcę i automatycznie aktualizowane.

W przypadku AEM tradycyjne rozwiązanie oparte na serwisach, dyspozytorze (module Dispatcher) i sieci CDN nadal sprawdza się i może działać szybko, jeśli jest odpowiednio skonfigurowane. Natomiast AEM jako usługa w chmurze zapewnia zarządzane aktualizacje oraz wersjonowane biblioteki ClientLibs z długotrwałą pamięcią podręczną.

Podsumowanie

Najszybszą stroną internetową byłaby strona statyczna, której pliki nadają się w pełni do buforowania i są rozmieszczone na całym świecie. Jednak dla większości przypadków nie jest to możliwe ze względu na biznesową konieczność częstych aktualizacji stron oraz dynamicznych treści dostosowanych do konkretnych użytkowników.

Wybierając odpowiedni stos technologiczny i konfigurując go właściwie, można obsłużyć miliony żądań dziennie bez gwałtownego wzrostu kosztów. W przypadku istniejących stron internetowych należy najpierw skupić się na odpowiednich ustawieniach buforowania (zarówno po stronie serwera, jak i klienta) oraz optymalizacji ścieżki LCP, a następnie usunąć zbędne arkusze CSS i skrypty JavaScript blokujące renderowanie oraz odpowiednio skompresować i zmienić rozmiar plików multimedialnych.

Optymalizacje te nie zawsze wymagają znaczących zmian w kodzie źródłowym i infrastrukturze, a mimo to mogą znacznie poprawić wydajność. Jeśli dysponujesz odpowiednią ilością czasu i środków, rozważ inne możliwości.

Podsumowując najważniejsze omówione zagadnienia:

- Buforowanie stanowi podstawę – przy odpowiedniej konfiguracji obsługuje ono zdecydowaną większość publicznych żądań.

- Optymalizacja zasobów poprzez wykorzystanie nowoczesnych formatów obrazów (WebP, AVIF), podawanie konkretnych wymiarów oraz usprawnione dostarczanie plików wideo pozwala zmniejszyć rozmiar plików i poprawić renderowanie bez widocznej utraty jakości.

- Ulepszenia sieciowe, takie jak CDN, HTTP/2, HTTP/3 oraz algorytmy kompresji (Brotli, Zstandard), dodatkowo skracają opóźnienia i czas przesyłania danych.

- Wskaźniki Core Web Vitals określają mierzalne cele dotyczące szybkości ładowania, responsywności i stabilności wizualnej.

Pamiętaj, że optymalizacja wydajności to proces ciągły, a nie jednorazowe zadanie.

Wraz z rozwojem przeglądarek i pojawianiem się nowych standardów, wciąż dochodzą nowe możliwości ulepszeń. Zacznij od podstaw, dokonuj pomiarów na podstawie danych od rzeczywistych użytkowników i wprowadzaj kolejne zmiany.

Szybka strona internetowa to nie tylko przewaga techniczna – zapewnia ona lepsze wrażenia użytkownika, zajmuje wyższe pozycje w wynikach wyszukiwania, szybciej pojawia się w odpowiedziach czatu opartego na sztucznej inteligencji, a ostatecznie przyczynia się do osiągnięcia lepszych wyników biznesowych.

Zostaw komentarz