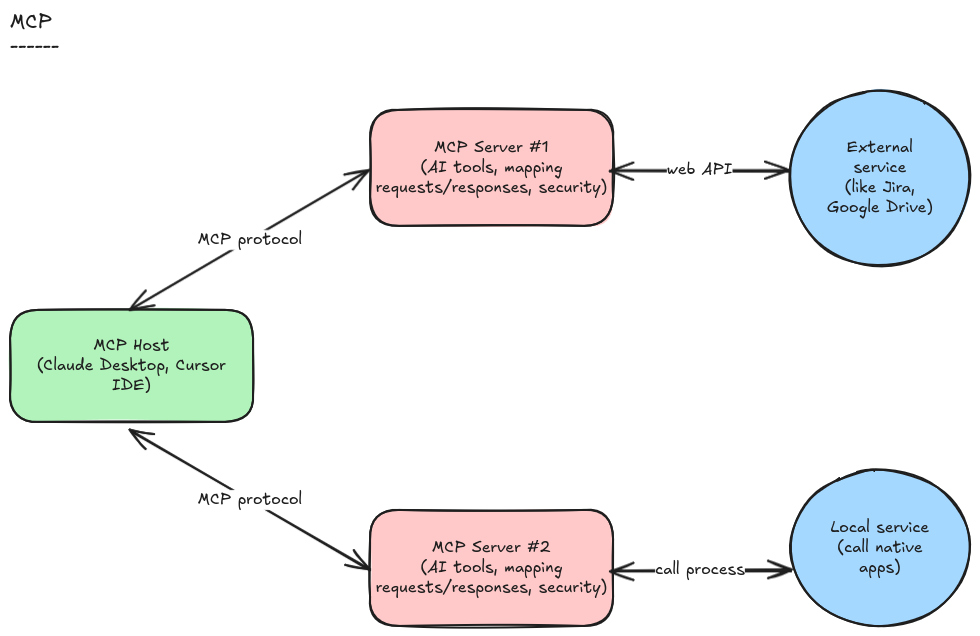

Serwery MCP są jednym z najważniejszych tematów ubiegłego roku w dziedzinie AI. Stanowią komponenty w architekturze aplikacji, które rozszerzają możliwości LLM-a (LLM, Large Language Model – duży model językowy, czyli algorytm głębokiego uczenia, który może wykonywać zadania przetwarzania języka naturalnego (NLP)).

Każdy serwer MCP jest rodzajem wtyczki, dzięki której aplikacja może łączyć się z innymi narzędziami, systemami oraz źródłami danych.

W serwerach MCP komunikację z modelem oparto na dokładnie udokumentowanym protokole o tej samej nazwie, czyli MCP (Model Context Protocol).

Pierwotnie MCP zostało zaprojektowane i opisane przez firmę Anthropic (odpowiedzialną za LLM Claude) i zaprezentowane w ich autorskiej aplikacji – Claude Desktop.

Co ciekawe, w listopadzie 2024 po oficjalnym zaprezentowaniu protokołu MCP, społeczność developerów nie przyjęła go zbyt entuzjastycznie, określając mianem „API dla API”, ponieważ mapował on funkcje dostępne w publicznym API usługi. Jednakże, wraz z upływem czasu i jego postępującym rozwojem, odkryto mnóstwo zalet tego protokołu i dziś można śmiało stwierdzić, że stosowanie MCP w aplikacjach AI (Aplikacja/Asystent AI – autonomiczny system AI podejmujący decyzje i wykonujący akcje z wykorzystaniem LLM-a oraz dodatkowych, zewnętrznych narzędzi) jest obecnie rekomendowanym podejściem.

Podsumowując, MCP jest protokołem komunikacyjnym dla aplikacji AI, analogicznym do protokołu HTTP w aplikacjach webowych. Dzięki jego zastosowaniu technologia, w jakiej zostało zbudowane narzędzie, staje się drugorzędna, gdyż wymiana informacji pomiędzy komponentami opiera się na udokumentowanym, otwartym protokole. Serwer MCP stanowi tu warstwę integracyjną, która łączy LLM ze światem zewnętrznym, zapewniając aplikacji zupełnie nowe możliwości.

Co dokładnie zapewnia MCP?

- Standaryzacja komunikacji — aplikacja AI potrafi uzyskać listę dostępnych narzędzi z danego serwera oraz rozumie ich przeznaczenie. To rozwiązuje problem konieczności programowania dodatkowych interfejsów do komunikacji z różnymi narzędziami czy źródłami danych. Protokół MCP wprowadził również struktury JSON-RPC 2.0 w przesyłanych wiadomościach.

- Rozszerzanie kontekstu LLM-a o dodatkową wiedzę dziedzinową/narzędzia, przy zachowaniu zasad bezpieczeństwa i kontroli dostępu do danych.

- MCP pozwala na tworzenie skomplikowanych procesów pozyskiwania danych z wielu źródeł (serwerów MCP), dzięki czemu aplikacja AI może wygenerować szczegółową odpowiedź lub wykonać skomplikowane zadanie.

- Powstałe repozytoria MCP zapewniają dostęp do poszerzającej się biblioteki gotowych serwerów integrujących aplikacje z popularnymi usługami jak np.: Git, PostgreSQL, Slack, JIRA i wielu innych.

- Ostatecznie, zastosowanie protokołu MCP znacznie ułatwia wymianę samego modelu (LLM-a) w aplikacji AI, bez konieczności wprowadzania jakichkolwiek zmian w zintegrowanych narzędziach.

Praktyczne przypadki użycia

- Asystenci AI mogą wykorzystywać MCP do zarządzania zadaniami w firmach, łącząc się z API systemów CRM, platform do zgłoszeń itp. Co za tym idzie – aplikacje AI dzięki narzędziom dostarczanym przez serwery MCP mogą realizować złożone zadania za użytkowników (np. automatyzować przepływ dokumentów w biurze).

- Aplikacje AI mogą tworzyć w czasie rzeczywistym zaawansowane raporty biznesowe, przykładowo – w branży e-commerce może to być raport sentymentu sporządzony na podstawie bieżących opinii klientów sklepu.

- Aplikacje AI wspierające developerów przy pracy nad kodem źródłowym czy też procesem deploymentu aplikacji (np. agenci kodowania w IDE, z dołączonymi narzędziami lokalnymi jak np. GIT).

Podłączenie serwera MCP (przykład no-code)

Obecnie istnieje wiele gotowych aplikacji AI, które dają możliwość natychmiastowego podpięcia dowolnego serwera MCP i co za tym idzie – przetestowania funkcji rozszerzania możliwości modelu. Jedną z popularnych platform tego typu jest Claude Desktop (dalej CD).

CD opiera się na LLM-ie Claude, który może być zainstalowany bezpośrednio na komputerze użytkownika, przez co LLM może m.in. skorzystać z lokalnych aplikacji i zasobów komputera (co nie jest możliwe w przypadku przeglądarkowej wersji Claude).

Instalacja i konfiguracja Claude Desktop

Info: W trakcie pracy nad artykułem napotkałem problem z przekazywaniem danych pomiędzy Claude Desktop a przeglądarką w sytuacji, gdy przeglądarka Chrome nie była ustawiona jako domyślna. W związku z zaistniałą sytuacją rekomenduję ustawienie Chrome’a (przynajmniej czasowo) jako przeglądarki domyślnej.

Ważne: Od niedawna web-konektory (MCP dla usług zdalnych) wymagają płatnej subskrypcji Claude. Bezpłatnie natomiast są wciąż konektory lokalne (desktop). Niniejszy artykuł opiera się na funkcjach z płatnej subskrypcji.

Do dzieła!

Aby, rozpocząć prace z aplikacją kliencką Claude Desktop, musimy pobrać instalator ze strony: https://claude.ai/download

Po udanej instalacji i uruchomieniu automatycznie rozpocznie się proces zakładania/logowania do konta.

W trakcie postępu instalacji, na ekranie Plans that grow with you, należy wskazać płatny plan np.

Pro, po czym opłacić subskrypcję i przejść dalej.

Co ważne, na pewnym etapie instalacji CD zaprezentuje nam jeszcze jeden ekran z sugerowanymi ideami. W tym miejscu warto wybrać opcję I have own topic, ponieważ będziemy robić eksperymenty własne.

Integracja predefiniowanego serwera MCP z Claude

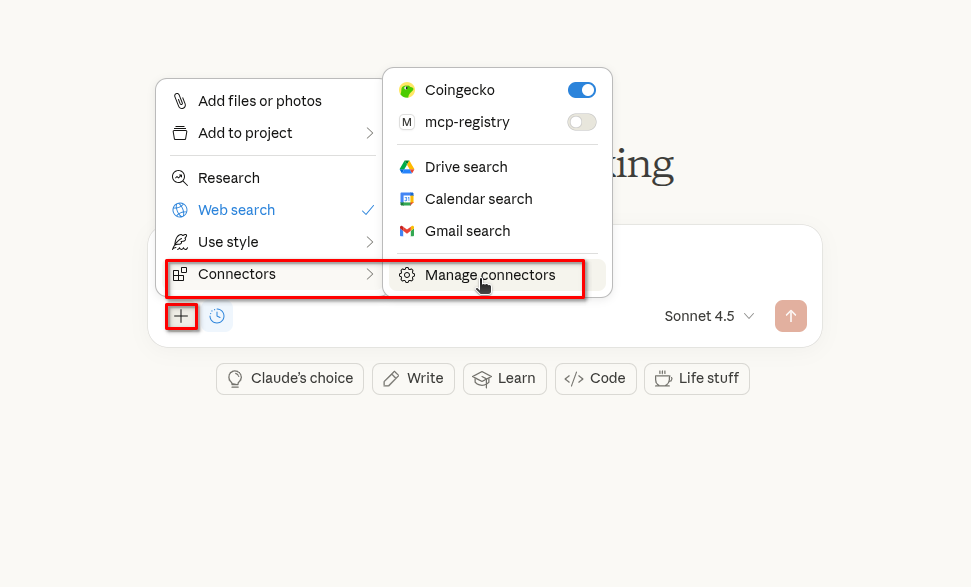

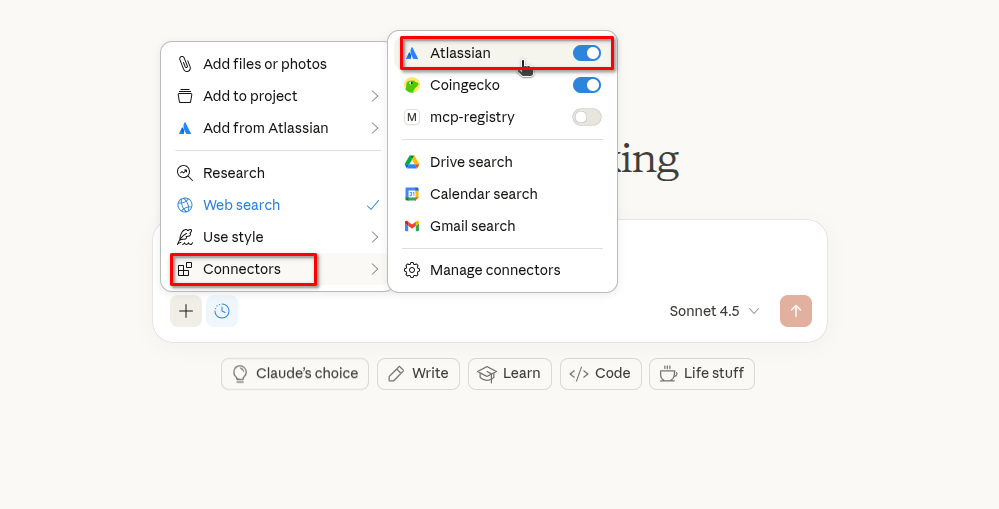

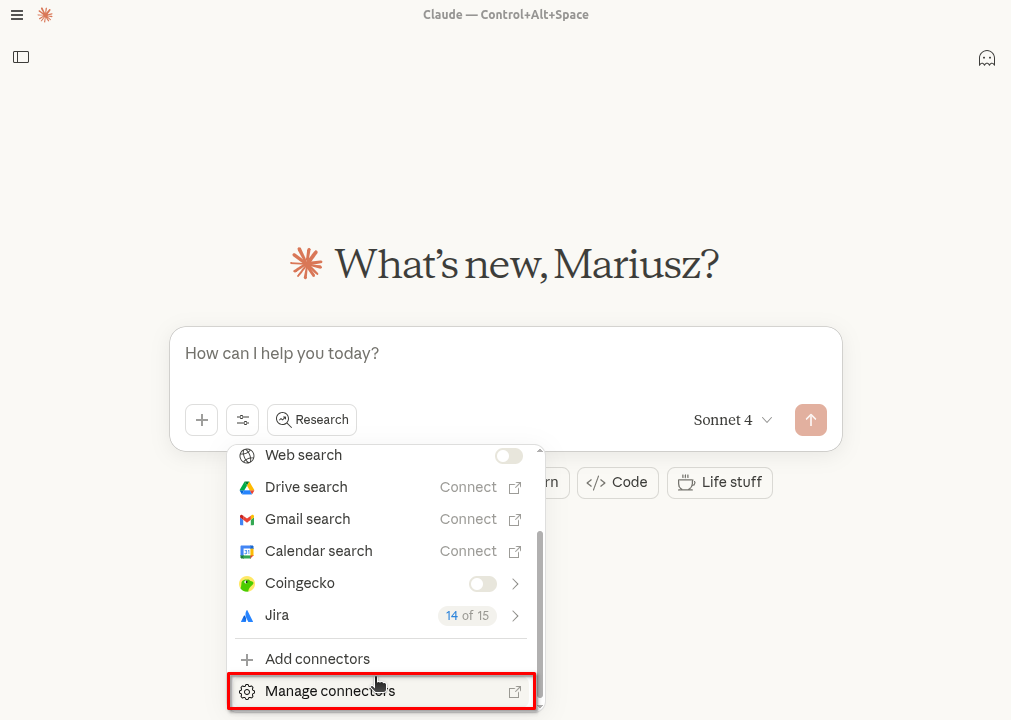

Claude Desktop zapewniło możliwość łatwego podłączania zewnętrznych usług i narzędzi za pomocą tzw. konektorów (ang. connectors). Aby dodać nowy konektor (czyli serwer MCP), należy pod ikonką + skorzystać z opcji Connectors > Manage connectors.

Aby otrzymać dostęp do pełnego katalogu predefiniowanych konektorów, na kolejnym ekranie należy wybrać przycisk Browse connectors.

W tym miejscu został umieszczony katalog najpopularniejszych usług z podziałem na te, które mogą działać lokalnie (zakładka Desktop extensions) lub łączyć się z usługami zdalnymi (zakładka Web).

Info: Na jednej z podstron producenta Claude można znaleźć listę z szerszymi opisami konektorów: https://claude.com/connectors

Klikając przycisk + znajdujący się na karcie wybranej usługi, możemy w prosty sposób połączyć wybrany konektor z LLM-em.

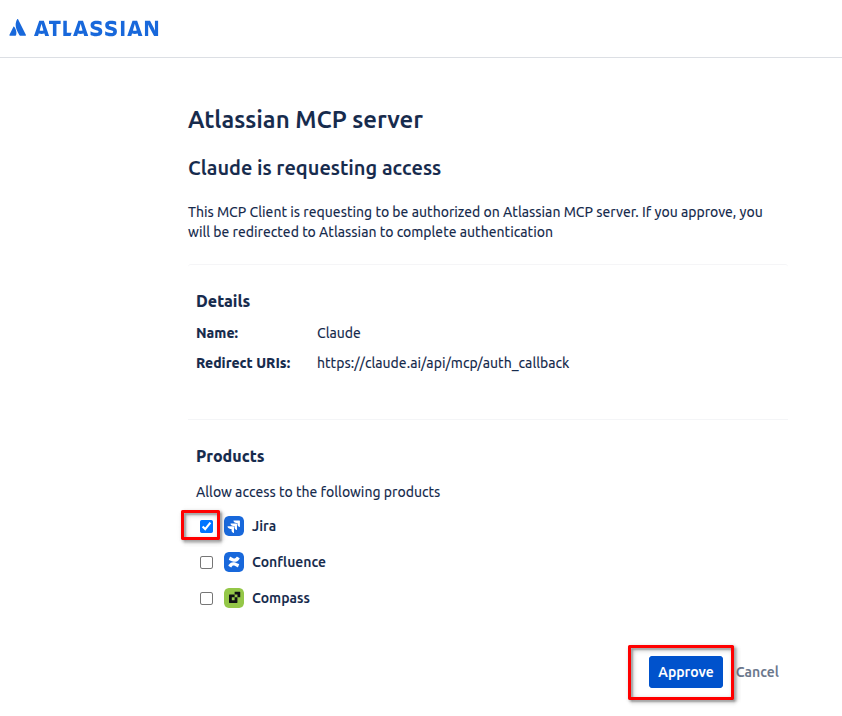

Przykładowo, jeżeli chcemy umożliwić CD dostęp do informacji z naszej projektowej Jirze, należy kliknąć + przy konektorze JIRA, a następnie przejść przez proces przydzielania niezbędnych uprawnień na oficjalnej stronie producenta tego oprogramowania (w tym wypadku firmy Atlassian).

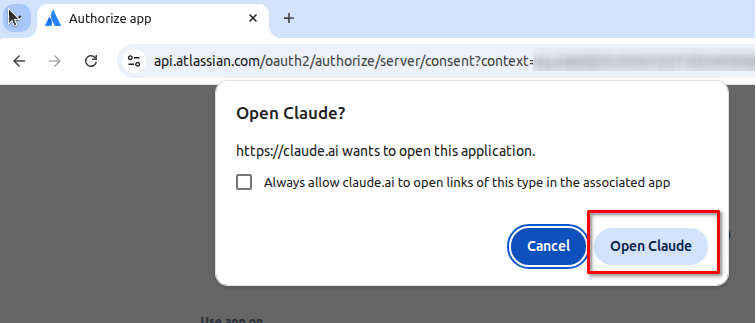

Po przydzieleniu uprawnień przeglądarka zapyta nas jeszcze o przekazanie informacji zwrotnej do aplikacji Claude Desktop.

Należy wyrazić na to zgodę. Od tej chwili lista podpiętych narzędzi zostanie wzbogacona o konektor Jiry:

Na szczególną uwagę zasługuje możliwość ograniczenia użycia pojedynczych funkcji z dodanego konektora. Zarządzanie tymi ustawieniami jest dostępne pod ikonką + > Connectors > Manage connectors.

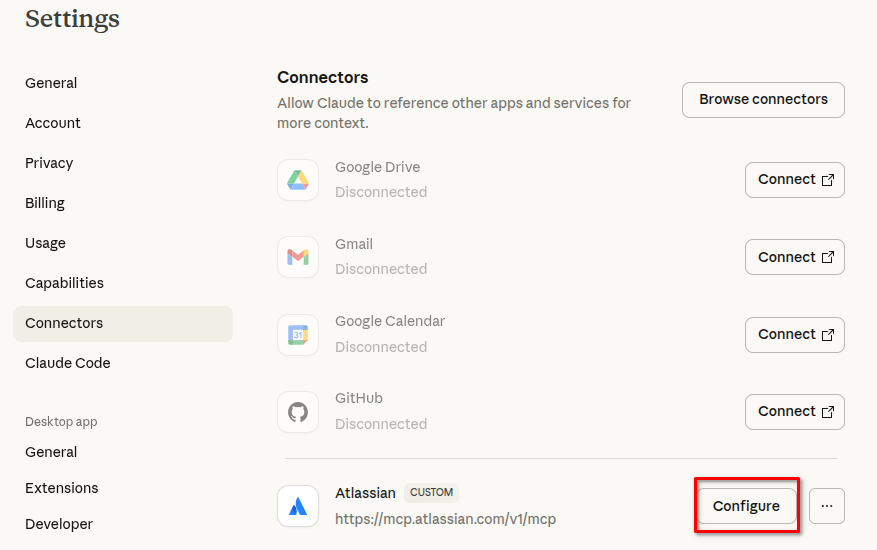

Na ekranie Connectors, klikając na przycisk Configure obok nazwy konektora Jiry, uzyskujemy możliwość zdecydowania, z jakich konkretnych funkcji serwera MCP nasz LLM może korzystać.

Zachęcam również do zapoznania się z oficjalnym filmem o prezentującym funkcjonalność konektorów Claude Desktop:

Integracja niestandardowego zdalnego serwera MCP

Lista możliwych do użycia serwerów MCP nie ogranicza tylko do tych predefiniowanych. LLM można również zintegrować z serwerami dostępnymi w innych lokalizacjach (włączając w to nasze własne serwery MCP).

Przykładowo, jeżeli chcemy poznać dokładną cenę Bitcoina, możemy poszukać dostawcy danych udostępniającego takie informacje w czasie rzeczywistym właśnie przez MCP.

Jednym z takich dostawców jest serwis Coingecko, który udostępnia serwer MCP.

Ostatecznie, aby podłączyć LLM-a do nowych danych, należy skonfigurować niestandardowy serwer MCP. Tym razem na ekranie + > Connectors > Manage connectors należy skorzystać z przycisku Add custom connector dostępnego na dole:

W dodatkowym oknie modalnym w polu Name wpisujemy dowolną nazwę konektora, np. Coingecko MCP, a w kolejnym polu Remote MCP server URL podajemy URL: https://mcp.api.coingecko.com/sse.

Wpływ narzędzi na odpowiedzi LLM-a

Po dodaniu nowych konektorów możemy przekonać się, jaki wpływ będą miały na odpowiedzi LLM-a.

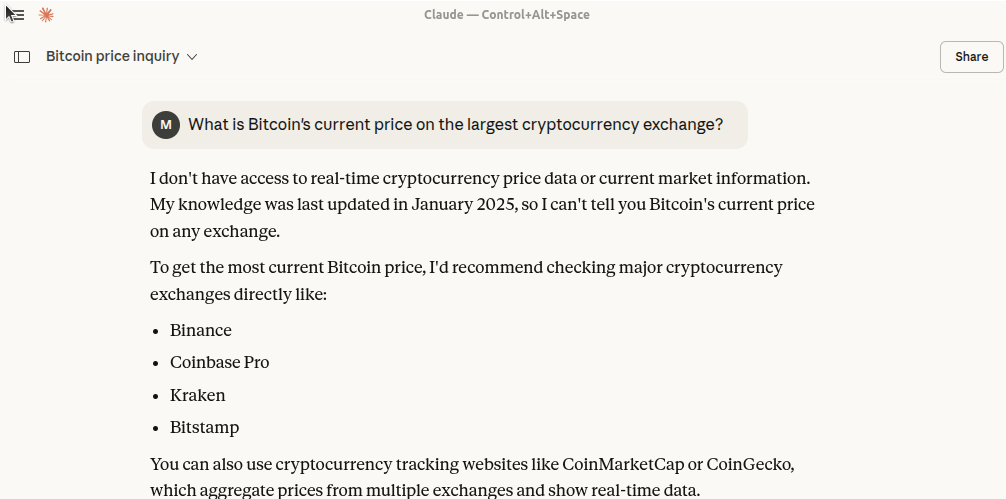

W pierwszej kolejności zademonstruję, co zwróci LLM w sytuacji, gdy ww. narzędzia będą wyłączone (ważne jest, aby opcja Web search – przeszukiwania internetu – była również wyłączona). Zapytajmy więc Claude, jaka jest bieżąca cena Bitcoina na największej giełdzie kryptowalutowej.

Jak zapewne zauważyliście, na powyższym zrzucie ekranu model nie mógł udzielić poprawnej odpowiedzi. Dzieje się tak dlatego, że baza treningowa LLM-a jest aktualizowana okresowo. W naszym przypadku jego ostatni trening miał miejsce w styczniu 2025.

Obecnie, aby umożliwić Claude dostęp do brakujących informacji, należy rozszerzyć jego możliwości poprzez włączenie narzędzia/konektora o nazwie Coingecko MCP. W tym miejscu należy upewnić się, czy w konektorze jest włączone narzędzie Get simple price, bez którego LLM nie będzie mógł udzielić poprawnej odpowiedzi.

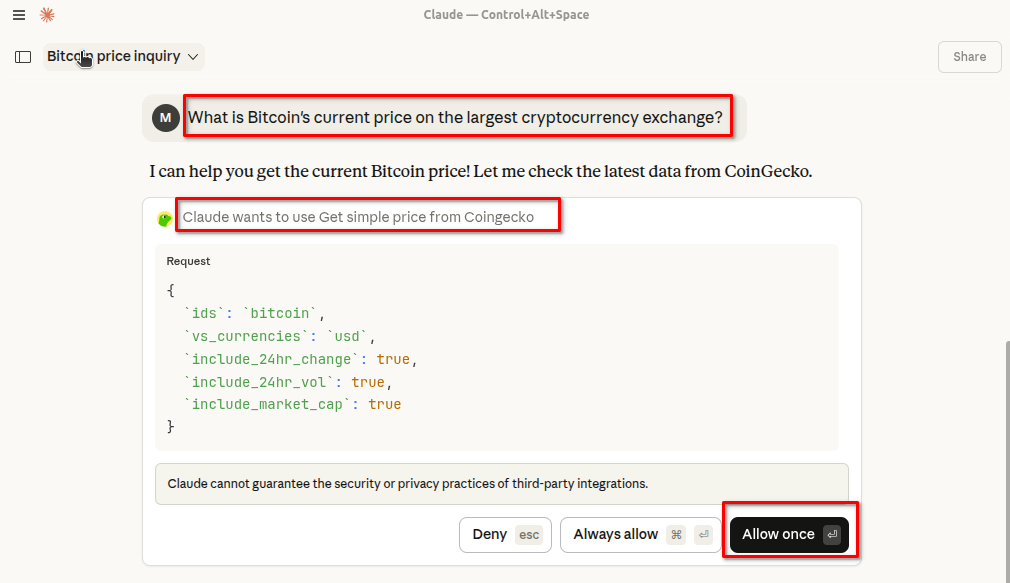

Ostatecznie, po ponownym zadaniu pytania, LLM autonomicznie zdecyduje o użyciu ww. narzędzia, z tą różnicą, że poprosi nas o potwierdzenie jego użycia.

MCP a bezpieczeństwo

Źródło serwerów MCP

Wraz z pojawieniem się rozszerzeń LLM-ów w postaci serwerów MCP, pojawiły się również nowe zagrożenia.

Pierwszym, fundamentalnym jest wykorzystanie serwerów MCP z niezaufanych/nieoficjalnych źródeł, które mogą być zainfekowane złośliwym oprogramowaniem.

Tu pojawia się ryzyko przechwycenia klucza autoryzacji do usługi i jego wrogiego użycia. W związku z tym rekomendowane jest korzystanie z oficjalnych serwerów (np. https://claude.com/connectors) lub z tych, co do których bezpieczeństwa nie mamy wątpliwości.

SSE vs Streamable HTTP

Zmiana rekomendowanego typu transportu danych z SSE do Streamable HTTP ma również swoje odzwierciedlenie w bezpieczeństwie. Komunikacja oparta na SSE, ze względu swój trwały charakter połączenia wymaga wprowadzenia mechanizmów wygasania i odnawiania tokenów uwierzytelniania. Długotrwałe połączenia SSE mogą posiadać tokeny uwierzytelniania niepodlegające wygaśnięciu, co stanowi jedną z niebezpiecznych praktyk. Dlatego obecnie rekomendowane są serwery używające transportu Streamable HTTP zamiast SSE.

Info: Jeżeli posiadamy adres URL do serwera MCP, jednakże w dokumentacji nie możemy zlokalizować typu transportu, możemy zweryfikować ww. typ, analizując nagłówki odpowiedzi serwera MCP.

W przypadku SSE będzie to: Content-Type: text/event-stream, a w przypadku Streamable HTTP: Content-Type: application/json, Content-Type: application/octet-stream lub rzadziej Content-Type: application/x-ndjson.

Uprawnienia na poziomie usługi

W miarę możliwości należy ograniczyć uprawnienia tylko do tych rzeczywiście używanych funkcji serwera MCP.

Część MCP – jak JIRA – ma możliwość zarządzania dostępem do pojedynczych funkcji w ramach klucza autoryzacji, dlatego warto z tego skorzystać.

Audyt nieużywanych kluczy autoryzacji w usługach

Może się zdarzyć, że zdecydujemy się na całkowite usunięcie konektora z Claude Desktop. Niestety to nie jest równoznaczne z usunięciem klucza autoryzacji w zdalnej usłudze. Oznacza to, że po usunięciu konektora w CD należy zalogować się również w usłudze (np. w JIRA) i w panelu zarządzania kluczami autoryzacji usunąć ten nieużywany klucz.

Podsumowanie

Użycie serwerów MCP w LLM-ach, rozwiązuje w zasadzie dwie najważniejsze kwestie:

- Zdejmuje podstawowe ograniczenie, jakim jest brak dostępu modelu do aktualnych danych (umożliwiają poszerzenie bazy wiedzy modelu bez zastosowania dodatkowego treningu) – dzieje się to jednak w nieco inny sposób niż w przypadku innych technik, jak np. RAG (technika RAG w jest ograniczona do doczytywania wiedzy, bez możliwości korzystania z narzędzi czy usług).

- Dzięki narzędziom dostarczanym przez MCP, model LLM zyskuje możliwość podjęcia faktycznego działania w realnym świecie, dokładnie w taki sposób, w jaki robią to klasyczne aplikacje.

Pojawienie się serwerów MCP wprowadziło rewolucję, dzięki której zbudowanie asystenta/aplikacji AI spełniającej nasze indywidualne wymagania nigdy nie było aż tak proste.

Zostaw komentarz