Czasy, gdy sztuczna inteligencja była wykorzystywana jedynie do autouzupełniania kodu, mamy już za sobą. W 2026 roku agenci AI, tacy jak GPT-5.4 od OpenAI czy Claude Opus 4.7 od Anthropic, pełnią rolę pełnoprawnych asystentów programistycznych. Potrafią samodzielnie analizować błędy, refaktoryzować całe systemy oraz dbać o bezpieczeństwo aplikacji.

Jak dobrać odpowiedni model do konkretnego zadania? Przyjrzymy się ich możliwościom, kosztom i ekosystemom, aby ułatwić Ci podjęcie tej decyzji.

Najpopularniejsze modele AI dla programistów w 2026 roku

Dzisiejszy ekosystem narzędzi programistycznych jest zdominowany przez dwa modele, które najlepiej ilustrują zmianę w sposobie wytwarzania oprogramowania:

- GPT-5.4,

- Claude Opus 4.7.

Na pierwszy rzut oka ich możliwości wydają się zbliżone. Oba modele potrafią sprawnie generować kod, analizować złożone problemy, przeprowadzać refaktoryzację i wspierać debugowanie.

GPT-5.4 to najnowsza propozycja od OpenAI. Model ten łączy sprawdzone zdolności Codexa z zaawansowanym rozumowaniem, natywną obsługą komputera (computer use) oraz ogromnym oknem kontekstowym (źródło). Stanowi on ewolucję wcześniejszego GPT-5.3 Codex, który wciąż świetnie sprawdza się jako tańsza alternatywa do zadań czysto terminalowych.

Claude Opus 4.7 został zaprezentowany przez Anthropic jako najzdolniejszy publicznie dostępny model do zaawansowanego programowania i analitycznego rozumowania (źródło).

Gdzie zatem leży prawdziwa różnica? Tkwi ona w skuteczności przy konkretnych typach zadań, w ekosystemie narzędziowym oraz w stosunku jakości do kosztów.

Obecnie oba modele są powszechnie dostępne przez API oraz zintegrowane z najpopularniejszymi narzędziami, takimi jak Cursor, Windsurf czy GitHub Copilot. Od lutego 2026 roku zarówno rozwiązania OpenAI, jak i Anthropic działają jako agenci w GitHub Copilot (źródło).

Podział na rynku nie polega więc na tym, gdzie dany model jest dostępny, ale na tym, w jakim ekosystemie narzędzi działa najefektywniej:

- OpenAI oferuje głęboką integrację z GitHub Copilot (zarówno w IDE, jak i przy PR review), posiada własne Codex IDE, rozszerzenia do popularnych edytorów (VS Code, Cursor, Windsurf) oraz gotowe biblioteki do CI/CD. To ekosystem mocno osadzony w codziennym pipeline’ie developerskim.

- Anthropic proponuje Claude Code (agenta CLI do pracy w terminalu), a jej modele są często wybieraną opcją przez użytkowników Cursora. Ich podejście jest zdecydowanie bardziej agent-centric i API-first.

Wybór modelu sprowadza się więc często do decyzji, w którym ekosystemie chcesz pracować.

Jak zmieniły się opisywane modele?

| Wcześniej | Obecnie | |

| OpenAI (5.3 Codex → 5.4) | Generował kod na podstawie prompta, działał na pojedynczych plikach. | GPT-5.4 łączy kodowanie z natywnym computer use, rozumowaniem i ogromnym kontekstem (1,05M tokenów). |

| Opus (4.6 → 4.7) | Dobrze generował odpowiedzi, ale miewał ograniczenia w przypadku bardziej złożonych analiz. | Prowadzi wieloetapowe rozumowanie, utrzymuje kontekst dużych systemów, generuje i refaktoryzuje kod na wysokim poziomie. Wersja 4.7 przyniosła skok na SWE-bench Pro z 53,4% do 64,3%. |

Krótko mówiąc: oba modele awansowały z roli zwykłych „generatorów snippetów” do poziomu pełnoprawnych agentów programistycznych. Obecnie różnią się tym, w jaki sposób podchodzą do rozwiązania problemu, a nie tym, czy w ogóle potrafią go rozwiązać.

Czym różni się Opus 4.6 od 4.7?

Wydany w połowie kwietnia Opus 4.7 wprowadza szereg zmian, które w praktyce przekładają się na lepsze wyniki w wybranych scenariuszach:

| Obszar | Opus 4.6 | Opus 4.7 | Zmiana |

| SWE-bench Pro (coding) | 53,4% | 64,3% | +20% |

| CursorBench | 58% | 70% | +12pp |

| OfficeQA Pro (dokument reasoning) | baseline | −21% błędów | znacząca poprawa |

| Vision (maks. rozdzielczość) | 1,15 MP | 3,75 MP | 3x więcej |

Wśród najważniejszych nowości w wersji 4.7 warto wymienić:

- xhigh effort level – nowy parametr stworzony specjalnie do zadań wymagających najgłębszego rozumowania.

- Task budgets (beta) – funkcja pozwalająca modelowi zarządzać budżetem tokenów w pętlach agentowych.

- Nowy tokenizer – tu mała uwaga: zwiększa on zużycie tokenów o około 35%, co realnie podnosi koszty operacyjne, przy zachowaniu dotychczasowego cennika ($5/M input, $25/M output).

Ważne zastrzeżenie praktyczne: Opus 4.7 znacznie ściślej trzyma się instrukcji (stricter instruction following). Oznacza to, że prompty, które świetnie działały w wersji 4.6, mogą wymagać drobnych korekt. Warto przetestować je przed pełną migracją.

Jak powstał GPT-5.4?

Warto wyjaśnić jedną rzecz: GPT-5.4 nie jest po prostu nową wersją modelu Codex. To kompleksowy, uniwersalny model, który wchłonął wszystkie umiejętności programowania swoich poprzedników, a następnie rozbudował je o natywną obsługę komputera (ang. computer use), zaawansowany research i potężny kontekst.

Aby lepiej to zrozumieć, spójrzmy na ewolucję narzędzi OpenAI:

- GPT-5.2-Codex (koniec 2025) – pierwszy samodzielny agent w ofercie firmy.

- GPT-5.3-Codex (luty 2026) – aktualizacja: model o 25% szybszy, świetnie radzący sobie w terminalu (77,3% w Terminal-Bench) i pierwszy z najwyższą oceną w obszarze cyberbezpieczeństwa (źródło).

- GPT-5.4 (marzec 2026) – OpenAI połączyło precyzję programowania Codexa z ogólnym rozumowaniem i oknem kontekstowym mieszczącym aż 1,05M tokenów (źródło).

Co ważne, starszy GPT-5.3 Codex nie zniknął z rynku. Wciąż pozostaje w ofercie jako najbardziej przystępne cenowo rozwiązanie do zadań czysto terminalowych i pracy w CLI. Jeśli Twój codzienny workflow opiera się głównie na konsoli, skryptach i automatyzacji, Codex 5.3 nadal będzie strzałem w dziesiątkę.

Charakterystyka pracy: GPT-5.4 i Claude Opus 4.7

Choć oba modele bez problemu poradzą sobie z większością codziennych zadań programistycznych, różni je podejście do pracy. A to właśnie decyduje o ich skuteczności w konkretnych scenariuszach.

| Obszar | GPT-5.4 | Opus 4.7 |

| Domyślny styl | Szybko przechodzi do implementacji | Najpierw analizuje, potem działa |

| Siła | Szybkość, computer use, szerokie zdolności | Głębokość rozumowania, utrzymanie kontekstu |

| SWE-bench Pro | 57,7% (wg OpenAI) | 64,3% (wg Anthropic) |

| Kontekst | 1,05M tokenów | 1M tokenów |

| Computer use | Natywny (OSWorld 75%) | Obsługiwany (Computer Use API, wizja 3,75 MP) |

| Ekosystem (najgłębsza integracja) | GitHub Copilot (PR review, Copilot w IDE), Codex IDE, rozszerzenia do CI/CD | Cursor, Claude Code (CLI), API-first |

| Security | Codex Security – proaktywne skanowanie podatności w pipeline | Świadomie zawężone zdolności w obszarze cyberbezpieczeństwa (wg Anthropic, względem Mythos) |

| Podejście do ryzyka | Szerokie zdolności + warstwy kontroli | Ograniczenie zdolności u źródła |

Ostatni wiersz tabeli doskonale obrazuje podstawową różnicę w filozofii obu dostawców.

OpenAI udostępnia model o niezwykle szerokich zdolnościach, ale nakłada na niego zewnętrzne warstwy kontroli (takie jak Codex Security czy Trusted Access for Cyber). Anthropic wybiera inną drogę: część potencjalnie niebezpiecznych zdolności jest zawężana jeszcze przed publicznym udostępnieniem modelu (według deklaracji firmy, zdolności Opusa 4.7 w obszarze cyberbezpieczeństwa zostały świadomie ograniczone w porównaniu z potężnym modelem Mythos). Oba podejścia mają sens i wpływają na to, jak ostatecznie zaprojektujesz swój workflow.

Najprościej ujmując, różnica w stylu ich pracy wygląda tak:

- GPT-5.4: Otrzymuje zadanie → natychmiast generuje rozwiązanie → iteruje, jeśli testy nie przechodzą.

- Opus: Otrzymuje zadanie → analizuje kontekst → planuje podejście → implementuje kod wraz z uzasadnieniem.

Żaden z tych stylów nie jest obiektywnie lepszy. Wszystko zależy od tego, z jakim problemem się mierzysz.

Skąd biorą się te różnice?

Odmienny styl pracy nie jest dziełem przypadku – wynika z decyzji projektowych na poziomie architektury samych modeli:

- Planowanie jawne vs. niejawne. Opus ma w zwyczaju jawnie rozkładać problem na mniejsze kroki, zanim wygeneruje pierwszą linijkę kodu. GPT-5.4 planuje bardziej „w locie” – zaczyna pisać i koryguje kurs na bieżąco. W efekcie Opus rzadziej wpada w ślepe zaułki przy skomplikowanych zadaniach, ale za to bywa wolniejszy przy tych najprostszych. To klasyczny dylemat znany z systemów rozproszonych: podejście execution-first (optymistyczne) kontra plan-first (deliberatywne).

- Zarządzanie kontekstem. Oba modele dysponują potężnym kontekstem (około 1M tokenów) i generują do 128k tokenów wyjściowych. Różnica polega na tym, jak go wykorzystują. Opus doskonale radzi sobie z utrzymaniem spójności podczas długich, wieloetapowych interakcji. GPT-5.4 jest z kolei bezkonkurencyjny, gdy zadanie wymaga szerokiego wachlarza zdolności (np. jednoczesnego kodowania, korzystania z przeglądarki i researchu) w ramach jednej sesji.

- Strategia wobec niepewności. Gdy brakuje danych, GPT-5.4 ma tendencję do generowania najbardziej prawdopodobnego rozwiązania. Opus częściej się zatrzyma i wprost zapyta o brakujące informacje. W zależności od sytuacji każda z tych cech może być ogromną zaletą lub irytującą wadą.

Te różnice przekładają się na twarde dane. Wynik Opusa 4.7 na SWE-bench Pro (64,3% wg Anthropic vs 57,7% dla GPT-5.4) potwierdza, że głębsze planowanie realnie przekłada się na jakość kodu w złożonych projektach.

Praktyczne zastosowania modeli w projektach IT

Zejdźmy z poziomu abstrakcji i spójrzmy na konkretne scenariusze, w których wybór modelu robi realną różnicę.

Kiedy najlepiej sprawdzi się GPT-5.4?

- Masowa refaktoryzacja: Zmiana wzorca w 200 plikach czy migracja dużego API. GPT-5.4 oferuje znacznie wyższy throughput i niższą cenę za token, co ma kluczowe znaczenie przy powtarzalnych zmianach na dużą skalę.

- Generowanie boilerplate’u: Pisanie powtarzalnych testów, operacji CRUD czy plików konfiguracyjnych. Tu liczy się szybkość.

- Zadania wymagające intensywnego computer use: Interakcja z interfejsem użytkownika, testowanie aplikacji webowych czy praca z narzędziami desktopowymi. GPT-5.4 posiada natywny computer use zintegrowany bezpośrednio w modelu (OSWorld 75%, źródło). Opus obsługuje to przez API, ale z nieco mniejszą dojrzałością.

- Ścisła integracja z GitHubem: Automatyczne PR review, sugestie w Copilot, wsparcie CI/CD. Modele OpenAI są domyślnie dostępne w GitHub Copilot dla użytkowników biznesowych (źródło).

- Skanowanie bezpieczeństwa: Wprowadzony w marcu 2026 Codex Security to nie tylko funkcja, ale osobna warstwa w pipeline. Analizuje kod przed merge’em, działając jak inteligentny SAST/DAST. Rozumie kontekst zmian i redukuje fałszywe alarmy o około 50% (źródło).

Kiedy warto sięgnąć po Claude Opus 4.7?

- Debugowanie złożonych problemów: Race conditions, wycieki pamięci, błędy pojawiające się losowo (ang. intermittent failures). Opus stawia na głębszą analizę i świetnie utrzymuje kontekst, co znajduje odzwierciedlenie w wynikach SWE-bench Pro.

- Decyzje architektoniczne: Ocena trade-offów, wybór odpowiedniego wzorca projektowego czy analiza wpływu pojedynczej zmiany na cały system. Tutaj głębsze rozumowanie zdecydowanie popłaca.

- Praca z dużym, powiązanym kontekstem: Analiza wielu zależnych od siebie plików i zrozumienie przepływu danych przez wiele warstw aplikacji.

- Analiza wizualna: Opus 4.7 potrafi analizować obrazy o rozdzielczości do 3,75 MP. To nieoceniona pomoc przy debugowaniu UI, analizie skomplikowanych diagramów architektonicznych czy zrzutów ekranu z błędami.

Kiedy więcej nie znaczy lepiej

Warto pamiętać, że głębsze rozumowanie nie zawsze oznacza lepszy wynik dla użytkownika. Przy bardzo prostych zadaniach Opus potrafi być wolniejszy i droższy – nie dlatego, że sobie nie radzi, ale dlatego, że analizuje więcej niż to konieczne. Zamiast po prostu napisać prosty endpoint, zaczyna rozważać edge case’y, o które nikt nie prosił. Dodatkowo nowy tokenizer w wersji 4.7 zwiększa koszt takich operacji o ~35%.

Z drugiej strony, przy niektórych uciążliwych bugach, iteracyjne podejście GPT-5.4 bywa zaskakująco skuteczne. Model błyskawicznie generuje kilka wariantów poprawek, które możesz szybko zweryfikować za pomocą testów.

Oba modele radzą sobie świetnie, gdy chodzi o:

- codzienne kodowanie (nowe funkcje, proste poprawki).

- code review (oba sprawnie wyłapują problemy).

- wyjaśnianie i dokumentowanie istniejącego kodu.

Nowy workflow programisty

Jak praca z tymi modelami wygląda w praktyce? Wyobraźmy sobie klasyczny problem: nagłe timeouty na endpoincie /api/orders.

Kiedyś (bez AI):

- Developer analizuje logi.

- Szuka przyczyny w kodzie.

- Implementuje poprawkę.

- Pisze testy i wdraża zmianę.

Dziś (z AI) – wykorzystując mocne strony każdego modelu:

- Specify: Zapisujesz krótką specyfikację problemu (cel, kryteria akceptacji, ograniczenia) – w SPEC.md, issue w Jirze lub w opisie zadania.

- Podajesz Opusowi logi z ostatnich 24 h razem ze specyfikacją → Opus identyfikuje, że problem pojawia się tylko przy zamówieniach powyżej 50 pozycji. Wskazuje na brak paginacji i problem z N+1 query.

- Przekazujesz tę analizę do GPT-5.4 → model refaktoryzuje repozytorium, dodaje paginację, eliminuje N+1 i generuje test integracyjny.

- Codex Security skanuje poprawkę pod kątem podatności (np. IDOR – Insecure Direct Object Reference, SQL injection) → potwierdza bezpieczeństwo tej zmiany.

- Ty robisz finalne review → sprawdzasz, czy rozwiązanie nie łamie kontraktu API, uruchamiasz testy i wdrażasz.

Co faktycznie zmieniło się w kodzie

Na podstawie analizy Opusa, GPT-5.4 wygenerował poprawkę. Sam diff jest krótki, ale wymagał zrozumienia JPA, zachowania kontraktu API i dopisania testu regresyjnego, czyli dokładnie tego, czego oczekujemy od asystenta AI.

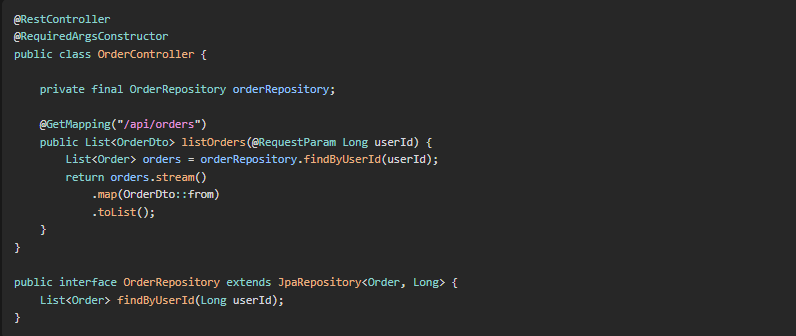

Przed:

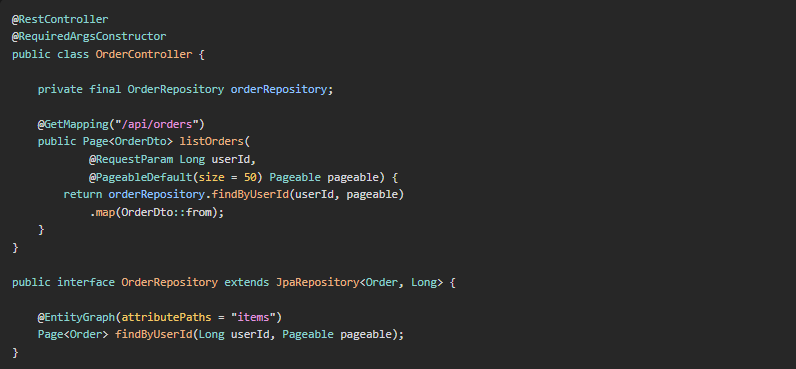

Po:

Wprowadzono dwie kluczowe zmiany: Adnotacja @EntityGraph eliminuje problem N+1 (jedno zapytanie z JOIN FETCH), a obiekt Pageable wprowadza paginację, ograniczając payload.

Warto pamiętać, że w realnym projekcie dochodzi jeszcze do rollbacku planu, monitoringu po wdrożeniu i komunikacji z zespołem – AI nie zastępuje tych warstw, a jedynie skraca drogę między diagnozą a kodem poprawki.

Prompty użyte w tym scenariuszu

Oto, co faktycznie wpisujesz do modelu na poszczególnych etapach pracy z AI.

Krok 1 – Specify (specyfikacja wymagań)

Zanim w ogóle zaangażujesz model, spisujesz wymagania, kryteria akceptacji i ograniczenia jako osobny artefakt – plik SPEC.md w repozytorium, issue w Jirze albo krótki blok w opisie zadania. To kontrakt między Tobą a AI.

- Cel: Endpoint /api/orders ma odpowiadać w czasie < 200 ms dla zamówień z ≤ 100 pozycjami.

- Wymagania: Zachowanie kompatybilności wstecznej kontraktu API, dopisanie testu integracyjnego dla paginacji > 50 pozycji.

- Ograniczenia: Nie zmieniamy schematu bazy w tej iteracji, nie wprowadzamy cache.

To rdzeń podejścia spec-driven development. Specyfikację dostarczasz modelowi w Kroku 2 razem z logami – plan powstaje wtedy nie na bazie: „Co model sądzi, że chcesz”, tylko: „Co explicite zapisałeś”. Dzięki temu model znacznie rzadziej halucynuje intencję.

Krok 2 – Opus 4.7 w trybie Ask/Plan (analiza)

Załączam spec (SPEC.md), logi z ostatnich 24h z endpointu /api/orders oraz stack trace z Sentry. Zidentyfikuj root cause timeoutów i zaproponuj strategię naprawy zgodną ze specyfikacją.

Kluczowe jest uruchomienie tego kroku w trybie read-only (np. tryb Ask w Cursorze lub Plan w Claude Code). Wymusza to na modelu skupienie się wyłącznie na diagnozie i zaplanowaniu rozwiązania, zapobiegając przedwczesnej modyfikacji plików. Tekstowa prośba „nie pisz jeszcze kodu” bywa przez modele ignorowana – tryb narzędzia gwarantuje to technicznie.

Krok 3 – GPT-5.4 w trybie Agent (implementacja)

Zaimplementuj poprawkę wg tej strategii: [wklej output Opusa]. Dodaj paginację (limit 50), wyeliminuj N+1 przez eager loading, dopisz integration test na zamówienie ze 100 pozycjami.

Na tym etapie przechodzimy do trybu Agent (lub odpowiednika, np. accept edits w Claude Code). Tutaj liczy się szybkość i egzekucja – GPT-5.4 bierze gotową strategię i błyskawicznie zamienia ją w gotowy kod oraz testy.

Krok 4 – Codex Security (weryfikacja)

Przeskanuj diff pod kątem IDOR, SQL injection i uprawnień. Zwróć szczególną uwagę na nowe parametry ?page= i ?size=.

Wskazanie konkretnych wektorów ataku zawęża zakres skanowania i zmniejsza liczbę fałszywych alarmów (ang. false positives). Zamiast generycznego: „Sprawdź bezpieczeństwo”, otrzymujemy ukierunkowaną analizę.

Zapowiedź: pełne case study – z logami, outputami modeli i pomiarami kosztów – opiszemy w kolejnym artykule z serii.

Czy do obu kroków można by użyć wyłącznie Opusa? Tak. Czy GPT-5.4 poradziłby sobie z samodzielną analizą? Prawdopodobnie również. Jednak to właśnie dopasowanie modelu do specyfiki zadania pozwala osiągnąć optymalny stosunek jakości do czasu i kosztów.

Programista przestaje być wyłącznie odpowiedzialny za implementację – staje się orkiestratorem pracy AI:

- Dobiera odpowiedni model do zadania.

- Kontroluje przepływ informacji między różnymi agentami.

- Zarządza ryzykiem (bezpieczeństwo, regresje, halucynacje).

Decyduje, kiedy AI może działać autonomicznie, a kiedy wymaga nadzoru.

Wdrażanie AI w zespole

Patrząc z perspektywy architekta systemów, warto traktować modele AI jak mikroserwisy o różnych charakterystykach:

- Opus 4.7 – niższy throughput, wyższy koszt, zoptymalizowany pod złożone rozumowanie.

- Claude Sonnet – tańsze rodzeństwo Opusa w ekosystemie Anthropic, dobre do egzekucji i codziennego kodowania.

- GPT-5.4 – wyższy throughput, niższy koszt, natywny computer use, szerokie spektrum zdolności.

- GPT-5.3 Codex – najbardziej przystępny cenowo, wyspecjalizowany w pracy w terminalu/CLI.

- Codex Security – wyspecjalizowany agent do skanowania bezpieczeństwa.

To sytuacja analogiczna do wyboru między synchronicznym wywołaniem API a przetwarzaniem wsadowym (batch). Oba podejścia działają, ale ich optymalne użycie zależy od kontekstu.

Dobór modelu do kroku

Opus 4.7 jest wart swojej ceny tam, gdzie płacisz za bardziej rozległe rozumowanie. Tam, gdzie potrzebujesz już tylko egzekucji, warto rozważyć tańsze rodzeństwo w ramach tego samego ekosystemu albo model konkurencyjny:

| Krok workflow | Rekomendacja | Dlaczego |

| Specify | dowolny model (albo bez AI) | specyfikację piszesz Ty, nie model |

| Plan / Analyze | Opus 4.7 | głębsze rozumowanie realnie przekłada się na jakość planu |

| Implement | Claude Sonnet lub GPT-5.4 | tańsze, wystarczająco mocne do wykonania gotowego planu |

| Verify / Security | Codex Security lub wyspecjalizowany agent | wąski zakres zadania, nie potrzebuje flagshipa |

Dlaczego Sonnet zamiast Opusa przy implementacji?

- Po pierwsze, cennik. W obrębie tej samej generacji Sonnet jest zwykle kilkukrotnie tańszy od Opusa.

- Po drugie, zużycie tokenów. Opus 4.7 ma nowy tokenizer, który (jak wspomnieliśmy wcześniej) zwiększa liczbę tokenów o ~35%, a jego głębsze łańcuchy rozumowania naturalnie prowadzą do dłuższych odpowiedzi.

Efekt: pojedyncza iteracja implementacyjna na Opusie potrafi kosztować kilka razy więcej niż ta sama iteracja na Sonnecie – przy marginalnej różnicy jakościowej na etapie egzekucji gotowego planu.

W dojrzałym środowisku pracy AI pełni trzy główne role:

- Warstwa decyzyjna – analiza, planowanie, ocena ryzyka (tutaj doskonale sprawdza się Opus).

- Warstwa wykonawcza – implementacja, refaktoryzacja, generowanie testów (tutaj GPT-5.4 oferuje wyższą wydajność i niższe koszty).

- Warstwa bezpieczeństwa – skanowanie podatności, weryfikacja wprowadzanych zmian (Codex Security).

Zadaniem architekta jest zarządzanie przepływem między tymi warstwami. W praktyce oznacza to konieczność zaprojektowania warstwy orkiestracji. Warto zadać sobie kilka kluczowych pytań:

- Routing: Jak automatycznie kierować zapytania do odpowiedniego modelu? Czy kryterium powinien być typ zadania, jego złożoność czy może koszt?

- Fallback: Co w sytuacji, gdy model „pierwszego wyboru” zwróci niesatysfakcjonujący wynik? Czy istnieje mechanizm płynnego przełączenia na alternatywę?

- Logowanie decyzji: Czy zapisujesz, który model zaproponował dane rozwiązanie? To kluczowe dla późniejszych audytów i nauki zespołu.

- Metryki jakości: Jak mierzysz skuteczność danego modelu w Twoim konkretnym kontekście? Mierzysz czas, koszty czy procent zaakceptowanych zmian?

Nawet samo zadanie sobie tych pytań diametralnie zmienia sposób, w jaki myślimy o budowaniu procesów z wykorzystaniem AI. Architekt projektuje już nie tylko sam system informatyczny, ale również system współpracy między modelami AI.

Claude Mythos – przyszłość cyberbezpieczeństwa w AI

Mówiąc o modelach AI w 2026 roku, nie sposób zignorować słonia w pokoju: Claude Mythos Preview.

Anthropic ogłosiło 7 kwietnia model, który nie jest po prostu „kolejną, mocniejszą wersją”. Reprezentuje on zupełnie nową klasę systemów zdolnych do prowadzenia długich, nieprzerwanych łańcuchów wnioskowania bez jakiejkolwiek interwencji użytkownika.

Według benchmarków publikowanych przez twórców, wyniki są imponujące:

- SWE-bench Verified: 93,9% (wobec 80,8% dla Opusa 4.6).

- USAMO 2026 (zaawansowana matematyka): 97,6% (wobec 42,3% dla Opusa 4.6).

- Cybersecurity CTF: 83,1% (wobec 66,6% dla Opusa 4.6).

Zgodnie z informacjami udostępnionymi w ramach Project Glasswing, Mythos wykazał zdolność do autonomicznego identyfikowania wcześniej nieznanych podatności (zero-day) w niezwykle złożonych systemach – w tym 27-letniego błędu w OpenBSD. Należy jednak pamiętać, że są to wyniki z kontrolowanych środowisk testowych i nie zostały jeszcze publicznie zweryfikowane przez niezależne podmioty.

Najważniejsze jest jednak to, że Mythos nie jest publicznie dostępny. Anthropic, jako pierwszy gracz na rynku od czasu premiery GPT-2 w 2019 roku, zdecydował się drastycznie ograniczyć dostęp do modelu ze względów bezpieczeństwa. Trafił on jedynie do około 50 wybranych organizacji (m.in. Microsoft, AWS, Apple, Google, Nvidia, Cisco) w ramach programu Project Glasswing.

Co to oznacza dla użytkowników Opusa 4.7? Zgodnie z komunikatami Anthropic, zdolności Opusa 4.7 w obszarze cyberbezpieczeństwa zostały świadomie zawężone w porównaniu z modelem Mythos. To jasna deklaracja projektowa: publicznie dostępny model ma być potężny, ale przede wszystkim bezpieczny.

Mythos wyznacza nowy kierunek dla całej branży: modele stają się tak zaawansowane, że konieczne staje się celowe ograniczanie ich możliwości. To fundamentalnie zmienia perspektywę architekta – nie pytamy już tylko „który model jest najlepszy do mojego zadania”, ale „do jakich modeli w ogóle mam dostęp i na jakich warunkach” (źródło)

O czym warto pamiętać?

Powszechnie znane ostrzeżenie, że „AI czasami popełnia błędy”, w 2026 roku już nikogo nie zaskakuje. Zwróćmy uwagę na bardziej konkretne pułapki:

- Szybkość GPT-5.4 wymaga rygorystycznej kontroli jakości. Model potrafi błyskawicznie zmodyfikować dziesiątki plików. Dlatego absolutnie niezbędnym elementem workflow są zautomatyzowane testy, które na bieżąco weryfikują poprawność wprowadzanych zmian.

- Opus potrafi wygenerować niezwykle przekonującą, ale błędną analizę. Zawsze weryfikuj jego założenia, zwłaszcza gdy bazuje na niekompletnych logach lub przestarzałej dokumentacji.

- Migracja między wersjami modeli nie jest trywialna. Prompty, które działały idealnie z Opusem 4.6, mogą przestać działać w wersji 4.7. Dodatkowo nowy tokenizer zmienia strukturę kosztów. Zawsze testuj zachowanie modelu przed przełączeniem go na środowisko produkcyjne.

- Wybór modelu to decyzja czysto inżynierska, a nie ideologiczna. Nie ma sensu spierać się o to, który model jest ogólnie „lepszy”. Kluczem jest to, który z nich lepiej pasuje do zadania, które masz aktualnie przed sobą.

- Nie każdy problem wymaga zaprzęgania AI. Czasami prosty bugfix napiszesz szybciej sam niż zajmie Ci sformułowanie precyzyjnego promptu.

Podsumowanie

Choć zakres możliwości obu modeli jest bardzo zbliżony, różnią się one skutecznością w zależności od specyfiki zadania:

- GPT-5.4 to model zoptymalizowany pod kątem szybkości i kosztów. Oferuje natywny computer use i potężny kontekst 1,05M tokenów. Jest dostępny bezpośrednio w GitHub Copilot i całym ekosystemie OpenAI Codex. Sprawdza się doskonale, gdy dokładnie wiesz, co chcesz zrobić i potrzebujesz po prostu sprawnej egzekucji.

- Claude Opus 4.7 jest nastawiony na głębokie rozumowanie (osiągając 64,3% w SWE-bench Pro wg Anthropic) i świetnie radzi sobie z utrzymaniem złożonego kontekstu. Cieszy się ogromną popularnością wśród użytkowników Cursora i narzędzi API-first. To optymalny wybór, gdy musisz najpierw zrozumieć skomplikowany problem i zaplanować architekturę rozwiązania.

- GPT-5.3 Codex pozostaje najbardziej przystępną cenowo opcją, wyspecjalizowaną w pracy w terminalu i CLI. Stanowi bardzo uzasadniony wybór do automatyzacji i tworzenia skryptów.

A gdzieś w tle majaczy Claude Mythos Preview, przypominając nam, że modele, z których korzystamy na co dzień, to świadomie ograniczone wersje tego, co jest już technicznie możliwe.

Kluczem do efektywności w 2026 roku nie jest poszukiwanie jednego, uniwersalnego modelu, lecz świadomy i elastyczny dobór narzędzia do konkretnego problemu.

Chcesz wdrożyć agentów AI w swoim zespole?

Zastanawiasz się, jak zoptymalizować procesy wytwórcze w Twojej organizacji, wykorzystując najnowsze modele AI? Skontaktuj się z ekspertami Sii Polska. Pomożemy Ci dobrać odpowiednie narzędzia, zaprojektować bezpieczną architekturę i przeszkolić zespół tak, aby maksymalnie wykorzystać potencjał GPT-5.4, Claude Opus i innych rozwiązań klasy enterprise.

Porozmawiajmy o AI w Twoim projekcie

***

O danych i benchmarkach

W artykule wykorzystano oficjalne materiały producentów modeli (OpenAI, Anthropic), własne i partnerskie benchmarki (np. SWE-bench, CursorBench) oraz dane z programów testowych (np. Project Glasswing). Część wyników pochodzi z kontrolowanych środowisk testowych i może różnić się od rezultatów w systemach produkcyjnych.

Zostaw komentarz