Sztuczna inteligencja rozwija się w zawrotnym tempie, jednak podstawowa jednostka sieci neuronowych – sztuczny neuron – pozostała w dużej mierze niezmieniona. Nowo wprowadzona sieć Kolmogorova-Arnolda (KAN) kwestionuje ten stan rzeczy, redefiniując sposób wykorzystania i uczenia się funkcji aktywacji. Dzięki swojej innowacyjnej strukturze, KAN oferuje lepszą wydajność, interpretowalność i skuteczność, potencjalnie zmieniając kierunek rozwoju głębokiego uczenia.

Podstawy działania klasycznego neuronu

Rola sztucznej inteligencji szybko rozszerza się w naszym codziennym życiu, wpływając na wszystko – od asystentów głosowych i systemów rekomendacyjnych, po zaawansowane dziedziny takie jak diagnostyka medyczna, pojazdy autonomiczne czy przetwarzanie języka naturalnego. Opracowano liczne architektury i typy warstw, takie jak warstwy konwolucyjne czy warstwy „embeddingowe”. Jednak pomimo tych przełomowych osiągnięć, fundamentalna jednostka napędzająca te sieci – sztuczny neuron – pozostała w swojej pierwotnej formie od czasu powstania.

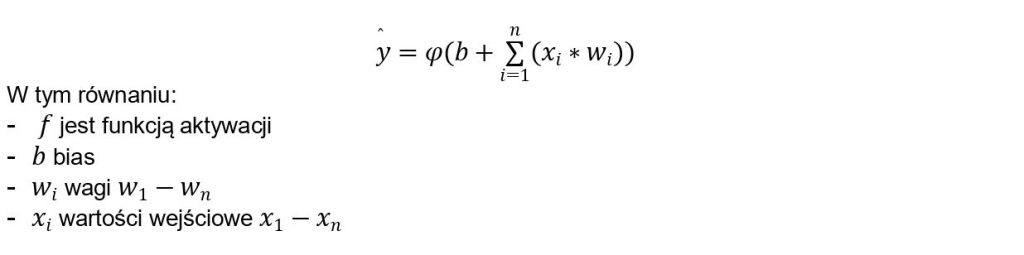

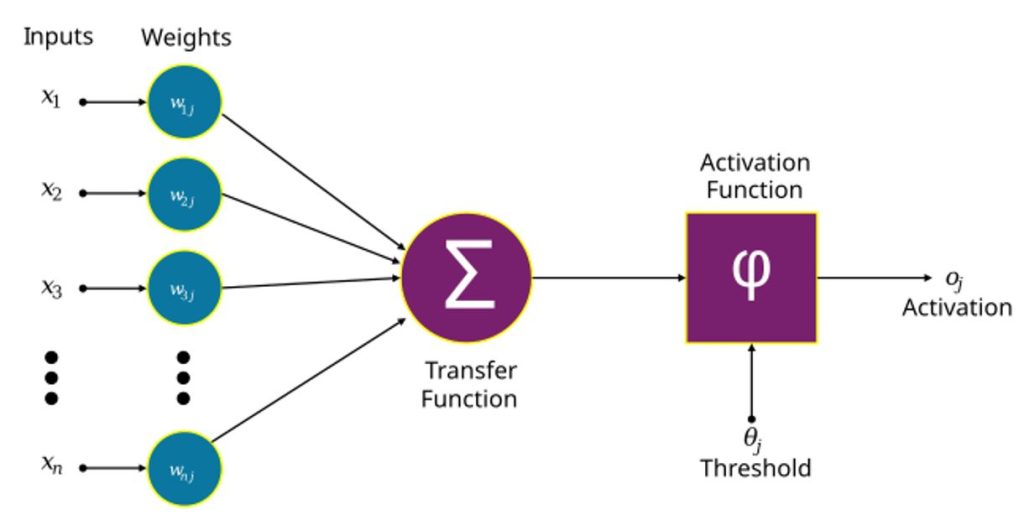

Podstawowa koncepcja neuronu, inspirowana biologicznymi neuronami w ludzkim mózgu, wciąż opiera się na stosunkowo prostym równaniu matematycznym: sumowaniu wartości wejściowych, przemnożeniu ich przez wagi, dodaniu biasu, a następnie przepuszczeniu wyniku przez funkcję aktywacji.

Ta prostota stanowi klucz do elastyczności i siły sieci neuronowych, umożliwiając ich skalowanie do głębokich architektur bez konieczności zmiany podstawowego budulca. W istocie, chociaż krajobraz sieci neuronowych rozwija się dynamicznie, neuron pozostaje taki sam.

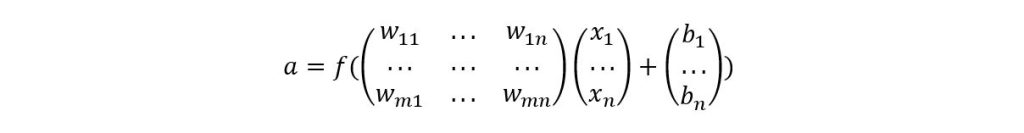

Poniżej znajduje się matematyczna reprezentacja sztucznego neuronu:

Sieci neuronowe opierają się na funkcjach aktywacji, aby wprowadzić nieliniowość, co pozwala im rozwiązywać złożone problemy. Podczas treningu dostosowywane są wagi, natomiast biasy i funkcje aktywacji zazwyczaj pozostają niezmienne. Zgodnie z Twierdzeniem o Uniwersalnej Aproksymacji, nawet jedna warstwa ukryta z wystarczającą liczbą neuronów może aproksymować dowolną funkcję ciągłą.

Jednakże, aby rozwiązać bardziej złożone zadania, często wymagane są głębokie sieci neuronowe – perceptrony wielowarstwowe (MLP) – które składają się z wielu warstw neuronów i są zdolne do rozwiązywania takich wyzwań jak rozpoznawanie obrazów czy tłumaczenie języków.

Twierdzenie Kolmogorova-Arnolda jako inspiracja

Ostatnio wprowadzono nowy typ algorytmu znany jako Sieć Kolmogorova-Arnolda (Kolmogorov-Arnold Network – KAN), co stanowi istotny postęp w architekturze sieci neuronowych. To nowatorskie podejście wykazuje duży potencjał do przewyższania tradycyjnych MLP, oferując nowe możliwości w zakresie poprawy wydajności i efektywności przy rozwiązywaniu skomplikowanych zadań. Jego innowacyjna struktura może pomóc pokonać niektóre ograniczenia obecnych modeli głębokiego uczenia, potencjalnie zmieniając krajobraz badań i zastosowań sieci neuronowych.

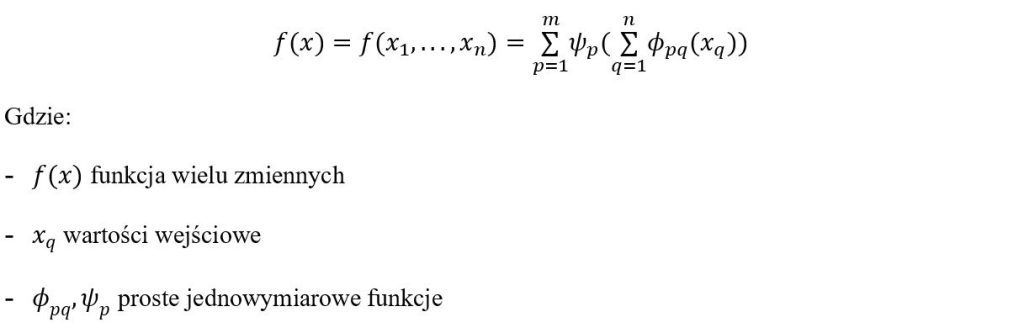

Nowy algorytm inspirowany jest Twierdzeniem Reprezentacyjnym Kolmogorova-Arnolda, które mówi, że każdą złożoną funkcję wielu zmiennych można rozłożyć na prostsze funkcje, z których każda zależy tylko od jednej zmiennej. Takie rozbicie ułatwia rozwiązywanie trudnych problemów poprzez skupienie się na jednym czynniku naraz.

KAN – nowa architektura sieci neuronowej

W algorytmie koncepcja ta jest stosowana poprzez rozbicie złożonego, nieliniowego problemu uczenia maszynowego na mniejsze, łatwiejsze do opanowania komponenty. Każda niestandardowa funkcja aktywacji upraszcza złożoną zależność między cechą a etykietą. Jest to pokazane na grafice powyżej.

Sumując wyniki wszystkich tych uproszczonych funkcji, otrzymujemy końcową predykcję dla całego problemu.

Matematycznie można to wyrazić w następujący sposób:

W implementacji KAN funkcja ψ jest operacją tożsamościową ψ(x)=x.

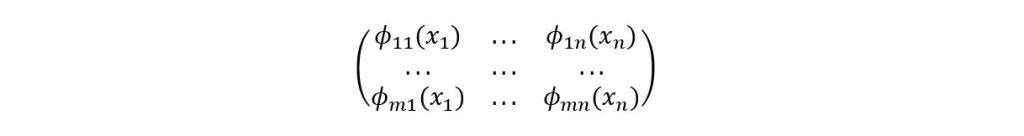

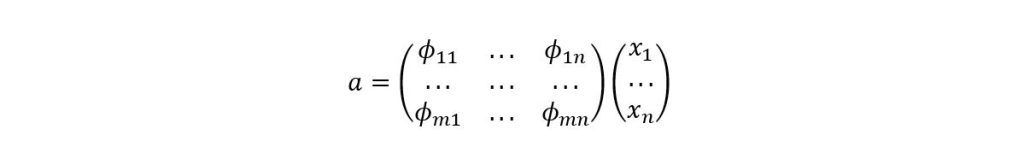

Bardziej intuicyjną reprezentacją sieci neuronowej byłaby forma macierzowa. Poniższa macierz ilustruje, jak wyglądałaby warstwa z n wejściami w algorytmie Kolmogorov-Arnold Network (KAN).

Gdzie do każdej wartości wejściowej jest osobna funkcja aktywacji ϕ.

Funkcje aktywacji jako parametry uczące się

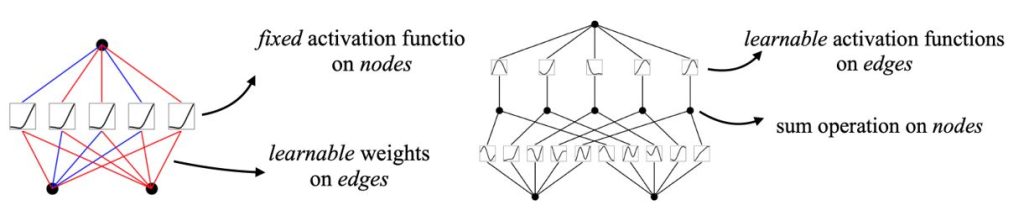

W porównaniu do standardowej sieci MLP, w której funkcje aktywacji są stałe i znajdują się w węzłach, a jedynymi uczącymi się parametrami są wagi na krawędziach, sieć Kolmogorov-Arnold Network (KAN) przyjmuje inne podejście.

W KAN funkcje aktywacji też są parametrami uczącymi się i umieszczone są na krawędziach, natomiast węzły wykonują operację sumowania wyników tych funkcji aktywacji. Takie podejście zapewnia większą elastyczność w modelowaniu złożonych zależności.

Koncepcja ta została zilustrowana na wykresie przedstawionym na Ryc. 3.

Jak stworzyć własną funkcję aktywacji?

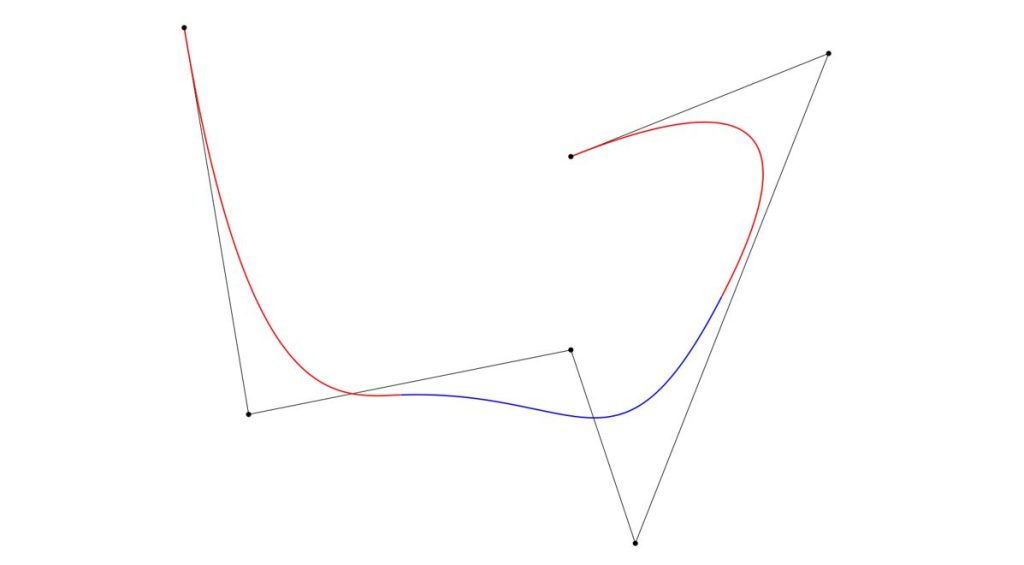

Wszystko w tym algorytmie brzmi logicznie i intuicyjnie, ale pozostaje pytanie – jak oszacować funkcję aktywacji dla każdego wejścia i zastosować ją wielokrotnie w każdej warstwie? Odpowiedź kryje się w B-splainach. B-splain (ang. B-spline, czyli basis spline) to elastyczna krzywa złożona z kilku połączonych segmentów, co pozwala na tworzenie gładkich i złożonych kształtów.

Mówiąc prościej, B-splain to krzywa określana przez punkty kontrolne, dzięki którym można ją formować w różnorodne kształty w celu aproksymacji różnych funkcji. Jedną z jej głównych zalet jest możliwość stosowania B-splainów do różniczkowania numerycznego, co czyni je idealnymi do stosowania w propagacji wstecznej podczas trenowania sieci Kolmogorowa-Arnolda (KAN).

Charakterystyczną cechą B-splain jest to, że modyfikacja pojedynczego punktu kontrolnego wpływa tylko na lokalną część krzywej, pozostawiając resztę bez zmian. Poprzez manipulację tymi punktami kontrolnymi w celu dopasowania kształtu B-splaina, efektywnie trenujemy sieć. Punkty kontrolne działają jako główne parametry uczące się i stanowią podstawę działania sieci Kolmogorowa-Arnolda.

Poniżej, na Ryc. 4, przedstawiono przykład krzywej utworzonej przez kilka punktów kontrolnych. Bardziej szczegółowe informacje można znaleźć na łamach Wikipedii.

Rozumiejąc już podstawową ideę sieci KAN, nasza sztuczna sieć neuronowa będzie miała nieco inny kształt. W tradycyjnym MLP (wielowarstwowym perceptronie) uczącymi się parametrami są wagi, natomiast w KAN parametrami uczącymi się są również punkty kontrolne B-splainach.

Pojedynczą warstwę wielowarstwowego perceptronu (MLP) można opisać za pomocą wektorów i macierzy:

Wejściowy Wektor: Cechy wejściowe tworzą wektor xMacierz Wag: Wagi łączące wejścia z neuronami są reprezentowane przez macierzWektor Biasu: Każdy neuron ma bias, reprezentowany jako wektor bTransformacja Liniowa: Wejście przechodzi przez transformację liniową z=Wx+bFunkcja Aktywacji: Funkcja aktywacji jest stosowana do wyników, produkując wektor wyjściowy a=f(z)

Jedna warstwa dla KAN będzie trochę się różniła

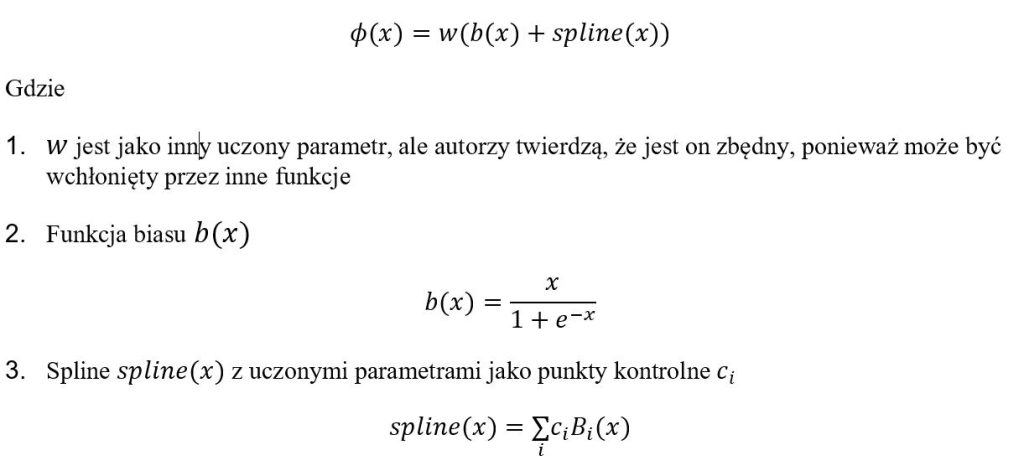

Gdzie ϕ_mn są funkcjami aktywacji. W publikacji [1] funkcja aktywacji ma następujący wygląd

Porównanie KAN i MLP: wydajność i interpretowalność

Na podstawie powyższych wzorów można zauważyć, że MLP mają mniej uczących się parametrów niż KAN, co oznacza, że KAN wymaga większej mocy obliczeniowej i więcej czasu na trening.

Jednak innowacją w tym nowym algorytmie jest to, że możemy używać mniejszej liczby neuronów i warstw, optymalizując nie tylko wagi w neuronach, ale także funkcje aktywacji. Podczas treningu wykorzystywana jest optymalizacja oparta na gradientach do dostosowywania pozycji punktów kontrolnych splainów – podobnie jak wagi w tradycyjnych sieciach. W artykule opisano, w jaki sposób model KAN z mniejszą liczbą warstw przewyższa standardowe sieci MLP.

Oprócz mniejszego rozmiaru i zoptymalizowanych funkcji aktywacji, KAN oferuje dużą zaletę w zakresie interpretowalności. Dzięki analizie wyuczonych B-splainów możemy uzyskać wgląd w sposób działania modelu, w przeciwieństwie do MLP, które działają jako całkowicie czarna skrzynka. Kolejną mocną stroną KAN jest jego zdolność do uczenia ciągłego – podczas dostrajania model zachowuje wiedzę z pierwotnego zadania. Jest to możliwe dzięki właściwościom B-splainów, gdzie dostosowanie jednego punktu kontrolnego wpływa jedynie na lokalny fragment krzywej.

Zastosowanie i potencjał praktyczny

Oryginalna publikacja o KAN [1] przedstawia kilka przykładów różnych zadań, w których model KAN osiągnął lepsze wyniki przy mniejszej liczbie parametrów w porównaniu z tradycyjnymi modelami MLP. Na przykład w zadaniu klasyfikacji podpisów(signature classification) model KAN osiągnął dokładność 81,6%, podczas gdy tradycyjny model MLP osiągnął 78% (Tabela 3 z [1]).

Ponadto, artykuł pokazuje, że w zadaniach wymagających regresji symbolicznej oraz odkrywania wielomianowych zależności wyższego rzędu (np. dopasowywanie danych do złożonych funkcji), sieci KAN konsekwentnie przewyższały MLP, lepiej uchwytując te zależności bez potrzeby stosowania głębokich architektur lub długiego czasu treningu.

Publikacje naukowe jednak wskazują, że choć KAN nie jest uniwersalnie lepszy od innych modeli, to może przewyższać klasyczne modele w określonych zadaniach i dziedzinach.

Bardziej kompleksowe porównanie przeprowadzono w artykule KAN or MLP: A Fairer Comparison [4], w którym oceniano wydajność modelu KAN w zadaniach z zakresu uczenia maszynowego (na ośmiu zbiorach danych), wizji komputerowej, przetwarzania języka naturalnego (NLP) oraz przetwarzania dźwięku. Badanie wykazało, że standardowe modele MLP nieznacznie przewyższały modele KAN, a różnice w dokładności wynosiły od 0,2% (dla zadań ML) do 8% (dla zadań z obszaru wizji komputerowej).

Dodatkowo, kilka kolejnych badań analizowało adaptacje KAN w wyspecjalizowanych dziedzinach. Jednym z takich przykładów jest publikacja FourierKAN outperforms MLP on Text Classification Head Fine-tuning [5], w której zaproponowano zmodyfikowaną wersję KAN o nazwie Fourier KAN (FR-KAN). W badaniu tym FR-KAN został użyty jako alternatywa dla ostatniej warstwy do klasyfikacji opartej na MLP w zadaniach klasyfikacji tekstu i wykazał znaczące ulepszenia – średni wzrost dokładności o 10% oraz poprawę wskaźnika F1 o 11% w siedmiu wstępnie wytrenowanych modelach transformerów i czterech zadaniach do klasyfikacji.

Obecnie nie ma jeszcze znanych wdrożeń KAN na poziomie produkcyjnym, jednak model wzbudził duże zainteresowanie w środowisku naukowym. Liczne badania proponują modyfikacje i adaptacje KAN, pokazując jego potencjał do osiągania wyższej wydajności w określonych przypadkach użycia. Prace te podkreślają jednak, że KAN nie jest rozwiązaniem uniwersalnym – aby uzyskać przewagę nad innymi modelami, wymaga starannego dostrojenia i przemyślanego zastosowania.

Dotychczas KAN wykazuje największy potencjał w zadaniach wymagających rozumowania symbolicznego, analizy szeregów czasowych oraz aproksymacji funkcji.

Wnioski i przyszłość KAN

Kolmogorov-Arnold Network wprowadza nowe spojrzenie na od dawna stosowane zasady w sieciach neuronowych, w szczególności na funkcję aktywacji, która przez lata pozostawała praktycznie niezmieniona. Chociaż podstawowa struktura sztucznego neuronu pozostaje taka sama, KAN pozwala na precyzyjne dostrajanie funkcji aktywacji, umożliwiając sieci lepsze modelowanie złożonych zależności między cechami a etykietami. Ta elastyczność może prowadzić do lepszej skuteczności w rozumieniu skomplikowanych wzorców danych.

Jednak pojawia się kilka istotnych pytań:

- Czy ten algorytm okaże się równie skuteczny w rzeczywistych zastosowaniach, jak w przykładach zabawkowych lub testach kontrolnych opisanych w artykule?

- Czy warstwy KAN można skutecznie łączyć z tradycyjnymi warstwami MLP, aby zmniejszyć liczbę uczonych parametrów? Jaki wpływ miałoby to na ogólną dokładność i wydajność modelu?

Te otwarte pytania podkreślają potencjał KAN, a jednocześnie wskazują na potrzebę dalszych badań i eksperymentów, aby w pełni zrozumieć jego praktyczne korzyści.

Literatura

- Chen, Z., Choi, H., Poggio, T., Balestriero, R., & Baraniuk, R. (2024). KAN: Kolmogorov-Arnold Networks. arXiv preprint arXiv:2404.07143

- Schoenberg, I. J. (1946). Contributions to the problem of approximation of equidistant data by analytic functions. Quarterly of Applied Mathematics, 4, 45–99 and 112–141.

- Why is the (KAN) Kolmogorov-Arnold Networks so promising

- Runpeng Yu, Weihao Yu, and Xinchao Wang (2024). KAN or MLP: A Fairer Comparison. National University of Singapore

- Abdullah Al Imran, & Md Farhan Ishmam (2024). FourierKAN outperforms MLP on Text Classification Head Fine-tuning

***

Jeżeli interesuje Cię tematyka sieci neuronowych, zajrzyj koniecznie również do innych artykułów naszych ekspertów.

Zostaw komentarz