Najważniejsza zmiana nie polega już na tym, że AI potrafi wygenerować kod lub szkic testu. Zarówno OpenAI, jak i Anthropic coraz wyraźniej budują narzędzia skierowane do realnych workflowów developerskich i jakościowych: pracy na kodzie, repozytorium, GUI, terminalu, środowiskach wykonawczych oraz artefaktach końcowych.

Dla Test Developera oznacza to przesunięcie z pytania: „Czy AI napisze test?” na pytanie: „Jak zaprojektować system jakości, z którego ludzie i agenci będą mogli bezpiecznie korzystać?”.

Dlaczego ten temat jest dziś ważniejszy niż jeszcze kilka miesięcy temu

Jeszcze niedawno większość rozmów o AI w testach koncentrowała się wokół przyspieszenia dobrze znanych zadań:

- generowania test case’ów,

- proponowania asercji,

- tworzenia boilerplate’u pod Playwrighta,

- pisania pomocniczych snippetów.

To nadal ma znaczenie, ale przestaje być głównym wyróżnikiem rynku.

W najnowszych premierach i aktualizacjach obu firm widać już inny poziom ambicji. Coraz mniej chodzi o „chat, który trochę pomaga”, a coraz bardziej o systemy zdolne do czytania kodu, wykonywania poleceń, pracy na plikach, używania GUI i wspierania długich, wieloetapowych zadań.

Z perspektywy Test Developera jest to istotne, bo wpływa nie tylko na samo tworzenie testów, ale też na architekturę frameworku, utrzymanie bibliotek, evidence gathering, governance oraz sposób łączenia testów z bezpieczeństwem i walidacją ryzyka.

Co zmienia się w pracy Test Developera

Osoba odpowiedzialna za duży framework testowy i biblioteki współdzielone przez wiele aplikacji od dawna nie zajmuje się tylko pojedynczym skryptem. To rola obejmująca projektowanie warstw abstrakcji, wspólnych standardów, integracji, raportowania, podejścia do danych testowych, a coraz częściej także jakości procesu wokół całego ekosystemu narzędziowego.

Nowe narzędzia AI wzmacniają tę zmianę. Framework musi być dziś czytelny nie tylko dla programisty lub automatyka, ale coraz częściej także dla agenta. Stabilne kontrakty, spójne nazewnictwo, przewidywalne helpery, dobre przykłady użycia i sensownie opisane moduły zaczynają działać jak „interfejs jakości” nie tylko dla człowieka, ale także dla systemów AI.

To przesuwa architekturę testów bliżej architektury platformy. W praktyce liczy się już nie tylko to, czy framework pozwala coś przetestować, ale również to, czy daje się bezpiecznie eksplorować, analizować i rozszerzać w półautonomicznych workflowach.

Od generowania testów do agentowego wykonywania walidacji

Najbardziej praktyczna zmiana polega na tym, że dzisiejsze modele coraz częściej wychodzą poza samo „pisanie”. Mogą czytać repozytorium, pracować na wielu plikach, uruchamiać polecenia, zbierać logi, wykonywać testy i przechodzić przez interfejs. W tym sensie AI staje się bliższa agentowi wykonującemu część walidacji niż asystentowi podpowiadającemu pojedynczą linijkę kodu.

Dla testów oznacza to, że jeden workflow może łączyć:

- analizę zmian,

- propozycję pokrycia,

- wykonanie wybranych kroków przez GUI,

- zebranie screenshotów,

- powiązanie wyników z logami,

- przygotowanie podsumowania dla zespołu.

To jest dużo bliższe realnej pracy w projektach enterprise niż klasyczne: „Napisz mi test w narzędziu X”.

Gdzie wpływ będzie widoczny najszybciej

| Obszar | Co zmienia się teraz | Znaczenie dla architektury testów |

| Utrzymanie frameworku | AI szybciej analizuje zależności, helpery, strukturę bibliotek i miejsca wspólne dla wielu aplikacji. | Rośnie znaczenie czystych kontraktów, dobrych przykładów i łatwego „odkrywania” możliwości frameworku. |

| Eksploracja GUI i reprodukcja błędów | Computer Use pozwala przejść przez interfejs, zebrać dowody i odtworzyć problemy poza samym API. | Potrzebny jest świadomy podział między eksploracją agentową a stabilną regresją. |

| Triaging i evidence gathering | Modele mogą łączyć logi, trace’y, screenshoty, historię zmian i hipotezę przyczyny. | Standaryzacja artefaktów i obserwowalności staje się jeszcze ważniejsza. |

| Testy a security | Agent może nie tylko wykonać test, ale też analizować potencjalne ścieżki nadużyć i podatności. | Granica między jakością, architekturą testów i bezpieczeństwem zaczyna się zacierać. |

| Komunikacja z interesariuszy | AI potrafi szybciej przygotowywać podsumowania, slajdy, one-pagery i materiały wizualne. | Raportowanie jakości może stać się bardziej spójne i mniej kosztowne operacyjnie. |

Codex i zwrot OpenAI w stronę pracy developerskiej

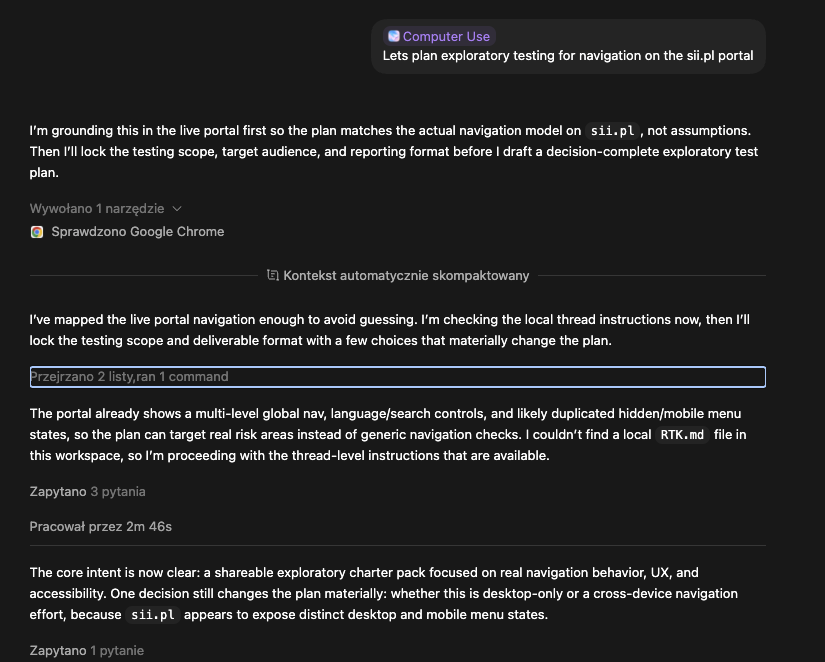

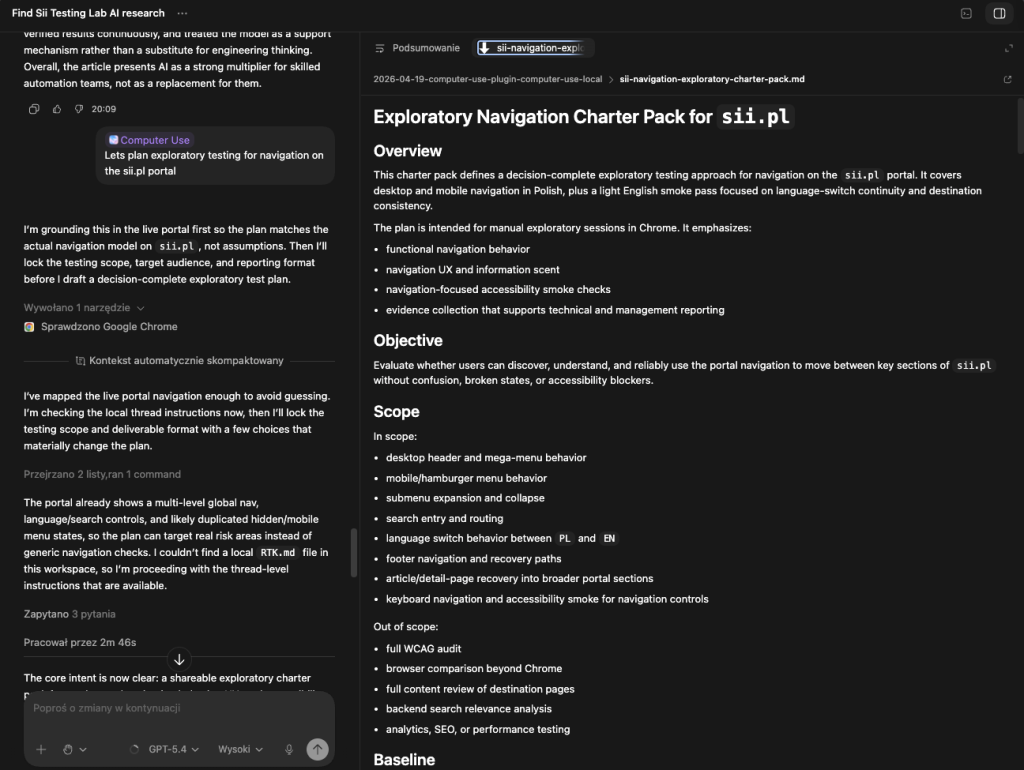

Jednym z ważniejszych sygnałów ostatnich miesięcy jest coraz wyraźniejsze przesunięcie AI w stronę narzędzi wspierających codzienną pracę inżynierską. Nie chodzi już wyłącznie o generowanie fragmentów kodu, ale o pracę na wielu plikach, w terminalu, IDE, środowisku webowym i w zadaniach wykonywanych częściowo niezależnie. Coraz ważniejszym elementem tego kierunku staje się również Computer Use, czyli zdolność AI do pracy nie tylko na poziomie kodu, ale także poprzez przeglądarkę, GUI, obraz i wizualną weryfikację efektów, co szczególnie mocno zbliża te narzędzia do realnych workflowów testerskich i jakościowych.

Dodatkowym sygnałem tej zmiany jest wygaszanie części wcześniejszych inicjatyw bardziej oddalonych od software engineeringu i równoległe wzmacnianie warstwy agentowej, codingowej i środowiskowej. Z perspektywy testów ważniejsze od samej listy produktów jest to, że AI coraz mocniej wchodzi w realny obieg pracy zespołów deweloperskich i jakościowych. Oznacza to nie tylko szybsze pisanie kodu, ale także większą zdolność do przechodzenia przez workflowy, wykonywania zadań w środowisku, iterowania na podstawie wyniku i zbierania dowodów pracy.

Z perspektywy testów nie chodzi więc o prostą tezę, że jeden dostawca zaczyna przypominać drugiego. Chodzi raczej o to, że obie firmy coraz mocniej spotykają się w tym samym miejscu rynku: AI jako warstwa wspierająca realną pracę na kodzie, repozytorium, narzędziach, środowiskach i interfejsach, a nie tylko osobny chat do inspiracji.

Najnowsza premiera GPT-5.5 dodatkowo wzmacnia ten kierunek. OpenAI pozycjonuje ten model jako rozwiązanie do real work – z mocniejszym planowaniem, skuteczniejszym użyciem narzędzi, większą samodzielnością w zadaniach wieloetapowych oraz silniejszymi wynikami w obszarach takich jak agentic coding, computer use, knowledge work i research. Z perspektywy testów i quality engineeringu jest to ważne, dlatego że potwierdza przesunięcie od „AI do generowania fragmentów kodu” w stronę AI, która coraz lepiej radzi sobie z pracą w środowisku, na narzędziach i przy dłuższym przepływie zadań.

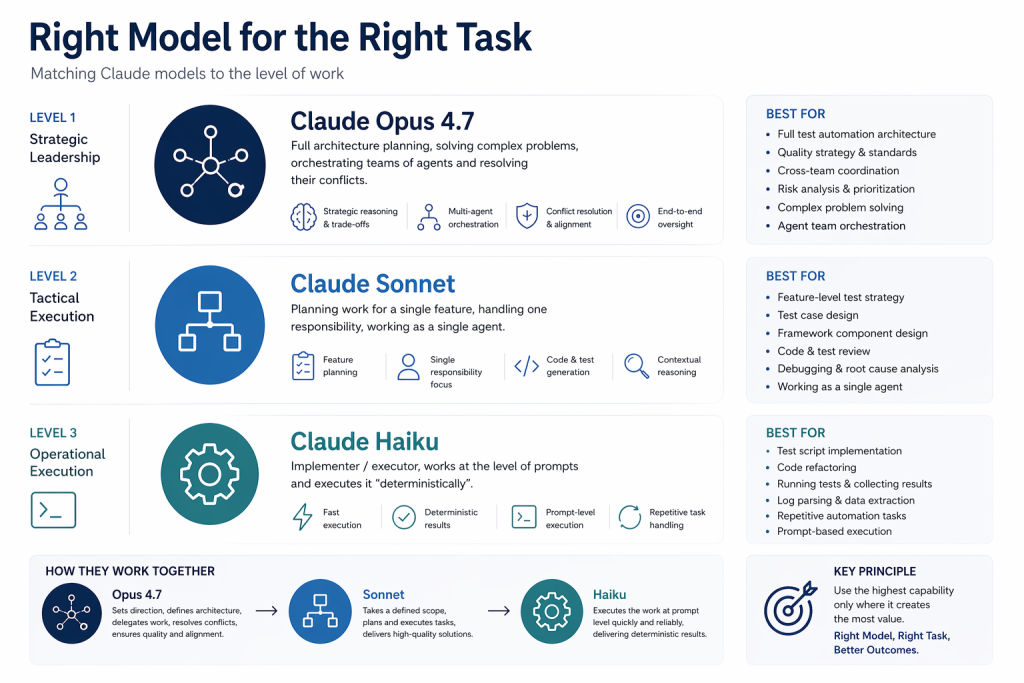

Claude Opus 4.7 i Claude Code – kolejny krok w stronę pracy długofalowej

Równolegle bardzo wyraźnie rozwija się drugi kierunek rynku: narzędzia, które potrafią czytać codebase, wprowadzać zmiany w wielu plikach, uruchamiać komendy, wykonywać testy i utrzymywać kontekst dłuższych workflowów. To już nie jest tylko „pomoc przy kodzie”, ale warstwa zaczynająca przypominać wykonawcę części pracy.

Dla architektów testów jest to ważne dlatego, że właśnie takie zadania – wieloetapowe, przekrojowe, osadzone między kodem, testami, logami i środowiskiem – należą dziś do najbardziej kosztownych i czasochłonnych. Im lepiej modele radzą sobie z tego typu pracą, tym większy wpływ będą miały na jakość i sposób utrzymania frameworków.

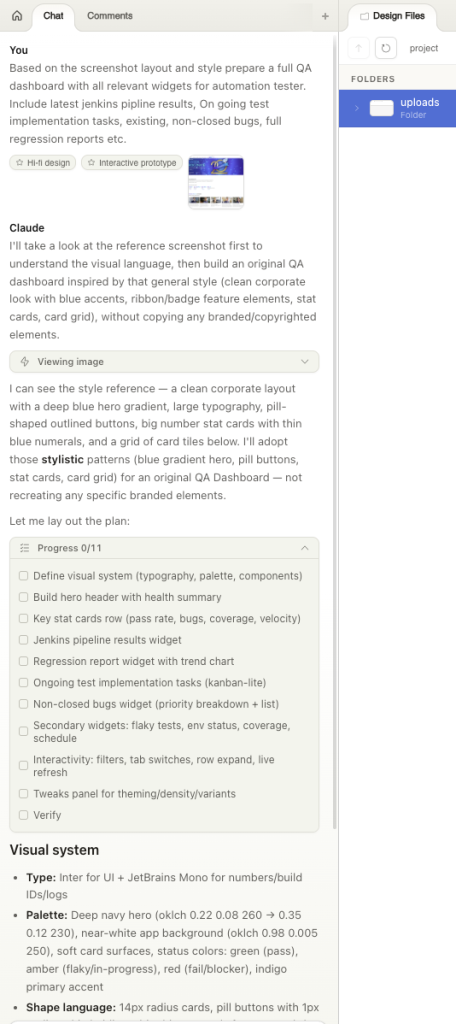

Claude Design – dlaczego to jest ważne również dla testów

Równie ciekawy jest kierunek związany z tworzeniem bardziej dopracowanych artefaktów końcowych: prototypów, slajdów, one-pagerów i innych materiałów roboczych. Dla testów może to wydawać się mniej oczywiste niż praca na kodzie czy GUI, ale w praktyce dotyka ważnej części codziennych obowiązków architekta jakości.

Coraz więcej pracy kończy się dziś nie tylko testem lub wynikiem uruchomienia, ale także materiałem do komunikacji:

- strategią testów,

- podsumowaniem ryzyk,

- release readiness summary,

- evidence packiem,

- prezentacją dla interesariuszy.

Jeżeli narzędzia AI zaczynają sprawnie tworzyć takie artefakty, zmienia się nie tylko sposób analizy, ale też sposób opowiadania o jakości w organizacji.

To dodatkowo wzmacnia znaczenie testów niefunkcjonalnych, zwłaszcza tych związanych z doświadczeniem użytkownika i dostępnością. Im więcej zespoły projektują i oceniają na poziomie interfejsu oraz komunikacji wartości, tym bardziej rośnie potrzeba sensownego połączenia testów manualnych, eksploracyjnych i automatycznych.

Codex Security i Claude Mythos – gdy testy spotykają się z bezpieczeństwem

Bardzo ważnym uzupełnieniem tego obrazu są nowe wątki związane z bezpieczeństwem. Najwięksi dostawcy zaczynają rozwijać rozwiązania, które nie tylko pomagają pisać lub wykonywać testy, ale też budują kontekst o systemie, identyfikują podatności, priorytetyzują ryzyko i wspierają działania naprawcze.

Dla Test Developera to mocny sygnał, że granica między testowaniem, walidacją ryzyka, analizą jakości systemu i bezpieczeństwem będzie coraz mniej wyraźna. Frameworki i procesy jakościowe trzeba będzie projektować nie tylko pod wykonywanie testów, ale również pod współpracę z agentami, którzy badają system szerzej – od poprawności działania po odporność i realny wpływ wykrytych problemów.

Governance – dlaczego staje się częścią architektury jakości

Im bardziej agent może działać na kodzie, GUI, terminalu czy środowisku wykonawczym, tym ważniejsze stają się granice bezpieczeństwa i reguły użycia. Materiały dostawców coraz wyraźniej podkreślają potrzebę izolacji środowisk, sandboxingu, kontroli dostępu i działań wymagających akceptacji człowieka.

Dla organizacji oznacza to, że governance nie może już być traktowane jako warstwa „po wszystkim”. Musi wejść do rdzenia architektury testów i jakości. Trzeba zdefiniować, na jakich kontach pracują agenci, jakie środowiska mogą dotykać, jakie działania są automatyczne, które wymagają człowieka w pętli, jak logowane są ich kroki i gdzie trafiają dowody wykonanej pracy.

Jak to wpływa na testy już teraz

W krótkim terminie największe korzyści pojawią się tam, gdzie praca jest wieloetapowa, kontekstowa i kosztowna czasowo. Dotyczy to analizy zmian, zrozumienia nieznanego kodu, adaptacji testów po zmianach UI, odtwarzania błędów, łączenia logów i screenshotów z hipotezami przyczyn oraz przygotowywania materiałów końcowych dla zespołów i interesariuszy.

Nie należy jednak mylić jednorazowego sukcesu agenta z wartościowym, stabilnym elementem regresji. Nadal pozostają wyzwania związane z niezawodnością, danymi testowymi, doborem asercji, dostępem do środowisk, ryzykiem prompt injection i oceną, czy wynik rzeczywiście ma sens biznesowy. To właśnie dlatego rola architekta jakości nie maleje – przesuwa się po prostu na wyższy poziom odpowiedzialności.

Warunki powodzenia i ograniczenia

Warto jednak jasno powiedzieć, że sam wzrost możliwości modeli nie oznacza automatycznie dojrzałego wdrożenia w obszarze jakości. Największą wartość zespoły osiągną tam, gdzie AI zostanie osadzone w dobrze zaprojektowanym frameworku, przewidywalnych bibliotekach, kontrolowanych środowiskach i sensownym procesie review. Bez tego nawet bardzo sprawny agent może przyspieszać pracę tylko pozornie – generując wyniki szybciej, ale niekoniecznie w sposób wystarczająco stabilny, utrzymywalny i bezpieczny.

Ograniczenia pozostają realne. Nadal znaczenie mają:

- jakość danych testowych,

- dobór asercji,

- dostęp do środowisk,

- ryzyko prompt injection,

- kontrola działań wykonywanych przez agenta,

- zdolność zespołu do oceny czy wynik rzeczywiście ma sens biznesowy.

Właśnie dlatego rola człowieka nie znika z procesu. Zmienia się natomiast jej charakter: coraz mniej chodzi o ręczne wykonywanie każdego kroku, a coraz bardziej o świadome projektowanie współpracy pomiędzy ludźmi, narzędziami i agentami.

W jakim kierunku to wszystko zmierza

Najciekawsze w obecnym kierunku rynku nie jest to, że modele coraz lepiej piszą kod. Znacznie ważniejsze jest to, że coraz lepiej uczestniczą w pracy wykonywanej na kodzie, narzędziach, interfejsach i środowiskach. To właśnie tam zaczyna zmieniać się codzienna praktyka Test Architecta.

O ile jeszcze niedawno AI kojarzyło się przede wszystkim ze wsparciem przy tworzeniu testów, o tyle dziś coraz wyraźniej wpływa na sposób projektowania całego systemu jakości: od implementacji, przez analizę i eksplorację, po governance, bezpieczeństwo i komunikację wyników.

Największą wartość osiągną te zespoły, które potraktują AI nie jako prosty akcelerator, lecz jako nową warstwę wspierającą świadomie zaprojektowaną architekturę jakości. Człowiek nie zniknie z procesu. Jego rola będzie jednak coraz częściej polegała na projektowaniu współpracy pomiędzy ludźmi, narzędziami i agentami.

Wczorajsza premiera GPT-5.5 jeszcze mocniej potwierdza ten kierunek. OpenAI opisuje go jako model do real work, z wyraźną poprawą w agentic coding, computer use, tool use i knowledge work, co dobrze wpisuje się w szerszą zmianę: AI coraz mniej przypomina „chat do pomysłów”, a coraz bardziej warstwę wspierającą realne workflowy inżynierskie i jakościowe.

Wniosek końcowy

Najciekawsze w obecnym kierunku rynku nie jest to, że modele coraz lepiej piszą kod. Znacznie ważniejsze jest to, że coraz lepiej uczestniczą w pracy wykonywanej na kodzie, narzędziach, interfejsach i środowiskach. To właśnie tam zaczyna zmieniać się codzienna praktyka Test Developera.

Jeżeli kilka miesięcy temu można było jeszcze mówić głównie o wsparciu przy tworzeniu testów, to dziś coraz bardziej chodzi o projektowanie systemu jakości, w którym AI wspiera nie tylko implementację, ale również analizę, eksplorację, bezpieczeństwo, governance i komunikację wyników. To przesunięcie jest dużo istotniejsze niż sama poprawa w generowaniu kodu i właśnie ono może najmocniej wpłynąć na testowanie w najbliższych latach.

Źródła

- OpenAI – „Introducing upgrades to Codex„

- OpenAI – „Codex Security: now in research preview„

- OpenAI Help Center – „Codex Security”

- OpenAI Help Center – „What to know about the Sora discontinuation”

- Anthropic – „Introducing Claude Opus 4.7”

- Anthropic – „Introducing Claude Design by Anthropic Labs”

- Anthropic – „Claude Code by Anthropic” and Claude Code overview documentation

- Anthropic – Project Glasswing and model documentation referencing Claude Mythos Preview

Zostaw komentarz