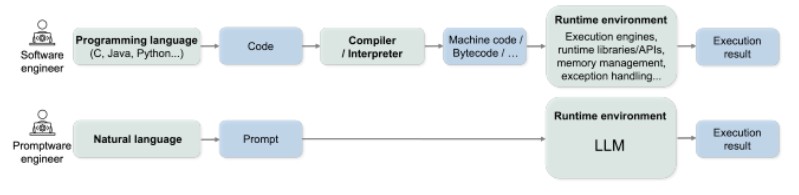

Współczesna inżynieria promptów (ang. prompt engineering) to kluczowa umiejętność pozwalająca na przekształcanie niejasnych intencji w precyzyjne instrukcje, dzięki którym modele AI stają się przewidywalne i użyteczne. Dla inżynierów oprogramowania stanowi ona nowy rodzaj interfejsu programistycznego (API), umiejscowionego pomiędzy kodem a dużymi modelami językowymi (LLM).

Po przeczytaniu tego artykułu dowiesz się:

- Jak projektować ustrukturyzowane prompty jako artefakty inżynieryjne: formułować prompty przy użyciu jasnych ról, zadań, ograniczeń i schematów wyjściowych, tak aby zachowanie modelu językowego (LLM) było jak najbardziej przewidywalne, możliwe do przetestowania i odpowiednie do integracji z rzeczywistymi systemami.

- Jak stosować wzorce promptów wielokrotnego użytku do zadań związanych z kodowaniem: wykorzystywać kluczowe wzorce, takie jak prompty instrukcyjne (ang. instruction prompt), prompty typu few-shot, chain-of-thought, aby usprawnić generowanie kodu, refaktoryzację, utrzymywanie dokumentacji czy tworzenie testów.

- Jak systematycznie oceniać i iterować odpowiedzi: budować proste pętle oceny z reprezentatywnymi danymi wejściowymi, definiować kryteria sukcesu czy udoskonalać prompty na podstawie zaobserwowanych anomalii, traktując zmiany promptów jak regularną iterację deweloperską.

Prompty jako podstawa komunikacji z LLM

Inżynieria promptów jest praktyką projektowania, udoskonalania oraz optymalizacji danych wejściowych tak, aby systemy generatywnej AI zwracały odpowiedź wysokiej jakości. Prompt jest porównywany do parametrów kontraktu API czy pliku konfiguracyjnego w aplikacji, który definiuje zamiar, ograniczenia oraz kontekst operacji.

Nowoczesne tutoriale opisują inżynierię promptów zarówno jako sztukę jak i naukę. Proces ten jest niekończącym się rytuałem, który z każdą iteracją zwraca lekko zmodyfikowaną odpowiedź. Można powiedzieć, że jest to proces predykcji odpowiedzi. Model przyjmuje sekwencyjnie tekst jako dane wejściowe, a następnie dokonuje predykcji kolejnego tokenu, bazując na danych, na których został wytrenowany. Jest to proces iteracyjny, w którym duży model językowy przewiduje kolejne tokeny na podstawie wcześniejszych wyborów, danych wejściowych oraz rezultatów treningu modelu na danych.

Dlaczego LLM-y i prompty są ważne?

Każdy z nas doświadczył skoku produktywności, stosując sztuczną inteligencję. Obecnie jest ona szeroko wykorzystywana w procesie pisania kodu, dokumentacji, interfejsu użytkownika czy interpretacji wyników. Odpowiednio zaprojektowane prompty znacznie redukują czas potrzebny na przeprowadzenie refaktoryzacji kodu, utworzenia nowego modułu w projekcie czy napisaniu test-case’ów dla nowych bądź też już istniejących funkcjonalności.

W dalszym ciągu należy pamiętać, że ostatecznie to my jesteśmy odpowiedzialni za rezultaty pracy z wykorzystaniem sztucznej inteligencji. AI pełni tutaj tylko i wyłącznie funkcję asystenta.

Z punktu widzenia systemów, prompty stają się dodatkową warstwą konfiguracji, a zwracane z ich pomocą wyniki stają się częścią praktyk inżynierii oprogramowania.

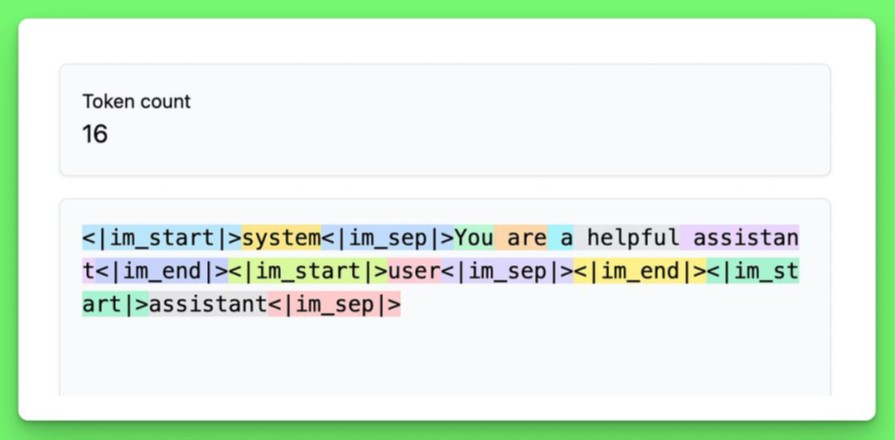

Konsumpcja tokenów

W procesie tworzenia i wykonywania promptów LLM-y traktują tokeny jak walutę. Każda interakcja jest przetwarzana na numeryczne fragmenty, które następnie są odczytywane przez AI. Rozumienie utylizacji tokenów jest istotne nie tylko dla osób technicznych. Jest to krytyczna umiejętność pozwalająca optymalizować koszty modelu, szybkość zwracanych wyników oraz jakość odpowiedzi.

Tokenizacja jest procesem podziału języka naturalnego na mniejsze fragmenty zwane tokenami. Każdy model pracuje na swoim maksymalnym zakresie tokenów, które są przetwarzane w danych momencie. Zakres ten nazywany jest oknem kontekstowym (ang. Context Window). Jeżeli prompt jest zbyt rozbudowany, LLM może zapomnieć początku konwersacji.

Komunikacja z LLM za pomocą tokenów przyjmuje wartości na wejściu i wyjściu całego procesu:

- tokeny wejściowe: prompt + historia konwersacji,

- tokeny wyjściowe: odpowiedź modelu.

Suma tokenów wejściowych i wyjściowych musi pozostać w zakresie modelu (GPT-4 128 tysięcy tokenów, Gemini 1.5 Pro ponad 1 milion tokenów).

Fundamenty i struktura promptu

Dyscyplina ta traktuje prompt jako pełnoprawny artefakt inżynieryjny, podobny do kontraktu API lub pliku konfiguracyjnego.

Dobrze skonstruowany prompt powinien zawierać:

- Rolę: Określenie, kim jest model (np. „Jesteś doświadczonym programistą C#”),

- Zadanie: Konkretny cel (np. refaktoryzacja, generowanie testów),

- Tagi w stylu XML: Np. <context>, <constraints>, które pomagają modelowi rozróżnić sekcje instrukcji,

- Instrukcje pozytywne: Kładzenie nacisku na to, co model „ma zrobić”, zamiast tylko na zakazy,

- Parametryzację zmiennych: Stosowanie placeholderów (np. {{user_query}}), co pozwala na budowanie dynamicznych szablonów,

- Schematy wejścia i wyjścia: Precyzyjne określenie formatu danych (np. JSON), co umożliwia automatyzację i dalsze przetwarzanie wyników.

Zaawansowane techniki i najnowsze badania

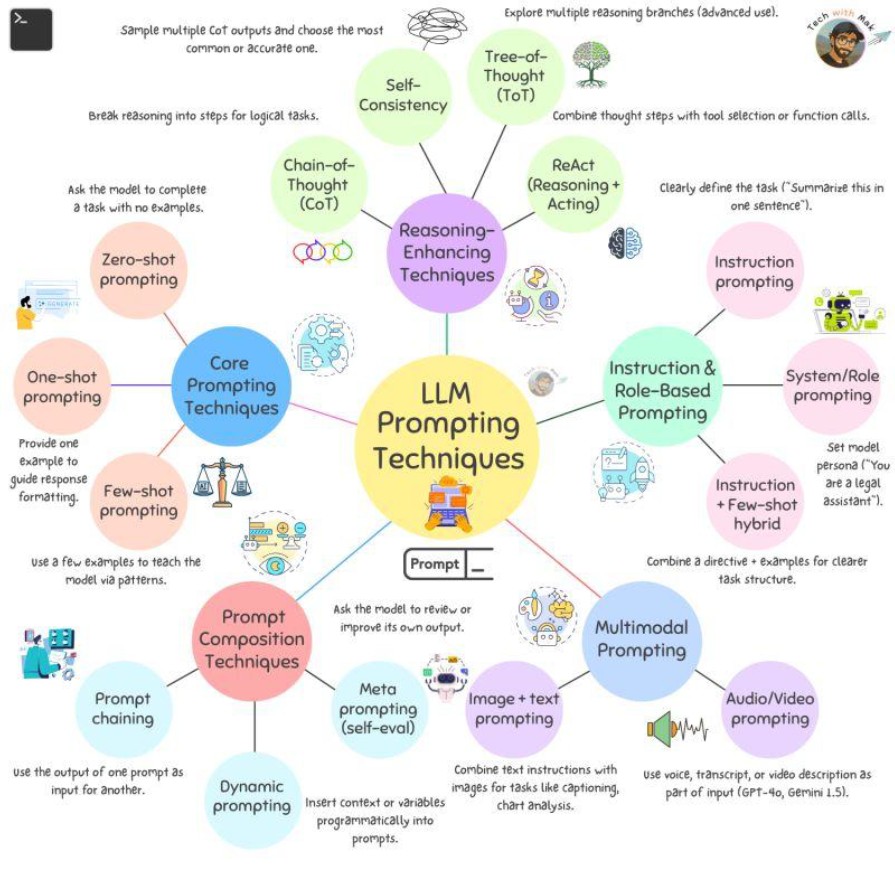

W dziedzinie inżynierii promptów następuje przejście od prostych zapytań do złożonych strategii i systemów agentowych:

- Many-Shot In-Context Learning (ICL): Najnowsze badania wskazują, że Many-shot ICL (wykorzystujący setki lub tysiące przykładów) konsekwentnie przewyższa Few-shot ICL, szczególnie w trudnych zadaniach wymagających rozumowania. Modele takie jak Gemini 3 Pro potrafią efektywnie wykorzystywać ogromną liczbę przykładów dzięki rozszerzonym oknom kontekstowym.

- Agentic Workflows (Przepływy Agentowe): Przemysł odchodzi od pojedynczych promptów na rzecz systemów wieloagentowych, gdzie zadania są dzielone między wyspecjalizowanych agentów.

- Zaawansowane Strategie Rozumowania:

- Chain-of-Thought (CoT): Zachęcanie modelu do myślenia „krok po kroku”,

- Tree of Thoughts (ToT): Eksploracja wielu ścieżek rozumowania jednocześnie i wybór najlepszej,

- Self-Consistency: Generowanie wielu niezależnych odpowiedzi i wybór najbardziej spójnej.

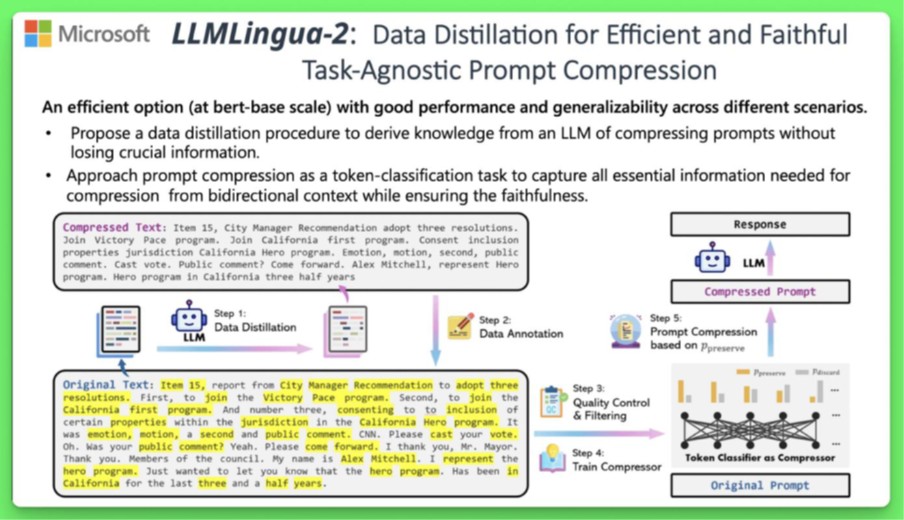

- Kompresja Promptów: Narzędzia takie jak LLMLingua-2 pozwalają na destylację danych i kompresję promptów bez utraty kluczowych informacji, co optymalizuje zużycie tokenów i koszty.

- Meta-Prompting: Instruowanie modelu, aby sam przygotował lub ulepszył prompt dla konkretnego zadania.

Konfiguracja i optymalizacja LLM

Efektywne wykorzystanie modeli wymaga zrozumienia ich parametrów konfiguracyjnych:

- Tokeny: Są „walutą” modeli; każdy model posiada limit tzw. okna kontekstowego (np. 128k dla GPT-4, ponad 1M dla Gemini 3 Pro).

- Temperatura: Kontroluje losowość – niskie wartości (np. 0.1) dają odpowiedzi deterministyczne, wysokie (np. 0.9) zwiększają kreatywność.

- Top-P i Top-K: Mechanizmy próbkowania ograniczające wybór kolejnego tokenu do najbardziej prawdopodobnych opcji.

Dyscyplina oprogramowania i eliminacja halucynacji

Modele LLM to silniki probabilistyczne, co może prowadzić do halucynacji – generowania fałszywych informacji w sposób autorytatywny. Aby temu zapobiec, inżynieria promptów powinna być prowadzona z taką samą rygorystycznością jak tworzenie oprogramowania:

- Wersjonowanie promptów: Przypisywanie aplikacji do konkretnych migawek modeli w celu zapewnienia spójności.

- Systematyczna ewaluacja: Budowanie potoków testowych (np. DeepEval, Promptfoo) do mierzenia poprawności i bezpieczeństwa za pomocą mierzalnych metryk.

- Projektowanie pod kątem zmian: Traktowanie promptów jako plików konfiguracyjnych przechowywanych poza kodem źródłowym.

Nowoczesne narzędzia, takie jak Cursor, Claude Code czy LangChain, wspierają programistów w monitorowaniu, testowaniu i integracji promptów z realnymi systemami, czyniąc z inżynierii promptów trwałą kompetencję inżynieryjną.

Halucynacje

Podczas pracy z AI mogą pojawić się pewne mylące wyniki. Z perspektywy użytkownika wyglądają na całkowicie wiarygodną treść, stworzoną z pełnym przekonaniem. W świecie technologii nazywa się to halucynacją.

Nie jest to oznaka, że AI „śni” lub traci rozum, a raczej fascynujący wgląd w to, jak duże modele językowe faktycznie przetwarzają ludzki język.

Halucynacja sztucznej inteligencji występuje, gdy model generatywny korzysta z wzorców, które nie istnieją, nie są oparte na danych szkoleniowych lub są niezgodne z dostępnymi źródłami, co skutkuje nieprawdziwymi lub bezsensownymi, ale gramatycznie poprawnymi, wynikami.

Aby zrozumieć, dlaczego sztuczna inteligencja „kłamie”, musimy pamiętać, że w przeciwieństwie do ludzi nie „zna” ona faktów. Jest to zasadniczo silnik probabilistyczny.

- Charakter predykcyjny: Modele sztucznej inteligencji działają poprzez przewidywanie następnego najbardziej prawdopodobnego słowa (tokenu) w sekwencji. Jeśli model wprowadzi kilka słów na niewłaściwą ścieżkę, będzie nadal „przewidywał” najbardziej prawdopodobne następne słowo dla tej fałszywej ścieżki, aby utrzymać nieprawidłowe koncepcje.

- Luki w danych i szum: Jeśli dane szkoleniowe są rzadkie w odniesieniu do konkretnego tematu, model może wypełnić lukę, łącząc powiązane, ale nieprawidłowe koncepcje.

- Nadmierne dopasowanie: Czasami model zbyt dobrze uczy się danych szkoleniowych, w tym szumu i tendencyjności, co prowadzi do dostrzegania wzorców tam, gdzie ich nie ma.

- Zadowalanie użytkownika: Modele są często dostosowywane tak, aby były pomocne. Jeśli polecenie prowadzi lub „wprowadza w błąd” sztuczną inteligencję, może ona nadać priorytet udzielaniu odpowiedzi zamiast przyznaniu się, że jej nie ma.

Najbardziej niebezpiecznym aspektem halucynacji jest jej autorytatywny ton. Ponieważ modele LLM są szkolone na tekstach profesjonalnych, akademickich i dziennikarskich, odzwierciedlają one styl prawdy.

Halucynacje AI przypominają nam, że chociaż narzędzia te są zaawansowane, są one jedynie odbiciem języka, a nie oknem na prawdę. Są kreatywnymi partnerami, a nie encyklopediami. Rozumiejąc przyczyny powstania mirażu, możemy z nich korzystać w sposób bardziej efektywny – i bardziej sceptyczny.

Dobre praktyki

Podczas pracy z promptami w aplikacjach warto stosować następujące praktyki:

- Traktuj prompty jako konfigurację: Przechowuj je w plikach lub systemach konfiguracyjnych, a nie w rozrzuconych po kodzie ciągach znaków.

- Spraw, aby wyniki były przyjazne dla maszyn: Wymagaj ścisłego formatu JSON lub innych formatów umożliwiających parsowanie i dołącz jasne instrukcje dotyczące escapowania i walidacji.

- Kontroluj zakres: Wyraźnie opisz, co model musi, a czego nie może robić, w tym ograniczenia dotyczące bezpieczeństwa i ochrony.

- Rejestruj i obserwuj: Przechwytuj prompty i odpowiedzi (z odpowiednią kontrolą prywatności), aby debugować problemy i iteracyjnie ulepszać prompty.

- Projektuj z myślą o zmianach: Zakładaj, że zachowanie modelu będzie ulegać zmianom. Dbaj o to, aby prompty były krótkie, modułowe i łatwe do aktualizacji.

W kontekście wrażliwym na kwestie bezpieczeństwa inżynieria promptów obejmuje również zabezpieczenia przed próbami wstrzyknięcia promptów i jailbreakiem poprzez ograniczenie danych wejściowych i wzmocnienie instrukcji systemowych.

Optymalizacja

Dla doświadczonego programisty najszybszym sposobem na poprawę jakości promptów jest traktowanie promptów jak kodu i systematyczne ich powtarzanie.

- Zacznij od podstawy: Napisz prosty, jasny prompt dla konkretnego zadania programistycznego.

- Weryfikuj: Sprawdź poprawność, czytelność, zgodność ze standardami i pokrycie przypadków skrajnych.

- Udoskonal: Dodaj ograniczenia, przykłady i ustrukturyzowane wyniki na podstawie zaobserwowanych błędów.

- Szablon: Wyodrębnij wzorce wielokrotnego użytku do nazwanych poleceń popartych konfiguracją i testami.

W miarę jak modele LLM są coraz bardziej integrowane ze stosem oprogramowania, inżynieria poleceń staje się podstawową kompetencją inżynierską, a nie tylko tymczasowym trendem. Dla inżynierów oprogramowania nauka opanowania tych modeli za pomocą precyzyjnych, testowalnych poleceń jest obecnie częścią tworzenia solidnych, łatwych w utrzymaniu systemów.

Narzędzia

Podczas pracy z promptami bardzo przydatne jest znalezienie zestawu narzędzi, które ułatwiają proces pracy, np.:

- Firecrawl: Narzędzie do scrapowania (automatycznego pozyskiwania danych) stron internetowych.

- Promptfoo: Testy jednostkowe dla promptów.

- LangChain: Monitorowanie rezultatów uzyskiwanych z promptów.

- Visual Studio Code: Zintegrowane środowisko programistyczne (IDE) Microsoftu (prompt to code).

- Antigravity: Zintegrowane środowisko programistyczne (IDE) od Google.

- Cursor: AI-natywne IDE stworzone od podstaw do programowania z wykorzystaniem AI.

- Tiktokenizer: Ewaluacja kosztu promptów.

- NotebookLLM: Notepad zasilany przez AI.

- Claude Code: Interfejs wiersza poleceń służący do pisania kodu.

Techniki (niedalekiej?) przyszłości

Coraz częściej w mediach społecznościowych grupy skupione na sztucznej inteligencji dyskutują na temat kolejnych iteracji rozwoju technik wykorzystania AI.

Jedna z nich wskazuje na dominację oraz zastąpienie promptów przez wyspecjalizowanych agentów, których inżynier miałby nadzorować i synchronizować. Są też zwolennicy teorii, w której agenci AI wraz z wykorzystaniem zaawansowanych technik promptowania poprawią swoją jakość zwracanych rezultatów.

Podsumowując rozważanie na temat inżynierii promptów, można wskazać na kilka najważniejszych narzędzi i technik, które mogą być wyznacznikiem dziedziny AI w najbliższych miesiącach:

- Agenci AI: Rozwój sztucznej inteligencji zmierza w kierunku zorganizowanego przepływu pracy z wykorzystaniem inteligentnych agentów AI:

- Systemy wieloagentowe: Zamiast tworzyć jeden prompt, wykorzystuje się sieć agentów specjalizujących się np. w frontendzie, backendzie, testach.

- Reflekcja i auto–korekta: Agent odpowiedzialny za tworzenie rozwiązania prosi innego agenta o weryfikację pracy.

- Ewaluacja systemowa: Inżynieria promptów może pomóc również przy zarządzaniu jakością:

- Programowalne funkcje evals: Z wykorzystaniem narzędzi takich jak DeepEval czy G- Eval można mierzyć poprawność, podobieństwo czy bezpieczeństwo rozwiązania z wykorzystaniem metryk, co w przyszłości może zastąpić testy manualne.

- Prompty oparte na testach (test-driven): Zacznij od niewielkiego zbioru danych dotyczących rzeczywistych awarii, aby ukierunkować szybkie iteracje.

- Zaawansowane strategie rozumowania: Poza wspomnianymi technikami Chain-Of-Thought, nowoczesne techniki uwzględniają:

- Spójność wewnętrzną: Generowanie wielu niezależnych ścieżek rozumowania i wybieranie najczęstszej lub najbardziej spójnej odpowiedzi.

- Generowanie wiedzy: Prośba skierowana do modeli o wygenerowanie odpowiedniej wiedzy ogólnej przed przystąpieniem do realizacji głównego zadania w celu poprawy dokładności.

- Meta-Prompting: Instruowanie modelu, aby opracował lub udoskonalił własne prompty dla określonego zadania.

- Obserwowalność produkcji: Traktuj prompty jako infrastrukturę krytyczną:

- Kontrola wersji: Przypisuj aplikacje do konkretnych migawek modelu, aby zapewnić spójne działanie podczas aktualizacji.

- Monitoring: Śledź opóźnienia, koszty i odchylenia dla każdej wersji monitu w czasie rzeczywistym.

Źródła

- What is Prompt Engineering?

- What Is Prompt Engineering? Definition and Examples

- Promptware Engineering: Software Engineering for Prompt-Enabled Systems

- Many-Shot In-Context Learning

- Prompt Engineering Guide

- Prompt engineering: overview and guide

- What Is Prompt Engineering? A Guide

- What is prompt engineering?

- Prompt engineering 101 for developers

- How Prompt Engineering Changed the Way I Write Code

- What Is Prompt Engineering and How to Master It in Generative AI

- A Survey of Context Engineering for Large Language Models

- Prompt Engineering

- Jak pisać skuteczne prompty: pozwól AI być twoim prompt engineerem

Zostaw komentarz