W artykule przybliżyłem proces konfiguracji środowiska, integracji pobierania danych z modelem podstawowym oraz wdrażania chatbota zdolnego do udzielania dokładnych odpowiedzi uwzględniających kontekst.

Czym jest Amazon Bedrock?

Amazon Bedrock to usługa AWS, która umożliwia bezpieczne tworzenie i wdrażanie aplikacji generatywnych AI na dużą skalę. Zapewnia dostęp do zaawansowanych modeli podstawowych od wiodących dostawców, zarządzanych w ramach infrastruktury AWS. Bedrock upraszcza proces tworzenia aplikacji, oferując zarządzane punkty końcowe i integracje, możliwości dostosowywania oraz bezpieczeństwo na poziomie przedsiębiorstwa.

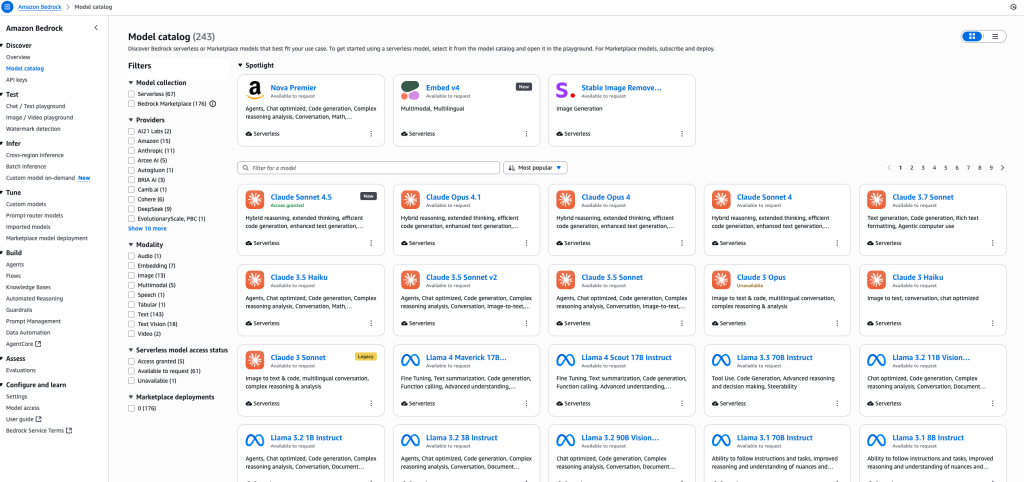

Modele podstawowe w Amazon Bedrock

Amazon Bedrock zapewnia dostęp do szerokiego i stale rozszerzającego się zestawu najnowocześniejszych modeli podstawowych (FM) od wiodących dostawców, dostępnych za pośrednictwem jednego interfejsu API w pełni zarządzanego przez AWS. Dzięki temu firmy mogą wybrać najlepsze modele do swoich zastosowań – niezależnie od tego, czy chodzi o tekst, obraz, kod, rozumienie multimodalne czy osadzanie.

Popularni dostawcy i modele (stan na październik 2025)

- Anthropic Claude:Claude Opus, Claude Sonnet 4.5, Claude Haiku – zaawansowane modele generowania tekstu znane ze swoich zdolności rozumowania konwersacyjnego, bezpieczeństwa i jakości rozumienia języka. Wykorzystywane w chatbotach kontroli jakości w przedsiębiorstwach, sporządzaniu dokumentów prawnych i rozumowaniu wieloetapowym.

- Amazon Titan: Titan Text, Titan Image Generator, Titan Embeddings, Titan Multimodal – własne modele Amazon do generowania tekstu, osadzania i tworzenia obrazów. Titan jest ceniony za wsparcie dla przedsiębiorstw, szybkość, integrację bezpieczeństwa/zgodności (np. z AWS IAM/S3/VPC) oraz wszechstronność w różnych zastosowaniach: podsumowywanie, wyszukiwanie, generowanie treści, tłumaczenie lub rekomendacje.

- Stability AI Stable Diffusion: najnowocześniejsze generowanie obrazów na podstawie podpowiedzi tekstowych. Wykorzystywane do produkcji wysokiej jakości materiałów marketingowych, prototypowania UI/UX, narzędzi kreatywnych i gier.

- Meta Llama 2: potężne, duże modele językowe do obsługi kodu, dialogów i ogólnych tekstów. Llama 2 (wersja 13B, 70B) jest często używana do wieloobrotowej sztucznej inteligencji konwersacyjnej, ekstrakcji wiedzy i chatbotów w branżach regulowanych.

- AI21 Labs Jurassic-2: znany z wysokiej jakości, zróżnicowanego, wielojęzycznego generowania tekstu i treści. Przydatny w sektorach finansowym, badawczym i prawnym do pytań i odpowiedzi, ekstrakcji danych, podsumowywania i przetwarzania dokumentów.

- Cohere Command & Embed: specjalizuje się w szybkim, zorientowanym na prywatność generowaniu treści i wyszukiwaniu semantycznym, w tym obsłudze ponad 100 języków i wydajnym grupowaniu dokumentów.

- Alibaba Qwen3 (nowość w 2025 r.): mieszanka ekspertów (MoE) i gęste modele językowe, unikalne w zakresie generowania kodu, analizy repozytoriów, hybrydowych przepływów pracy agentów oraz równoważenia kosztów i wydajności w zaawansowanych przypadkach użycia.

- Hugging Face Open Models (za pośrednictwem Bedrock Marketplace): obejmuje dostęp do wiodących modeli open source do bardziej specjalistycznych lub niszowych zadań AI, dostrajania i wdrożeń brzegowych.

Jak wybrać odpowiedni model?

- Anthropic Claude jest preferowany, gdy potrzebujesz najbezpieczniejszych i najbardziej zaawansowanych agentów konwersacyjnych lub subtelnego rozumienia dokumentów.

- Titan doskonale sprawdza się w skalowalnych, wysoce zintegrowanych wdrożeniach opartych na AWS.

- Stable Diffusion to najlepszy wybór do generowania wysokiej jakości, kreatywnych obrazów.

- Llama 2 i Jurassic-2 najlepiej sprawdzają się w przypadku zaawansowanych aplikacji tekstowych, w tym wielojęzycznych i złożonych przepływów dokumentów.

- Modele Qwen3, Cohere i HuggingFace zaspokajają zaawansowane, wielojęzyczne, prywatne lub skoncentrowane na kodzie potrzeby.

Wniosek: aby wybrać najlepszy model, oceń następujące elementy:

- jakość wyników (i bezpieczeństwo),

- koszt i opóźnienie na żądanie,

- obsługa wielu języków/dokumentów,

- integracja z usługami AWS (IAM, S3, VPC itp.),

- potrzeby w zakresie szkolenia niestandardowego (inżynieria podpowiedzi, dostrajanie),

- wymogi dotyczące zgodności lub lokalizacji danych.

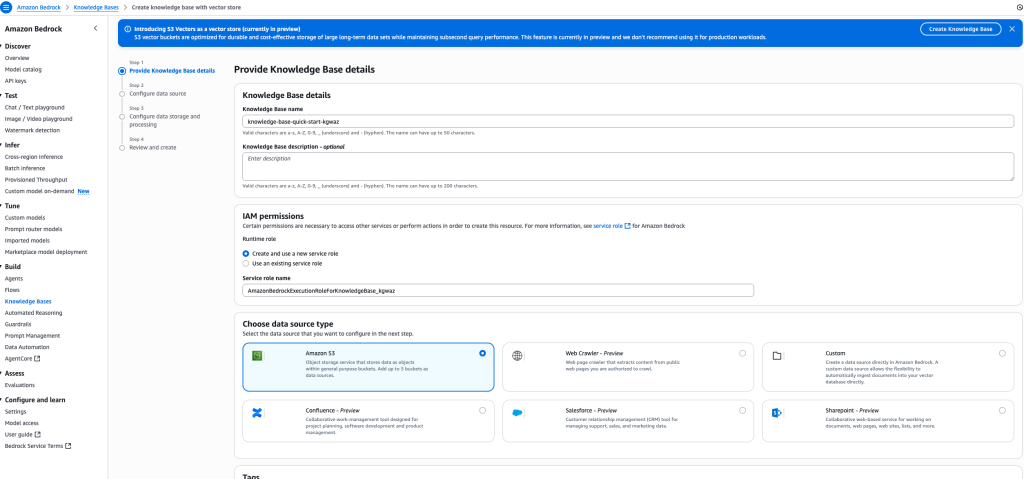

Bazy wiedzy w Amazon Bedrock

Bazy wiedzy w Amazon Bedrock służą do łączenia chatbota AI z korporacyjnymi źródłami danych. Dzięki bazom wiedzy chatbot może odpowiadać na pytania dotyczące konkretnej firmy, pobierając informacje z własnych danych, zamiast polegać wyłącznie na źródłach publicznych lub ogólnych.

Bedrock obsługuje wiele typów źródeł danych: można używać zasobników Amazon S3 do przechowywania plików, instrukcji lub dokumentacji albo połączyć się bezpośrednio z wiki Confluence, gdzie znajduje się wiedza dotycząca konkretnej firmy. Dzięki temu chatbot może odpowiadać na wewnętrzne pytania z działu IT, HR lub innych jednostek, dostarczając użytkownikom dokładne, dostosowane do kontekstu informacje.

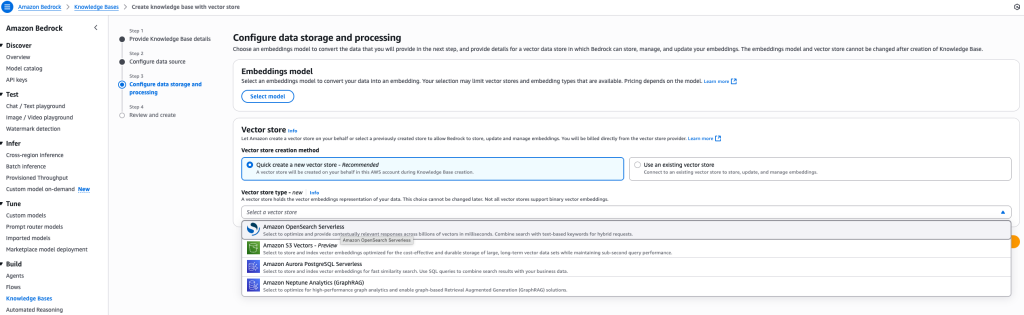

Wykorzystanie baz danych wektorowych do osadzania

Aby przechowywać i indeksować osadzenia dokumentów, Amazon Bedrock obsługuje różne bazy danych wektorowych (magazyny wektorowe). Magazyny te mają kluczowe znaczenie dla umożliwienia szybkiego wyszukiwania podobieństw i hybrydowego pobierania danych firmowych.

Możesz korzystać z:

- Amazon OpenSearch Serverless,

- Amazon S3 Vectors,

- Aurora PostgreSQL,

- Neptune Analytics (GraphRAG) i innych.

W tym projekcie wybieramy Amazon OpenSearch Serverless jako naszą bazę danych wektorowych. OpenSearch Serverless jest w pełni zarządzany, oferuje wysoką wydajność na dużą skalę i integruje się natywnie z narzędziami bezpieczeństwa i monitorowania AWS. Jest idealny do scenariuszy RAG, w których kluczowymi priorytetami są dostęp do kontekstu z małym opóźnieniem i skalowalność.

Synchronizacja danych bazy wiedzy

Po utworzeniu bazy wiedzy w Amazon Bedrock należy zsynchronizować dane z podłączonego źródła, takiego jak Confluence lub wewnętrzna wiki.

Proces synchronizacji polega na przesłaniu i indeksowaniu dokumentów, aby chatbot AI miał do nich dostęp w celu wyszukiwania i odpowiadania na pytania użytkowników. Operacja ta trwa zazwyczaj kilka minut, w zależności od rozmiaru i liczby plików w źródle. Duże bazy wiedzy mogą wymagać więcej czasu, ale synchronizacja jest procesem jednorazowym i można ją zautomatyzować. Po zakończeniu chatbot może natychmiast wyszukiwać i odpowiadać na zapytania dotyczące konkretnego przedsiębiorstwa, korzystając ze świeżo zindeksowanych danych.

Udostępnianie chatbota: wdrażanie interfejsu API Bedrock Agents

Po sprawdzeniu, czy model i baza wiedzy działają poprawnie, nadszedł czas, aby udostępnić chatbota użytkownikom i aplikacjom poprzez udostępnienie interfejsu API.

Amazon Bedrock zapewnia Agents for Bedrock Runtime oraz interfejs API RetrieveAndGenerate, aby umożliwić integrację.

Kluczowe funkcje API:

- RetrieveAndGenerate (dokumentacja API): Ten punkt końcowy pobiera odpowiedni kontekst z bazy wiedzy i generuje odpowiedzi przy użyciu wybranego modelu podstawowego (np. Claude Sonnet 4.5). Jest to główny silnik stojący za chatbotami RAG w Bedrock.

- Agenci dla Amazon Bedrock Runtime (przegląd API): Agenci umożliwiają zarządzanie modelami, dokumentami, bazami wiedzy oraz udostępnianie punktów końcowych API aplikacjom wewnętrznym lub zewnętrznym.

- Integracja z Pythonem (boto3): Przykład dostępu programowego

boto3 retrieve_and_generate implementacja.

Jak to działa?

- Twój chatbot jest udostępniany jako punkt końcowy REST API. Aplikacje, strony internetowe i użytkownicy mogą wysyłać do niego żądania POST z zapytaniami w języku naturalnym.

- Agenci dla Bedrock Runtime automatycznie pobierają dane (za pomocą RAG) z prywatnych źródeł firmy (Wiki, Confluence, dokumenty S3) i zwracają wygenerowaną, kontekstową odpowiedź.

- Możesz osadzić ten interfejs API w MS Teams, Slack, portalach intranetowych, systemach HR lub IT albo aplikacjach publicznych. Bedrock obsługuje bezpieczne uwierzytelnianie, dostęp oparty na rolach i integrację z narzędziami dla przedsiębiorstw.

Typowe przypadki użycia

- Wewnętrzny chatbot firmy odpowiada na pytania dotyczące HR lub IT, przeszukując własne dokumenty, a nie tylko publiczną wiedzę.

- Zautomatyzowana obsługa często zadawanych pytań, segregacja zgłoszeń, wdrażanie nowych pracowników lub zapytania dotyczące wsparcia przy użyciu danych firmowych.

- Dostęp w czasie rzeczywistym do wyselekcjonowanej wiedzy przedsiębiorstwa dla pracowników, kontrahentów lub klientów.

Pełna dokumentacja API

- Bedrock API Reference (pełna)

- Scenariusze i przykłady kodu

- Przykładowy klient Python dla Bedrock Agents

Podsumowanie

Po skonfigurowaniu chatbota zsynchronizuj bazę wiedzy, a następnie udostępnij interfejs API za pomocą Bedrock Agents for Runtime. W ten sposób użytkownicy będą mogli uzyskać natychmiastowe, specyficzne dla przedsiębiorstwa odpowiedzi bezpośrednio z danych firmy – w bezpieczny sposób i na dużą skalę.

Zostaw komentarz