„Masz może gdzieś to zdjęcie z kampanii jesiennej? To z kobietą w czerwonym płaszczu…”

Znasz to? Ktoś z zespołu pyta o zasób z poprzedniego kwartału – „to zdjęcie, gdzie było drzewo i jakieś liście” – i nagle zaczyna się nurkowanie po folderach, archiwach, SharePointach i dyskach. Bez sukcesu. Bo nikt nie pamięta, jak plik się nazywał, a tagi… cóż, nie zostały dodane.

To klasyczny problem zarządzania zasobami cyfrowymi (DAM) – rosnąca liczba plików, a coraz mniejsza szansa, że ktoś coś odnajdzie bez frustracji. Z artykułu dowiesz się, jak sobie z tym poradzić.

Algorytmy kiedyś i dziś

Dzięki sztucznej inteligencji, dziś nie musimy ręcznie przeszukiwać nazw plików, ani ich opisywać.

Algorytmy rozpoznające obrazy potrafią:

- analizować zdjęcia i automatycznie przypisywać im słowa kluczowe (tagi),

- wykrywać twarze, przedmioty, kontekst (np. „miasto nocą”, „biznesowy styl”),

- rozpoznawać dominujące kolory, emocje, a nawet marki lub logotypy.

I co najważniejsze – robią to automatycznie przy uploadzie do systemu.

W efekcie możesz wpisać w wyszukiwarkę np. „kobieta z laptopem na tle miasta”, a system sam znajdzie pasujące pliki. Bez ingerencji grafików czy content managerów.

Możemy sobie zadać teraz pytanie: „Ale chwila, jeśli wpisałem podobną frazę w wyszukiwarce Google, to nie działało to w identyczny sposób?”.

W 2010 roku wyszukiwarki (np. Google):

- potrafiły znajdować obrazy na podstawie tekstu ALT, nazw plików i otaczającego tekstu na stronie (np. img_5324_woman-laptop.jpg),

- działały głównie w oparciu o dane tekstowe, a nie o zawartość wizualną obrazu,

- rozpoznawanie obrazów przez AI było jeszcze w fazie R&D – np. początki sieci neuronowych typu CNN (Convolutional Neural Networks) dopiero się rozwijały.

Jeśli wpisałeś w Google „woman with laptop in city”, wyszukiwarka nie „zrozumiała obrazu”, tylko szukała stron, na których ten opis pojawił się w pobliżu obrazka. Czyli: tekst → obraz. A nie: obraz → znaczenie.

To, co dziś robi AI przy uploadzie do DAM (np. w AEM), nie ma nic wspólnego z klasycznym wyszukiwaniem obrazów sprzed 15 lat. Teraz to działa w drugą stronę: system widzi plik i sam generuje znaczenie, a potem możesz to przeszukiwać w sposób naprawdę zbliżony do tego, jak działa mózg.

Co to zmienia w codziennej pracy z contentem?

Jak te zmiany wpływają na codzienną pracę?

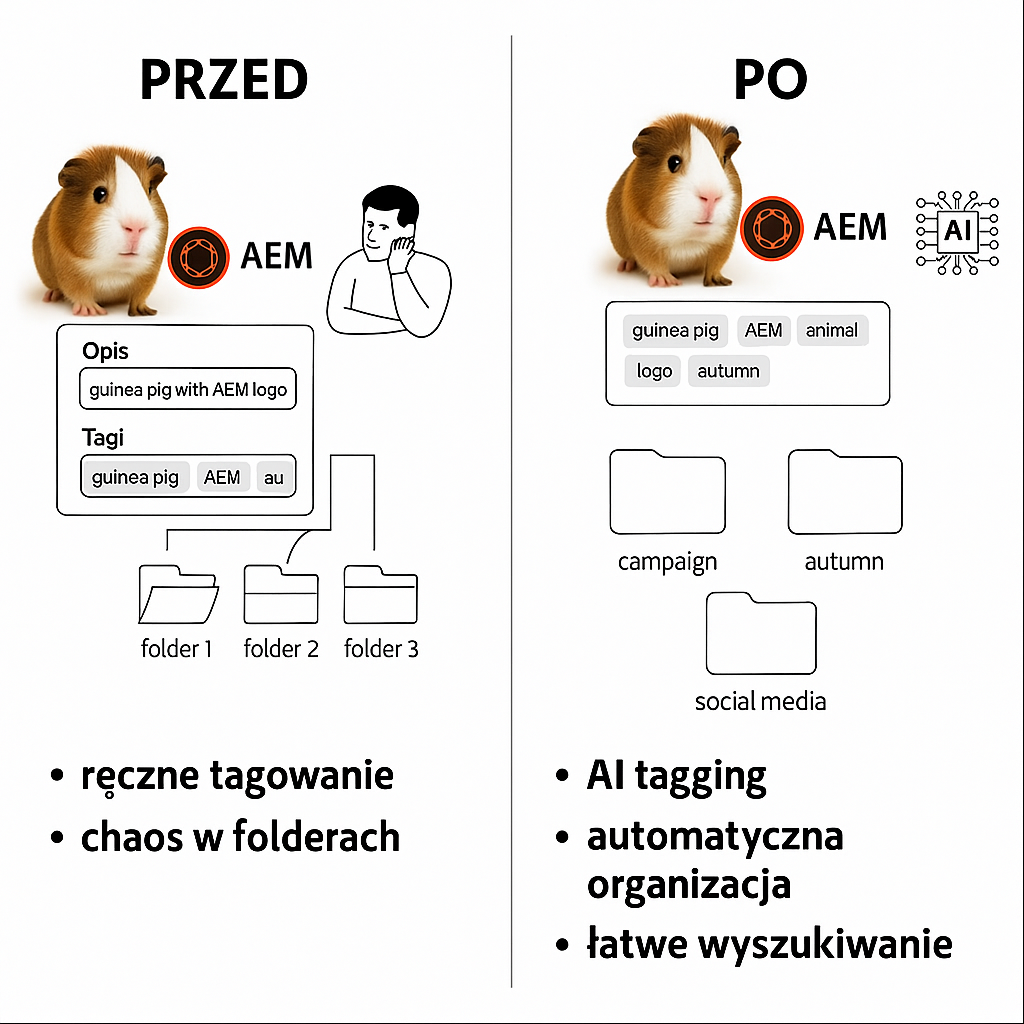

- nie trzeba tworzyć tagów ręcznie – AI zrobi to za Ciebie,

- łatwiej utrzymać porządek w rosnącej bibliotece plików,

- zespół marketingowy szybciej dostaje to, czego potrzebuje,

- unikasz tworzenia duplikatów („bo nie mogliśmy znaleźć wersji z 2023…”).

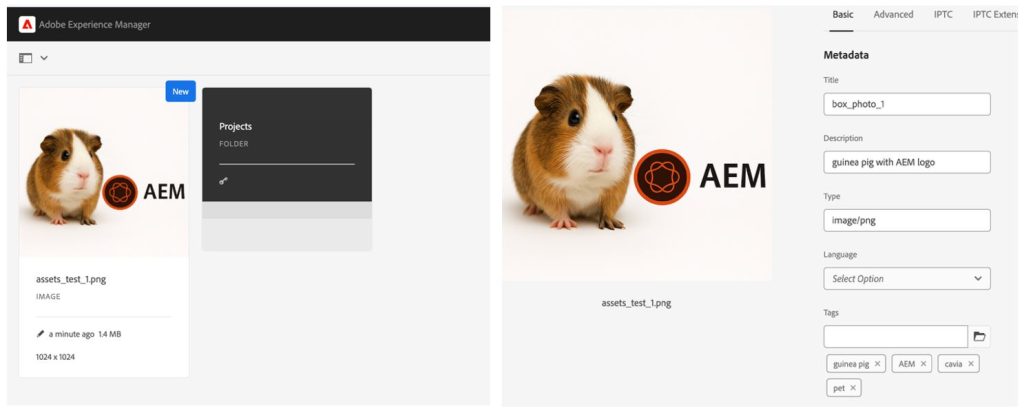

Co się dzieje, gdy wrzucasz 100 zdjęć do AEM?

Wrzucasz 50–100 zdjęć z sesji – i co dalej?

Kiedyś wyglądało to tak:

Czekasz, aż pliki się załadują. Ktoś z zespołu siada i… zaczyna ręcznie:

- przypisywać tagi (o ile w ogóle),

- układać foldery,

- wymyślać logiczne nazwy plików,

- i tłumaczyć innym, gdzie czego szukać.

Efekt? Po kilku tygodniach nikt nie pamięta, gdzie to zdjęcie ze świnką morską i logo. „To chyba było w folderze ‘jesień_2023_v2’, ale tam są same zdjęcia z kawiarni…”. Godziny frustracji. Powielanie plików. Assety się dublują, pamięć zapycha. A DAM z inteligentnego systemu zmienia się w wirtualny strych.

I tu z tyłu głowy pojawia się myśl: „Musi być jakiś sposób, żeby to zautomatyzować…”.

I faktycznie – jest.

Z pomocą przychodzi Assets as a Cloud Service Ultimate, czyli nowa generacja Adobe DAM oparta na AI.

Assets as a Cloud Service Ultimate – czym jest i jak się z nim pracuje?

Adobe Experience Manager Assets as a Cloud Service to nowoczesne, chmurowe rozwiązanie do zarządzania zasobami cyfrowymi, które dzięki wbudowanej sztucznej inteligencji i automatyzacji pozwala szybciej, mądrzej i wygodniej pracować z treściami – bez potrzeby ręcznych aktualizacji.

Dzięki integracji z Adobe Firefly, możesz generować brakujące grafiki w czasie rzeczywistym i od razu zapisać je w repozytorium AEM – bez wychodzenia z systemu.

Wyobraźmy sobie podobną sytuację ze zdjęciami, ale w tym przypadku z pomocą Assets as a Cloud Service Ultimate.

- Wrzucasz 50–100 zdjęć z kampanii. Nie musisz nic tagować ani opisywać. AEM zrobi to za Ciebie.

- W tle działa AI (Adobe Sensei) i…

- rozpoznaje zawartość każdego zdjęcia (np. „kobieta z parasolką”, „cityscape”, „autumn”),

- przypisuje inteligentne tagi i kategorie,

- wykrywa twarze, emocje, przedmioty, logotypy,

- generuje automatyczne opisy (tekstowe metadane),

- klasyfikuje pliki (np. lifestyle, produktowe, wizerunkowe),

- rozpoznaje język lub miejsce, jeśli to istotne (np. Tokyo, winter, streetwear).

- Wszystko trafia automatycznie do właściwego miejsca:

- katalogi porządkują się zgodnie z regułami organizacji (np. kampania/temat/kanał),

- metadane są gotowe do publikacji bez ręcznej ingerencji,

- AEM sugeruje wykorzystanie assetów w konkretnych kanałach (np. do social media lub banerów),

- masz pełny podgląd, kto używał danego assetu i gdzie.

Jakie jeszcze korzyści daje Ci Assets as Cloud Service Ultimate?

Czego jeszcze możesz się spodziewać?

- Inteligentne przeszukiwanie – wpisz „guinea pig with AEM logo” – i gotowe.

- Zaawansowana analiza podobieństw – znajdziesz zdjęcia z tej samej sesji, stylu, kolorystyki.

- Content automation – możesz tworzyć automatyczne warianty (np. do kanałów mobilnych, wersje z przycięciem, różne formaty).

- Monitoring użycia – łatwo sprawdzisz, czy dany asset został już wykorzystany i gdzie.

Tu znajdziesz dokładną instrukcję, jak zaimplementować Assets as Cloud Service Ultimate.

Efekt końcowy

To, co kiedyś trwało godziny i wymagało ludzkiej cierpliwości (oraz kawy), dziś dzieje się automatycznie.

AEM nie tylko przechowuje pliki. On je rozumie. I właśnie dlatego przestaje być „DAM-em”, a staje się inteligentnym hubem contentowym.

Zostaw komentarz